Espacio vectorial

En matemáticas y física , un espacio vectorial (también llamado espacio lineal ) es un conjunto cuyos elementos, a menudo llamados vectores , pueden sumarse y multiplicarse ("escalarse") por números llamados escalares . Las operaciones de suma vectorial y multiplicación escalar deben satisfacer ciertos requisitos, llamados axiomas vectoriales . Los espacios vectoriales reales y los espacios vectoriales complejos son tipos de espacios vectoriales basados en diferentes tipos de escalares: números reales y números complejos . Los escalares también pueden ser, de forma más general, elementos de cualquier cuerpo .

Los espacios vectoriales generalizan los vectores euclidianos , que permiten modelar magnitudes físicas , como fuerzas y velocidades , que no solo tienen una magnitud , sino también una dirección . El concepto de espacios vectoriales es fundamental para el álgebra lineal , junto con el concepto de matrices , que permite realizar cálculos en espacios vectoriales. Esto proporciona una forma concisa y sintética de manipular y estudiar sistemas de ecuaciones lineales .

Los espacios vectoriales se caracterizan por su dimensión , que, a grandes rasgos, especifica el número de direcciones independientes en el espacio. Esto significa que, para dos espacios vectoriales sobre un cuerpo dado y con la misma dimensión, las propiedades que dependen solo de la estructura del espacio vectorial son exactamente las mismas (técnicamente, los espacios vectoriales son isomorfos ). Un espacio vectorial es de dimensión finita si su dimensión es un número natural . De lo contrario, es de dimensión infinita , y su dimensión es un cardinal infinito . Los espacios vectoriales de dimensión finita se dan de forma natural en geometría y áreas relacionadas. Los espacios vectoriales de dimensión infinita se dan en muchas áreas de las matemáticas. Por ejemplo, los anillos polinómicos son espacios vectoriales de dimensión infinita numerables , y muchos espacios funcionales tienen la cardinalidad del continuo como dimensión.

Muchos espacios vectoriales que se consideran en matemáticas también están dotados de otras estructuras . Es el caso de las álgebras , que incluyen extensiones de cuerpo , anillos polinómicos, álgebras asociativas y álgebras de Lie . También es el caso de los espacios vectoriales topológicos , que incluyen espacios de funciones, espacios de producto interno , espacios normados , espacios de Hilbert y espacios de Banach .

| Estructuras algebraicas |

|---|

Definición y propiedades básicas

En este artículo, los vectores se representan en negrita para distinguirlos de los escalares. [nb 1] [1]

Un espacio vectorial sobre un cuerpo F es un conjunto no vacío V junto con una operación binaria y una función binaria que satisfacen los ocho axiomas que se enumeran a continuación. En este contexto, los elementos de V se denominan comúnmente vectores y los elementos de F se denominan escalares . [2]

- La operación binaria, llamada suma vectorial o simplemente adición, asigna a cualesquiera dos vectores v y w en V un tercer vector en V que comúnmente se escribe como v + w , y se llama suma de estos dos vectores.

- La función binaria, llamada multiplicación escalar , asigna a cualquier escalar a en F y a cualquier vector v en V otro vector en V , que se denota como v . [nb 2]

Para tener un espacio vectorial, se deben satisfacer los ocho axiomas siguientes para cada u , v y w en V , y a y b en F. [3]

| Axioma | Declaración |

|---|---|

| Asociatividad de la suma de vectores | u + ( v + w ) = ( u + v ) + w |

| Conmutatividad de la suma de vectores | u + v = v + u |

| Elemento de identidad de la suma de vectores | Existe un elemento 0 ∈ V , llamado vector cero , tal que v + 0 = v para todo v ∈ V . |

| Elementos inversos de la suma de vectores | Para cada v ∈ V , existe un elemento − v ∈ V , llamado inverso aditivo de v , tal que v + (− v ) = 0 . |

| Compatibilidad de la multiplicación escalar con la multiplicación de campos | a ( b v ) = ( ab ) v [nb 3] |

| Elemento identidad de la multiplicación escalar | 1 v = v , donde 1 denota la identidad multiplicativa en F . |

| Distributividad de la multiplicación escalar con respecto a la suma vectorial | a ( u + v ) = a u + a v |

| Distributividad de la multiplicación escalar con respecto a la adición de campos | ( a + b ) v = a v + b v |

Cuando el campo escalar son los números reales , el espacio vectorial se denomina espacio vectorial real , y cuando el campo escalar son los números complejos , el espacio vectorial se denomina espacio vectorial complejo . [4] Estos dos casos son los más comunes, pero también se consideran comúnmente espacios vectoriales con escalares en un campo arbitrario F. Un espacio vectorial de este tipo se denomina espacio vectorial F o espacio vectorial sobre F. [5 ]

Se puede dar una definición equivalente de un espacio vectorial, que es mucho más concisa pero menos elemental: los primeros cuatro axiomas (relacionados con la adición de vectores) dicen que un espacio vectorial es un grupo abeliano bajo adición, y los cuatro axiomas restantes (relacionados con la multiplicación escalar) dicen que esta operación define un homomorfismo de anillo del cuerpo F en el anillo de endomorfismo de este grupo. [6]

La resta de dos vectores se puede definir como

Las consecuencias directas de los axiomas incluyen que, para cada y uno tiene

- implica o

De manera aún más concisa, un espacio vectorial es un módulo sobre un campo . [7]

Bases, coordenadas vectoriales y subespacios

- Combinación lineal

- Dado un conjunto G de elementos de un F -espacio vectorial V , una combinación lineal de elementos de G es un elemento de V de la forma donde y Los escalares se denominan coeficientes de la combinación lineal. [8]

- Independencia lineal

- Se dice que los elementos de un subconjunto G de un espacio vectorial F V son linealmente independientes si ningún elemento de G puede escribirse como una combinación lineal de los otros elementos de G. De manera equivalente, son linealmente independientes si dos combinaciones lineales de elementos de G definen el mismo elemento de V si y solo si tienen los mismos coeficientes. También de manera equivalente, son linealmente independientes si una combinación lineal da como resultado el vector cero si y solo si todos sus coeficientes son cero. [9]

- Subespacio lineal

- Un subespacio lineal o subespacio vectorial W de un espacio vectorial V es un subconjunto no vacío de V que está cerrado bajo la adición vectorial y la multiplicación escalar; es decir, la suma de dos elementos de W y el producto de un elemento de W por un escalar pertenecen a W . [10] Esto implica que cada combinación lineal de elementos de W pertenece a W . Un subespacio lineal es un espacio vectorial para la adición inducida y la multiplicación escalar; esto significa que la propiedad de clausura implica que se satisfacen los axiomas de un espacio vectorial. [11]

La propiedad de clausura también implica que cada intersección de subespacios lineales es un subespacio lineal. [11] - Tramo lineal

- Dado un subconjunto G de un espacio vectorial V , el espacio lineal abarcado o simplemente el espacio de G es el subespacio lineal más pequeño de V que contiene a G , en el sentido de que es la intersección de todos los subespacios lineales que contienen a G . El espacio de G es también el conjunto de todas las combinaciones lineales de elementos de G .

Si W es el espacio de G , se dice que G abarca o genera a W , y que G es un conjunto abarcado o un conjunto generador de W . [12] - Base y dimensión

- Un subconjunto de un espacio vectorial es una base si sus elementos son linealmente independientes y abarcan el espacio vectorial. [13] Todo espacio vectorial tiene al menos una base, o muchas en general (véase Base (álgebra lineal) § Prueba de que todo espacio vectorial tiene una base ). [14] Además, todas las bases de un espacio vectorial tienen la misma cardinalidad , que se denomina dimensión del espacio vectorial (véase Teorema de la dimensión para espacios vectoriales ). [15] Esta es una propiedad fundamental de los espacios vectoriales, que se detalla en el resto de la sección.

Las bases son una herramienta fundamental para el estudio de los espacios vectoriales, especialmente cuando la dimensión es finita. En el caso de dimensión infinita, la existencia de bases infinitas, a menudo llamadas bases de Hamel , depende del axioma de elección . De ello se deduce que, en general, ninguna base puede describirse explícitamente. [16] Por ejemplo, los números reales forman un espacio vectorial de dimensión infinita sobre los números racionales , para los que no se conoce ninguna base específica.

Considérese una base de un espacio vectorial V de dimensión n sobre un cuerpo F . La definición de una base implica que cada uno puede escribirse con en F , y que esta descomposición es única. Los escalares se denominan coordenadas de v en la base. También se dice que son los coeficientes de la descomposición de v en la base. También se dice que la n - tupla de las coordenadas es el vector de coordenadas de v en la base, ya que el conjunto de las n - tuplas de elementos de F es un espacio vectorial para la adición por componentes y la multiplicación escalar, cuya dimensión es n .

La correspondencia biunívoca entre vectores y sus vectores de coordenadas hace que la suma de vectores se convierta en suma de vectores y la multiplicación escalar en multiplicación escalar. Por lo tanto, se trata de un isomorfismo del espacio vectorial , que permite traducir los razonamientos y cálculos sobre vectores en razonamientos y cálculos sobre sus coordenadas. [17]

Historia

Los espacios vectoriales se derivan de la geometría afín , a través de la introducción de coordenadas en el plano o espacio tridimensional. Alrededor de 1636, los matemáticos franceses René Descartes y Pierre de Fermat fundaron la geometría analítica al identificar soluciones a una ecuación de dos variables con puntos en una curva plana . [18] Para lograr soluciones geométricas sin utilizar coordenadas, Bolzano introdujo, en 1804, ciertas operaciones sobre puntos, líneas y planos, que son predecesoras de los vectores. [19] Möbius (1827) introdujo la noción de coordenadas baricéntricas . [20] Bellavitis (1833) introdujo una relación de equivalencia en segmentos de línea dirigidos que comparten la misma longitud y dirección a la que llamó equipolencia . [21] Un vector euclidiano es entonces una clase de equivalencia de esa relación. [22]

Los vectores fueron reconsiderados con la presentación de los números complejos por Argand y Hamilton y el inicio de los cuaterniones por este último. [23] Son elementos en R 2 y R 4 ; su tratamiento mediante combinaciones lineales se remonta a Laguerre en 1867, quien también definió sistemas de ecuaciones lineales .

En 1857, Cayley introdujo la notación matricial que permite la armonización y simplificación de los mapas lineales . Casi al mismo tiempo, Grassmann estudió el cálculo baricéntrico iniciado por Möbius. Previó conjuntos de objetos abstractos dotados de operaciones. [24] En su trabajo, están presentes los conceptos de independencia lineal y dimensión , así como los productos escalares . El trabajo de Grassmann de 1844 también excede el marco de los espacios vectoriales, ya que su consideración de la multiplicación lo llevó a lo que hoy se llama álgebras . El matemático italiano Peano fue el primero en dar la definición moderna de espacios vectoriales y mapas lineales en 1888, [25] aunque los llamó "sistemas lineales". [26] La axiomatización de Peano permitió espacios vectoriales con dimensión infinita, pero Peano no desarrolló más esa teoría. En 1897, Salvatore Pincherle adoptó los axiomas de Peano e hizo incursiones iniciales en la teoría de espacios vectoriales de dimensión infinita. [27]

Un desarrollo importante de los espacios vectoriales se debe a la construcción de los espacios funcionales por parte de Henri Lebesgue , que luego fue formalizada por Banach y Hilbert , alrededor de 1920. [28] En ese momento, el álgebra y el nuevo campo del análisis funcional comenzaron a interactuar, en particular con conceptos clave como los espacios de funciones p -integrables y los espacios de Hilbert . [29]

Ejemplos

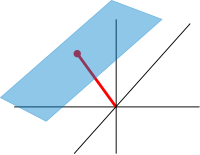

Flechas en el avión

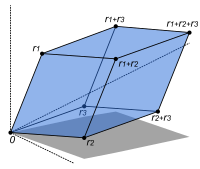

El primer ejemplo de un espacio vectorial consiste en flechas en un plano fijo , comenzando en un punto fijo. Esto se utiliza en física para describir fuerzas o velocidades . [30] Dadas dos flechas cualesquiera, v y w , el paralelogramo abarcado por estas dos flechas contiene una flecha diagonal que comienza también en el origen. Esta nueva flecha se llama suma de las dos flechas y se denota v + w . En el caso especial de dos flechas en la misma línea, su suma es la flecha en esta línea cuya longitud es la suma o la diferencia de las longitudes, dependiendo de si las flechas tienen la misma dirección. Otra operación que se puede hacer con flechas es el escalado: dado cualquier número real positivo a , la flecha que tiene la misma dirección que v , pero se dilata o se encoge multiplicando su longitud por a , se llama multiplicación de v por a . Se denota a v . Cuando a es negativo, a v se define como la flecha que apunta en la dirección opuesta. [31]

A continuación se muestran algunos ejemplos: si a = 2 , el vector resultante a w tiene la misma dirección que w , pero se estira hasta el doble de la longitud de w (la segunda imagen). De manera equivalente, 2 w es la suma w + w . Además, (−1) v = − v tiene la dirección opuesta y la misma longitud que v (el vector azul que apunta hacia abajo en la segunda imagen).

Pares ordenados de números

Un segundo ejemplo clave de un espacio vectorial lo proporcionan los pares de números reales x e y . El orden de los componentes x e y es significativo, por lo que a este par también se lo denomina par ordenado . Este par se escribe como ( x , y ) . La suma de dos pares de este tipo y la multiplicación de un par por un número se define de la siguiente manera: [32]

El primer ejemplo anterior se reduce a este ejemplo si una flecha está representada por un par de coordenadas cartesianas de su punto final.

Espacio de coordenadas

El ejemplo más simple de un espacio vectorial sobre un cuerpo F es el propio cuerpo F con su adición vista como adición vectorial y su multiplicación vista como multiplicación escalar. De manera más general, todas las n -tuplas (secuencias de longitud n ) de elementos a i de F forman un espacio vectorial que usualmente se denota F n y se llama espacio de coordenadas . [33] El caso n = 1 es el ejemplo más simple mencionado anteriormente, en el que el cuerpo F también se considera como un espacio vectorial sobre sí mismo. El caso F = R y n = 2 (por lo tanto R 2 ) se reduce al ejemplo anterior.

Números complejos y otras extensiones de campo

El conjunto de números complejos C , números que pueden escribirse en la forma x + iy para los números reales x e y donde i es la unidad imaginaria , forman un espacio vectorial sobre los reales con la adición y multiplicación usuales: ( x + iy ) + ( a + ib ) = ( x + a ) + i ( y + b ) y c ⋅ ( x + iy ) = ( c ⋅ x ) + i ( c ⋅ y ) para los números reales x , y , a , b y c . Los diversos axiomas de un espacio vectorial se deducen del hecho de que las mismas reglas se cumplen para la aritmética de números complejos. El ejemplo de los números complejos es esencialmente el mismo (es decir, es isomorfo ) que el espacio vectorial de pares ordenados de números reales mencionado anteriormente: si pensamos en el número complejo x + i y como representante del par ordenado ( x , y ) en el plano complejo , entonces vemos que las reglas para la suma y la multiplicación escalar corresponden exactamente a las del ejemplo anterior.

De manera más general, las extensiones de campo proporcionan otra clase de ejemplos de espacios vectoriales, particularmente en álgebra y teoría de números algebraicos : un campo F que contiene un campo más pequeño E es un E -espacio vectorial, por las operaciones de multiplicación y adición dadas de F. [ 34] Por ejemplo, los números complejos son un espacio vectorial sobre R , y la extensión de campo es un espacio vectorial sobre Q.

Espacios funcionales

Las funciones de cualquier conjunto fijo Ω a un cuerpo F también forman espacios vectoriales, al realizar la adición y la multiplicación escalar punto por punto. Es decir, la suma de dos funciones f y g es la función dada por y de manera similar para la multiplicación. Tales espacios de funciones ocurren en muchas situaciones geométricas, cuando Ω es la línea real o un intervalo , u otros subconjuntos de R . Muchas nociones en topología y análisis, como continuidad , integrabilidad o diferenciabilidad se comportan bien con respecto a la linealidad: sumas y múltiplos escalares de funciones que poseen tal propiedad aún tienen esa propiedad. [35] Por lo tanto, el conjunto de tales funciones son espacios vectoriales, cuyo estudio pertenece al análisis funcional .

Ecuaciones lineales

Los sistemas de ecuaciones lineales homogéneas están estrechamente ligados a los espacios vectoriales. [36] Por ejemplo, las soluciones de están dadas por ternas con y arbitrarias Forman un espacio vectorial: las sumas y los múltiplos escalares de dichas ternas aún satisfacen las mismas razones de las tres variables; por lo tanto, también son soluciones. Las matrices se pueden utilizar para condensar múltiples ecuaciones lineales como las anteriores en una ecuación vectorial, es decir

donde es la matriz que contiene los coeficientes de las ecuaciones dadas, es el vector que denota el producto matricial y es el vector cero. De manera similar, las soluciones de ecuaciones diferenciales lineales homogéneas forman espacios vectoriales. Por ejemplo,

produce donde y son constantes arbitrarias, y es la función exponencial natural .

Mapas lineales y matrices

La relación de dos espacios vectoriales se puede expresar mediante una función lineal o una transformación lineal . Son funciones que reflejan la estructura del espacio vectorial, es decir, conservan las sumas y la multiplicación escalar: para todos y en todos en [37]

Un isomorfismo es una función lineal f : V → W tal que existe una función inversa g : W → V , que es una función tal que las dos composiciones posibles f ∘ g : W → W y g ∘ f : V → V son funciones identidad . De manera equivalente, f es tanto uno a uno ( inyectiva ) como sobreyectiva ( sobreyectiva ). [38] Si existe un isomorfismo entre V y W , se dice que los dos espacios son isomorfos ; entonces son esencialmente idénticos como espacios vectoriales, ya que todas las identidades que se cumplen en V son, a través de f , transportadas a otras similares en W , y viceversa a través de g .

Por ejemplo, las flechas en el plano y los pares ordenados de espacios vectoriales de números en la introducción anterior (ver § Ejemplos) son isomorfos: una flecha plana v que parte del origen de algún sistema de coordenadas (fijo) se puede expresar como un par ordenado considerando los componentes x e y de la flecha, como se muestra en la imagen de la derecha. Por el contrario, dado un par ( x , y ) , la flecha que va por x hacia la derecha (o hacia la izquierda, si x es negativo), y y hacia arriba (hacia abajo, si y es negativo) hace retroceder la flecha v . [39]

Las aplicaciones lineales V → W entre dos espacios vectoriales forman un espacio vectorial Hom F ( V , W ) , también denotado L( V , W ) , o 𝓛( V , W ) . [40] El espacio de aplicaciones lineales de V a F se llama espacio vectorial dual , denotado V ∗ . [41] A través de la función natural inyectiva V → V ∗∗ , cualquier espacio vectorial puede ser incorporado a su bidual ; la función es un isomorfismo si y solo si el espacio es de dimensión finita. [42]

Una vez que se elige una base de V , las aplicaciones lineales f : V → W se determinan completamente especificando las imágenes de los vectores base, porque cualquier elemento de V se expresa únicamente como una combinación lineal de ellos. [43] Si dim V = dim W , una correspondencia biunívoca entre bases fijas de V y W da lugar a una aplicación lineal que asigna cualquier elemento base de V al elemento base correspondiente de W . Es un isomorfismo, por su propia definición. [44] Por lo tanto, dos espacios vectoriales sobre un cuerpo dado son isomorfos si sus dimensiones concuerdan y viceversa. Otra forma de expresar esto es que cualquier espacio vectorial sobre un cuerpo dado se clasifica completamente ( hasta el isomorfismo) por su dimensión, un solo número. En particular, cualquier espacio vectorial F n -dimensional V es isomorfo a F n . Sin embargo, no existe un isomorfismo "canónico" o preferido; un isomorfismo φ : F n → V es equivalente a la elección de una base de V , al mapear la base estándar de F n a V , a través de φ .

Matrices

Las matrices son un concepto útil para codificar aplicaciones lineales. [45] Se escriben como una matriz rectangular de escalares como en la imagen de la derecha. Cualquier matriz de m por n da lugar a una aplicación lineal de F n a F m , mediante la siguiente fórmula donde denota suma , o mediante la multiplicación matricial de la matriz con el vector de coordenadas :

Además, después de elegir las bases de V y W , cualquier mapa lineal f : V → W está representado de forma única por una matriz a través de esta asignación. [46]

El determinante det ( A ) de una matriz cuadrada A es un escalar que indica si la función asociada es un isomorfismo o no: para serlo es suficiente y necesario que el determinante sea distinto de cero. [47] La transformación lineal de R n correspondiente a una matriz real n -por- n preserva la orientación si y sólo si su determinante es positivo.

Valores propios y vectores propios

Los endomorfismos , aplicaciones lineales f : V → V , son particularmente importantes ya que en este caso los vectores v pueden compararse con su imagen bajo f , f ( v ) . Cualquier vector distinto de cero v que satisfaga λ v = f ( v ) , donde λ es un escalar, se llama vector propio de f con valor propio λ . [48] De manera equivalente, v es un elemento del núcleo de la diferencia f − λ · Id (donde Id es la aplicación identidad V → V ) . Si V es de dimensión finita, esto puede reformularse utilizando determinantes: f que tiene valor propio λ es equivalente a Al deletrear la definición del determinante, se puede ver que la expresión del lado izquierdo es una función polinómica en λ , llamada polinomio característico de f . [49] Si el campo F es lo suficientemente grande para contener un cero de este polinomio (lo que ocurre automáticamente para F algebraicamente cerrado , como F = C ), cualquier función lineal tiene al menos un vector propio. El espacio vectorial V puede o no poseer una base propia , una base que consiste en vectores propios. Este fenómeno está regido por la forma canónica de Jordan de la función. [50] El conjunto de todos los vectores propios correspondientes a un valor propio particular de f forma un espacio vectorial conocido como el espacio propio correspondiente al valor propio (y f ) en cuestión.

Construcciones básicas

Además de los ejemplos concretos anteriores, hay una serie de construcciones algebraicas lineales estándar que producen espacios vectoriales relacionados con los dados.

Subespacios y espacios cocientes

Un subconjunto no vacío de un espacio vectorial que está cerrado bajo la adición y la multiplicación escalar (y por lo tanto contiene el -vector de ) se denomina subespacio lineal de , o simplemente subespacio de , cuando el espacio ambiente es inequívocamente un espacio vectorial. [51] [nb 4] Los subespacios de son espacios vectoriales (sobre el mismo cuerpo) por derecho propio. La intersección de todos los subespacios que contienen un conjunto dado de vectores se denomina su amplitud , y es el subespacio más pequeño de que contiene el conjunto . Expresado en términos de elementos, la amplitud es el subespacio que consiste en todas las combinaciones lineales de elementos de . [52]

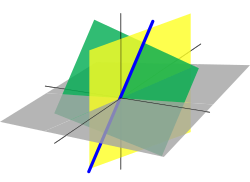

Los subespacios lineales de dimensión 1 y 2 se denominan línea (también línea vectorial ) y plano respectivamente. Si W es un espacio vectorial n -dimensional, cualquier subespacio de dimensión 1 menos, es decir, de dimensión 1, se denomina hiperplano . [53]

La contraparte de los subespacios son los espacios vectoriales cocientes . [54] Dado cualquier subespacio , el espacio cociente (" módulo ") se define de la siguiente manera: como un conjunto, consiste en donde es un vector arbitrario en . La suma de dos de tales elementos y es , y la multiplicación escalar está dada por . El punto clave en esta definición es que si y solo si la diferencia de y se encuentra en . [nb 5] De esta manera, el espacio cociente "olvida" información que está contenida en el subespacio .

El núcleo de un mapa lineal consta de vectores que se asignan a en . [55] El núcleo y la imagen son subespacios de y , respectivamente. [56]

Un ejemplo importante es el núcleo de una función lineal para alguna matriz fija . El núcleo de esta función es el subespacio de vectores tales que , que es precisamente el conjunto de soluciones del sistema de ecuaciones lineales homogéneas perteneciente a . Este concepto también se extiende a ecuaciones diferenciales lineales donde los coeficientes son funciones en también. En la función correspondiente, las derivadas de la función aparecen linealmente (en oposición a , por ejemplo). Dado que la diferenciación es un procedimiento lineal (es decir, y para una constante ), esta asignación es lineal, llamada operador diferencial lineal . En particular, las soluciones de la ecuación diferencial forman un espacio vectorial (sobre R o C ). [57]

La existencia de núcleos e imágenes es parte de la afirmación de que la categoría de espacios vectoriales (sobre un cuerpo fijo ) es una categoría abeliana , es decir, un corpus de objetos matemáticos y mapas que preservan la estructura entre ellos (una categoría ) que se comporta de manera muy similar a la categoría de grupos abelianos . [58] Debido a esto, muchas afirmaciones como el primer teorema de isomorfismo (también llamado teorema de rango-nulidad en términos relacionados con matrices) y el segundo y tercer teorema de isomorfismo se pueden formular y demostrar de una manera muy similar a las afirmaciones correspondientes para los grupos .

Producto directo y suma directa

El producto directo de espacios vectoriales y la suma directa de espacios vectoriales son dos formas de combinar una familia indexada de espacios vectoriales en un nuevo espacio vectorial.

El producto directo de una familia de espacios vectoriales consiste en el conjunto de todas las tuplas , que especifican para cada índice en algún conjunto de índices un elemento de . [59] La adición y la multiplicación escalar se realizan componente por componente. Una variante de esta construcción es la suma directa (también llamada coproducto y denotada como ), donde solo se permiten tuplas con un número finito de vectores distintos de cero. Si el conjunto de índices es finito, las dos construcciones coinciden, pero en general son diferentes.

Producto tensorial

El producto tensorial o simplemente de dos espacios vectoriales es una de las nociones centrales del álgebra multilineal que trata de extender nociones como las aplicaciones lineales a varias variables. Una aplicación del producto cartesiano se llama bilineal si es lineal en ambas variables y Es decir, para fija la aplicación es lineal en el sentido anterior y lo mismo para fija

El producto tensorial es un espacio vectorial particular que es un receptor universal de aplicaciones bilineales como sigue. Se define como el espacio vectorial que consiste en sumas finitas (formales) de símbolos llamados tensores sujetos a las reglas [60] Estas reglas aseguran que la aplicación desde el a que asigna una tupla a es bilineal. La universalidad establece que dado cualquier espacio vectorial y cualquier aplicación bilineal existe una aplicación única mostrada en el diagrama con una flecha punteada, cuya composición con es igual a [61] Esto se llama la propiedad universal del producto tensorial, una instancia del método—muy usado en álgebra abstracta avanzada—para definir objetos indirectamente especificando aplicaciones desde o hacia este objeto.

Espacios vectoriales con estructura adicional

Desde el punto de vista del álgebra lineal, los espacios vectoriales se entienden completamente en la medida en que cualquier espacio vectorial sobre un cuerpo dado se caracteriza, salvo isomorfismo, por su dimensión. Sin embargo, los espacios vectoriales per se no ofrecen un marco para tratar la cuestión —crucial para el análisis— de si una secuencia de funciones converge a otra función. Asimismo, el álgebra lineal no está adaptada para tratar series infinitas , ya que la operación de adición sólo permite sumar un número finito de términos. Por lo tanto, las necesidades del análisis funcional requieren considerar estructuras adicionales. [62]

A un espacio vectorial se le puede dar un orden parcial bajo el cual se pueden comparar algunos vectores. [63] Por ejemplo, el espacio real de dimensión 1 puede ordenarse comparando sus vectores por componentes. Los espacios vectoriales ordenados , por ejemplo los espacios de Riesz , son fundamentales para la integración de Lebesgue , que se basa en la capacidad de expresar una función como una diferencia de dos funciones positivas donde denota la parte positiva de y la parte negativa. [64]

Espacios vectoriales normados y espacios de producto interno

La "medición" de vectores se realiza especificando una norma , un dato que mide las longitudes de los vectores, o mediante un producto interno , que mide los ángulos entre vectores. Las normas y los productos internos se denotan como y respectivamente. El dato de un producto interno implica que las longitudes de los vectores también se pueden definir, definiendo la norma asociada. Los espacios vectoriales dotados de tales datos se conocen como espacios vectoriales normados y espacios de producto interno , respectivamente. [65]

El espacio de coordenadas puede estar equipado con el producto escalar estándar : En esto refleja la noción común del ángulo entre dos vectores y por la ley de los cosenos : Debido a esto, dos vectores que satisfacen se llaman ortogonales . Una variante importante del producto escalar estándar se utiliza en el espacio de Minkowski : dotado con el producto de Lorentz [66] En contraste con el producto escalar estándar, no es definido positivo : también toma valores negativos, por ejemplo, para La selección de la cuarta coordenada , correspondiente al tiempo , en oposición a tres dimensiones espaciales, lo hace útil para el tratamiento matemático de la relatividad especial . Nótese que en otras convenciones el tiempo a menudo se escribe como el primer componente, o "cero", de modo que el producto de Lorentz se escribe

Espacios vectoriales topológicos

Las cuestiones de convergencia se tratan considerando espacios vectoriales que tienen una topología compatible , una estructura que permite hablar de elementos que están cerca unos de otros . [67] Compatible aquí significa que la suma y la multiplicación escalar tienen que ser mapas continuos . Aproximadamente, si y en , y en varían en una cantidad acotada, entonces también lo hacen y [nb 6] Para que tenga sentido especificar la cantidad que cambia un escalar, el cuerpo también tiene que tener una topología en este contexto; una elección común son los números reales o los números complejos.

En tales espacios vectoriales topológicos se pueden considerar series de vectores. La suma infinita denota el límite de las sumas parciales finitas correspondientes de la secuencia de elementos de Por ejemplo, podrían ser funciones (reales o complejas) pertenecientes a algún espacio de funciones , en cuyo caso la serie es una serie de funciones . El modo de convergencia de la serie depende de la topología impuesta al espacio de funciones. En tales casos, la convergencia puntual y la convergencia uniforme son dos ejemplos destacados. [68]

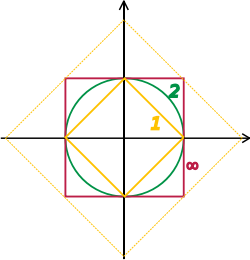

Una forma de asegurar la existencia de límites de ciertas series infinitas es restringir la atención a espacios donde cualquier secuencia de Cauchy tiene un límite; un espacio vectorial de este tipo se llama completo . En términos generales, un espacio vectorial es completo siempre que contenga todos los límites necesarios. Por ejemplo, el espacio vectorial de polinomios en el intervalo unitario equipado con la topología de convergencia uniforme no es completo porque cualquier función continua en puede aproximarse uniformemente mediante una secuencia de polinomios, por el teorema de aproximación de Weierstrass . [69] En contraste, el espacio de todas las funciones continuas en con la misma topología es completo. [70] Una norma da lugar a una topología al definir que una secuencia de vectores converge a si y solo si los espacios de Banach y Hilbert son espacios vectoriales topológicos completos cuyas topologías están dadas, respectivamente, por una norma y un producto interno. Su estudio, una pieza clave del análisis funcional, se centra en los espacios vectoriales de dimensión infinita, ya que todas las normas sobre espacios vectoriales topológicos de dimensión finita dan lugar a la misma noción de convergencia. [71] La imagen de la derecha muestra la equivalencia de la norma y la norma en . A medida que las "bolas" unitarias se encierran entre sí, una secuencia converge a cero en una norma si y solo si lo hace también en la otra norma. Sin embargo, en el caso de dimensión infinita, generalmente habrá topologías no equivalentes, lo que hace que el estudio de los espacios vectoriales topológicos sea más rico que el de los espacios vectoriales sin datos adicionales.

Desde un punto de vista conceptual, todas las nociones relacionadas con los espacios vectoriales topológicos deben coincidir con la topología. Por ejemplo, en lugar de considerar todos los mapas lineales (también llamados funcionales ), se requiere que los mapas entre espacios vectoriales topológicos sean continuos. [72] En particular, el espacio dual (topológico) consta de funcionales continuos (o a ). El teorema fundamental de Hahn-Banach se ocupa de separar subespacios de espacios vectoriales topológicos apropiados por funcionales continuos. [73]

Espacios de Banach

Los espacios de Banach , introducidos por Stefan Banach , son espacios vectoriales normados completos. [74]

Un primer ejemplo es el espacio vectorial constituido por infinitos vectores con entradas reales cuya -norma está dada por

Las topologías en el espacio de dimensión infinita son inequivalentes para diferentes Por ejemplo, la secuencia de vectores en la que los primeros componentes son y los siguientes son converge al vector cero para pero no para pero

De manera más general que las secuencias de números reales, las funciones están dotadas de una norma que reemplaza la suma anterior por la integral de Lebesgue.

El espacio de funciones integrables en un dominio dado (por ejemplo un intervalo) que satisfacen y están dotadas de esta norma se denominan espacios de Lebesgue , denotados [nb 7]

Estos espacios son completos. [75] (Si se utiliza la integral de Riemann en su lugar, el espacio no es completo, lo que puede verse como una justificación de la teoría de integración de Lebesgue. [nb 8] ) Concretamente, esto significa que para cualquier secuencia de funciones integrables de Lebesgue que satisfagan la condición existe una función que pertenece al espacio vectorial tal que

La imposición de condiciones de acotación no sólo a la función, sino también a sus derivadas conduce a espacios de Sobolev . [76]

Espacios de Hilbert

Los espacios de producto interno completos se conocen como espacios de Hilbert , en honor a David Hilbert . [77] El espacio de Hilbert con producto interno dado por donde denota el conjugado complejo de [78] [nb 9] es un caso clave.

Por definición, en un espacio de Hilbert, cualquier secuencia de Cauchy converge a un límite. A la inversa, encontrar una secuencia de funciones con propiedades deseables que se aproximen a una función límite dada es igualmente crucial. Un análisis temprano, bajo la apariencia de la aproximación de Taylor , estableció una aproximación de funciones diferenciables por polinomios. [79] Por el teorema de Stone-Weierstrass , cada función continua en puede aproximarse tan cerca como se desee por un polinomio. [80] Una técnica de aproximación similar por funciones trigonométricas se llama comúnmente expansión de Fourier , y se aplica mucho en ingeniería. De manera más general, y más conceptual, el teorema produce una descripción simple de qué "funciones básicas", o, en espacios de Hilbert abstractos, qué vectores básicos son suficientes para generar un espacio de Hilbert en el sentido de que el cierre de su espacio (es decir, combinaciones lineales finitas y límites de aquellas) es todo el espacio. Tal conjunto de funciones se llama base de su cardinalidad se conoce como la dimensión del espacio de Hilbert . [nb 10] El teorema no sólo muestra funciones base adecuadas como suficientes para fines de aproximación, sino que, junto con el proceso de Gram-Schmidt , permite construir una base de vectores ortogonales . [81] Dichas bases ortogonales son la generalización del espacio de Hilbert de los ejes de coordenadas en el espacio euclidiano de dimensión finita .

Las soluciones de varias ecuaciones diferenciales pueden interpretarse en términos de espacios de Hilbert. Por ejemplo, una gran cantidad de campos en física e ingeniería conducen a tales ecuaciones, y con frecuencia se utilizan soluciones con propiedades físicas particulares como funciones base, a menudo ortogonales. [82] Como ejemplo de la física, la ecuación de Schrödinger dependiente del tiempo en mecánica cuántica describe el cambio de propiedades físicas en el tiempo por medio de una ecuación diferencial parcial , cuyas soluciones se denominan funciones de onda . [83] Los valores definidos para propiedades físicas como la energía o el momento corresponden a valores propios de un determinado operador diferencial (lineal) y las funciones de onda asociadas se denominan estados propios . El teorema espectral descompone un operador compacto lineal que actúa sobre funciones en términos de estas funciones propias y sus valores propios. [84]

Álgebras sobre cuerpos

Los espacios vectoriales generales no poseen una multiplicación entre vectores. Un espacio vectorial equipado con un operador bilineal adicional que define la multiplicación de dos vectores es un álgebra sobre un cuerpo (o F -álgebra si se especifica el cuerpo F ). [85]

Por ejemplo, el conjunto de todos los polinomios forma un álgebra conocida como anillo polinomial : al utilizar que la suma de dos polinomios es un polinomio, forman un espacio vectorial; forman un álgebra ya que el producto de dos polinomios es nuevamente un polinomio. Los anillos de polinomios (en varias variables) y sus cocientes forman la base de la geometría algebraica , porque son anillos de funciones de objetos geométricos algebraicos . [86]

Otro ejemplo crucial son las álgebras de Lie , que no son ni conmutativas ni asociativas, pero el hecho de no serlo está limitado por las restricciones ( denota el producto de y ):

- ( anticonmutatividad ), y

- ( Identidad de Jacobi ). [87]

Los ejemplos incluyen el espacio vectorial de matrices -por- , con el conmutador de dos matrices, y dotado del producto vectorial .

El álgebra tensorial es una forma formal de sumar productos a cualquier espacio vectorial para obtener un álgebra. [88] Como espacio vectorial, está abarcado por símbolos, llamados tensores simples donde el grado varía. La multiplicación se da concatenando dichos símbolos, imponiendo la ley distributiva bajo la adición y requiriendo que la multiplicación escalar conmute con el producto tensorial ⊗, de forma muy similar al producto tensorial de dos espacios vectoriales introducido en la sección anterior sobre productos tensoriales. En general, no hay relaciones entre y Forzar dos de estos elementos para que sean iguales conduce al álgebra simétrica , mientras que forzar produce el álgebra exterior . [89]

Estructuras relacionadas

Paquetes de vectores

Un fibrado vectorial es una familia de espacios vectoriales parametrizados de forma continua por un espacio topológico X . [90] Más precisamente, un fibrado vectorial sobre X es un espacio topológico E equipado con una función continua tal que para cada x en X , la fibra π −1 ( x ) es un espacio vectorial. El caso dim V = 1 se denomina fibrado lineal . Para cualquier espacio vectorial V , la proyección X × V → X convierte el producto X × V en un fibrado vectorial "trivial" . Se requiere que los fibrados vectoriales sobre X sean localmente un producto de X y algún espacio vectorial (fijo) V : para cada x en X , existe una vecindad U de x tal que la restricción de π a π −1 ( U ) es isomorfa [nb 11] al fibrado trivial U × V → U . A pesar de su carácter localmente trivial, los fibrados vectoriales pueden (dependiendo de la forma del espacio subyacente X ) estar "retorcidos" en el espacio grande (es decir, el fibrado no necesita ser (globalmente isomorfo al) fibrado trivial X × V ). Por ejemplo, la banda de Möbius puede verse como un fibrado lineal sobre el círculo S 1 ( identificando intervalos abiertos con la línea real ). Sin embargo, es diferente del cilindro S 1 × R , porque este último es orientable mientras que el primero no lo es. [91]

Las propiedades de ciertos fibrados vectoriales proporcionan información sobre el espacio topológico subyacente. Por ejemplo, el fibrado tangente consiste en la colección de espacios tangentes parametrizados por los puntos de una variedad diferenciable. El fibrado tangente del círculo S 1 es globalmente isomorfo a S 1 × R , ya que hay un campo vectorial global distinto de cero en S 1 . [nb 12] En contraste, por el teorema de la bola peluda , no hay ningún campo vectorial (tangente) en la 2-esfera S 2 que sea en todas partes distinto de cero. [92] La teoría K estudia las clases de isomorfismo de todos los fibrados vectoriales sobre algún espacio topológico. [93] Además de profundizar en la comprensión topológica y geométrica, tiene consecuencias puramente algebraicas, como la clasificación de las álgebras de división real de dimensión finita : R , C , los cuaterniones H y los octoniones O .

El fibrado cotangente de una variedad diferenciable está constituido, en cada punto de la variedad, por el dual del espacio tangente, el espacio cotangente . Las secciones de ese fibrado se conocen como uniformas diferenciales .

Módulos

Los módulos son a los anillos lo que los espacios vectoriales son a los cuerpos: los mismos axiomas, aplicados a un anillo R en lugar de a un cuerpo F , producen módulos. [94] La teoría de módulos, comparada con la de espacios vectoriales, se complica por la presencia de elementos de anillo que no tienen inversos multiplicativos . Por ejemplo, los módulos no necesitan tener bases, como lo muestra el módulo Z (es decir, grupo abeliano ) Z /2 Z ; aquellos módulos que sí las tienen (incluyendo todos los espacios vectoriales) se conocen como módulos libres . Sin embargo, un espacio vectorial puede definirse de forma compacta como un módulo sobre un anillo que es un cuerpo , y los elementos se denominan vectores. Algunos autores utilizan el término espacio vectorial para referirse a los módulos sobre un anillo de división . [95] La interpretación algebrogeométrica de los anillos conmutativos a través de su espectro permite el desarrollo de conceptos como módulos localmente libres , la contraparte algebraica de los fibrados vectoriales.

Espacios afines y proyectivos

Aproximadamente, los espacios afines son espacios vectoriales cuyos orígenes no están especificados. [96] Más precisamente, un espacio afín es un conjunto con una acción de espacio vectorial transitiva libre . En particular, un espacio vectorial es un espacio afín sobre sí mismo, por la función Si W es un espacio vectorial, entonces un subespacio afín es un subconjunto de W obtenido al trasladar un subespacio lineal V por un vector fijo x ∈ W ; este espacio se denota por x + V (es una clase lateral de V en W ) y consiste en todos los vectores de la forma x + v para v ∈ V . Un ejemplo importante es el espacio de soluciones de un sistema de ecuaciones lineales no homogéneas que generalizan el caso homogéneo discutido en la sección anterior sobre ecuaciones lineales, que se puede encontrar al establecer en esta ecuación. [97] El espacio de soluciones es el subespacio afín x + V donde x es una solución particular de la ecuación, y V es el espacio de soluciones de la ecuación homogénea (el espacio nulo de A ).

El conjunto de subespacios unidimensionales de un espacio vectorial fijo de dimensión finita V se conoce como espacio proyectivo ; puede usarse para formalizar la idea de líneas paralelas que se intersecan en el infinito. [98] Los grassmannianos y las variedades de banderas generalizan esto parametrizando subespacios lineales de dimensión fija k y banderas de subespacios, respectivamente.

Notas

- ^ También es común, especialmente en física, denotar vectores con una flecha en la parte superior: También es común, especialmente en matemáticas superiores, no utilizar ningún método tipográfico para distinguir vectores de otros objetos matemáticos.

- ^ La multiplicación escalar no debe confundirse con el producto escalar , que es una operación adicional sobre algunos espacios vectoriales específicos, llamados espacios de producto interno . La multiplicación escalar es la multiplicación de un vector por un escalar que produce un vector, mientras que el producto escalar es una multiplicación de dos vectores que produce un escalar.

- ^ Este axioma no es una propiedad asociativa , ya que se refiere a dos operaciones diferentes, la multiplicación escalar y la multiplicación de cuerpos. Por lo tanto, es independiente de la asociatividad de la multiplicación de cuerpos, que se supone en los axiomas de cuerpos.

- ^ Este suele ser el caso cuando un espacio vectorial también se considera un espacio afín . En este caso, un subespacio lineal contiene el vector cero , mientras que un subespacio afín no necesariamente lo contiene.

- ^ Algunos autores, como Roman (2005), optan por partir de esta relación de equivalencia y derivar de ella la forma concreta de.

- ^ Este requisito implica que la topología da lugar a una estructura uniforme , Bourbaki (1989), loc = ch. II.

- ^ La desigualdad triangular para la proporciona la desigualdad de Minkowski . Por razones técnicas, en el contexto de funciones hay que identificar funciones que concuerden casi en todas partes para obtener una norma, y no solo una seminorma .

- ^ "Muchas funciones de medida de Lebesgue, al no estar acotadas, no pueden integrarse con la integral clásica de Riemann. Por lo tanto, los espacios de funciones integrables de Riemann no estarían completos en la norma y la descomposición ortogonal no se aplicaría a ellos. Esto muestra una de las ventajas de la integración de Lebesgue", Dudley (1989), §5.3, pág. 125.

- ^ Porque no es un espacio de Hilbert.

- ^ Una base de un espacio de Hilbert no es lo mismo que una base de un álgebra lineal. Para distinguirla, una base de álgebra lineal para un espacio de Hilbert se denomina base de Hamel .

- ^ Es decir, existe un homeomorfismo de π −1 ( U ) a V × U que se restringe a isomorfismos lineales entre fibras.

- ^ Un fibrado lineal, como el fibrado tangente de S 1, es trivial si y solo si existe una sección que no se anula en ninguna parte, véase Husemoller (1994), Corolario 8.3. Las secciones del fibrado tangente son simplemente campos vectoriales .

Citas

- ^ Lang 2002.

- ^ Brown 1991, pág. 86.

- ^ Romano 2005, cap. 1, pág. 27.

- ^ Brown 1991, pág. 87.

- ^ Springer 2000, pág. 185; Brown 1991, pág. 86.

- ^ Atiyah y Macdonald 1969, pág. 17.

- ^ Bourbaki 1998, §1.1, Definición 2.

- ^ Brown 1991, pág. 94.

- ^ Brown 1991, págs. 99-101.

- ^ Brown 1991, pág. 92.

- ^ desde Stoll y Wong 1968, pág. 14.

- ^ Romano 2005, págs. 41–42.

- ^ Lang 1987, pag. 10–11; Antón y Rorres 2010, pág. 212.

- ^ Blass 1984.

- ^ Joshi 1989, pág. 450.

- ^ Heil 2011, pág. 126.

- ^ Halmos 1948, pág. 12.

- ^ Bourbaki 1969, cap. "Algèbre linéaire et algèbre multilinéaire", págs. 78–91.

- ^ Bolzano 1804.

- ^ Möbius 1827.

- ^ Bellavitis 1833.

- ^ Dorier 1995.

- ^ Hamilton 1853.

- ^ Grassman 2000.

- ^ Peano 1888, cap. IX.

- ^ Guo 2021.

- ^ Moore 1995, págs. 268-271.

- ^ Banach 1922.

- ^ Dorier 1995; Moore 1995.

- ^ Kreyszig 2020, pág. 355.

- ^ Kreyszig 2020, pag. 358–359.

- ^ Jain 2001, pág. 11.

- ^ Lang 1987, cap. I.1.

- ^ Lang 2002, cap. V.1.

- ^ Lang 1993, cap. XII.3., pág. 335.

- ^ Lang 1987, cap. VI.3..

- ^ Romano 2005, cap. 2, pág. 45.

- ^ Lang 1987, cap. IV.4, Corolario, pág. 106.

- ^ Nicholson 2018, cap. 7.3.

- ^ Lang 1987, Ejemplo IV.2.6.

- ^ Lang 1987, cap. VI.6.

- ^ Halmos 1974, pág. 28, Ejemplo 9.

- ^ Lang 1987, Teorema IV.2.1, pág. 95.

- ^ Roman 2005, Th. 2.5 y 2.6, pág. 49.

- ^ Lang 1987, cap. V.1.

- ^ Lang 1987, cap. V.3., Corolario, pág. 106.

- ^ Lang 1987, Teorema VII.9.8, pág. 198.

- ^ Roman 2005, cap. 8, pág. 135–156.

- ^ & Lang 1987, cap. IX.4.

- ^ Romano 2005, cap. 8, pág. 140.

- ^ Romano 2005, cap. 1, pág. 29.

- ^ Romano 2005, cap. 1, pág. 35.

- ^ Nicholson 2018, cap. 10.4.

- ^ Romano 2005, cap. 3, pág. 64.

- ^ Lang 1987, cap. IV.3..

- ^ Romano 2005, cap. 2, pág. 48.

- ^ Nicholson 2018, cap. 7.4.

- ^ Mac Lane 1998.

- ^ Roman 2005, cap. 1, págs. 31–32.

- ^ Lang 2002, cap. XVI.1.

- ^ Roman (2005), Th. 14.3. Véase también el lema de Yoneda .

- ^ Rudin 1991, pág.3.

- ^ Schaefer y Wolff 1999, págs. 204-205.

- ^ Bourbaki 2004, cap. 2, pág. 48.

- ^ Roman 2005, cap. 9.

- ^ Naber 2003, cap. 1.2.

- ^ Tréves 1967; Bourbaki 1987.

- ^ Schaefer y Wolff 1999, pág. 7.

- ^ Kreyszig 1989, §4.11-5

- ^ Kreyszig 1989, §1.5-5

- ^ Choquet 1966, Proposición III.7.2.

- ^ Treves 1967, págs. 34–36.

- ^ Lang 1983, Cor. 4.1.2, pág. 69.

- ^ Treves 1967, cap. 11.

- ^ Treves 1967, Teorema 11.2, pág. 102.

- ^ Evans 1998, cap. 5.

- ^ Treves 1967, cap. 12.

- ^ Dennery y Krzywicki 1996, p.190.

- ^ Lang 1993, Th. XIII.6, pág. 349.

- ^ Lang 1993, Tesis III.1.1.

- ^ Choquet 1966, Lema III.16.11.

- ^ Kreyszig 1999, Capítulo 11.

- ^ Griffiths 1995, Capítulo 1.

- ^ Lang 1993, cap. XVII.3.

- ^ Lang 2002, cap. III.1, pág. 121.

- ^ Eisenbud 1995, cap. 1.6.

- ^ Varadarajan 1974.

- ^ Lang 2002, cap. XVI.7.

- ^ Lang 2002, cap. XVI.8.

- ^ Spivak 1999, cap. 3.

- ^ Kreyszig 1991, §34, pág. 108.

- ^ Eisenberg y Guy 1979.

- ^ Atia 1989.

- ^ Artin 1991, cap. 12.

- ^ Parrilla 2007.

- ^ Meyer 2000, Ejemplo 5.13.5, pág. 436.

- ^ Meyer 2000, Ejercicio 5.13.15–17, pág. 442.

- ^ Coxeter 1987.

Referencias

Álgebra

- Anton, Howard; Rorres, Chris (2010), Álgebra lineal elemental: versión de aplicaciones (10.ª ed.), John Wiley & Sons

- Artin, Michael (1991), Álgebra , Prentice Hall , ISBN 978-0-89871-510-1

- Brown, William A. (1991), Matrices y espacios vectoriales , Nueva York: M. Dekker, ISBN 978-0-8247-8419-5

- Grillet, Pierre Antoine (2007), Álgebra abstracta , vol. 242, Springer Science & Business Media, doi :10.1007/978-0-387-71568-1, ISBN 978-0-387-71568-1

- Halmos, Paul R. (1948), Espacios vectoriales de dimensión finita , vol. 7, Princeton University Press

- Heil, Christopher (2011), Introducción a la teoría de bases: edición ampliada , Análisis armónico numérico y aplicado, Birkhäuser, doi : 10.1007/978-0-8176-4687-5, ISBN 978-0-8176-4687-5

- Jain, MC (2001), Espacios vectoriales y matrices en física, CRC Press, ISBN 978-0-8493-0978-6

- Joshi, KD (1989), Fundamentos de las matemáticas discretas , John Wiley & Sons

- Kreyszig, Erwin (2020), Matemáticas avanzadas de ingeniería, John Wiley & Sons, ISBN 978-1-119-45592-9

- Lang, Serge (1987), Álgebra lineal , Textos de pregrado en matemáticas (3.ª ed.), Springer, doi : 10.1007/978-1-4757-1949-9, ISBN 978-1-4757-1949-9

- Lang, Serge (2002), Álgebra , Textos de posgrado en matemáticas , vol. 211 (tercera edición revisada), Nueva York: Springer-Verlag, ISBN 978-0-387-95385-4, Sr. 1878556

- Mac Lane, Saunders (1999), Álgebra (3.ª ed.), American Mathematical Soc., págs. 193–222, ISBN 978-0-8218-1646-2

- Meyer, Carl D. (2000), Análisis matricial y álgebra lineal aplicada, SIAM , ISBN 978-0-89871-454-8

- Nicholson, W. Keith (2018), Álgebra lineal con aplicaciones, Lyryx

- Roman, Steven (2005), Álgebra lineal avanzada , Textos de posgrado en matemáticas, vol. 135 (2.ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-24766-3

- Spindler, Karlheinz (1993), Álgebra abstracta con aplicaciones: Volumen 1: Espacios vectoriales y grupos , CRC, ISBN 978-0-8247-9144-5

- Springer, TA (2000), Grupos algebraicos lineales, Springer, ISBN 978-0-8176-4840-4

- Stoll, RR; Wong, ET (1968), Álgebra lineal , Academic Press

- van der Waerden, Bartel Leendert (1993), Álgebra (en alemán) (9ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-56799-8

Análisis

- Bourbaki, Nicolas (1987), Espacios vectoriales topológicos , Elementos de matemáticas, Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-13627-9

- Bourbaki, Nicolas (2004), Integración I , Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-41129-1

- Braun, Martin (1993), Ecuaciones diferenciales y sus aplicaciones: una introducción a las matemáticas aplicadas , Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-97894-9

- BSE-3 (2001) [1994], "Plano tangente", Enciclopedia de Matemáticas , EMS Press

- Choquet, Gustave (1966), Topología , Boston, MA: Academic Press

- Dennery, Philippe; Krzywicki, Andre (1996), Matemáticas para físicos , Courier Dover Publications, ISBN 978-0-486-69193-0

- Dudley, Richard M. (1989), Análisis real y probabilidad , The Wadsworth & Brooks/Cole Mathematics Series, Pacific Grove, CA: Wadsworth & Brooks/Cole Advanced Books & Software, ISBN 978-0-534-10050-6

- Dunham, William (2005), La galería del cálculo , Princeton University Press , ISBN 978-0-691-09565-3

- Evans, Lawrence C. (1998), Ecuaciones diferenciales parciales , Providence, RI: American Mathematical Society , ISBN 978-0-8218-0772-9

- Folland, Gerald B. (1992), Análisis de Fourier y sus aplicaciones , Brooks-Cole, ISBN 978-0-534-17094-3

- Gasquet, Claude; Witomski, Patrick (1999), Análisis de Fourier y aplicaciones: filtrado, cálculo numérico, wavelets , Textos en matemáticas aplicadas, Nueva York: Springer-Verlag, ISBN 978-0-387-98485-8

- Ifeachor, Emmanuel C.; Jervis, Barrie W. (2001), Procesamiento de señales digitales: un enfoque práctico (2.ª ed.), Harlow, Essex, Inglaterra: Prentice-Hall (publicado en 2002), ISBN 978-0-201-59619-9

- Krantz, Steven G. (1999), Un panorama del análisis armónico , Carus Mathematical Monographs, Washington, DC: Asociación Matemática de América, ISBN 978-0-88385-031-2

- Kreyszig, Erwin (1988), Matemáticas avanzadas de ingeniería (6.ª ed.), Nueva York: John Wiley & Sons, ISBN 978-0-471-85824-9

- Kreyszig, Erwin (1989), Análisis funcional introductorio con aplicaciones , Wiley Classics Library, Nueva York: John Wiley & Sons , ISBN 978-0-471-50459-7, Sr. 0992618

- Lang, Serge (1983), Análisis real , Addison-Wesley , ISBN 978-0-201-14179-5

- Lang, Serge (1993), Análisis real y funcional , Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-94001-4

- Loomis, Lynn H. (2011) [1953], Una introducción al análisis armónico abstracto , Dover, hdl : 2027/uc1.b4250788 , ISBN 978-0-486-48123-4, OCLC 702357363

- Narici, Lawrence; Beckenstein, Edward (2011). Espacios vectoriales topológicos . Matemáticas puras y aplicadas (segunda edición). Boca Raton, FL: CRC Press. ISBN 978-1584888666.OCLC 144216834 .

- Rudin, Walter (1991), Análisis funcional (2.ª ed.), McGraw-Hill, ISBN 0070542368

- Schaefer, Helmut H. ; Wolff, Manfred P. (1999). Espacios vectoriales topológicos . GTM . Vol. 8 (Segunda ed.). Nueva York, NY: Springer New York Imprenta Springer. ISBN 978-1-4612-7155-0.OCLC 840278135 .

- Treves, François (1967), Espacios vectoriales topológicos, distribuciones y núcleos , Boston, MA: Academic Press

Referencias históricas

- Banach, Stefan (1922), "Sur les opérations dans les ensembles abstraits et leur application aux équations intégrales (Sobre operaciones en conjuntos abstractos y su aplicación a ecuaciones integrales)" (PDF) , Fundamenta Mathematicae (en francés), 3 : 133– 181, doi :10.4064/fm-3-1-133-181, ISSN 0016-2736

- Bolzano, Bernard (1804), Betrachtungen über einige Gegenstände der Elementargeometrie (Consideraciones de algunos aspectos de la geometría elemental) (en alemán)

- Bellavitis, Giuso (1833), "Sopra alcune applicazioni di un nuovo metodo di geometria analitica", Il poligrafo giornale di scienze, lettre ed arti , 13 , Verona: 53–61.

- Bourbaki, Nicolas (1969), Éléments d'histoire des mathématiques (Elementos de la historia de las matemáticas) (en francés), París: Hermann

- Dorier, Jean-Luc (1995), "Un esquema general de la génesis de la teoría del espacio vectorial", Historia Mathematica , 22 (3): 227–261, doi : 10.1006/hmat.1995.1024 , MR 1347828

- Fourier, Jean Baptiste Joseph (1822), Théorie analytique de la chaleur (en francés), Chez Firmin Didot, père et fils

- Grassmann, Hermann (1844), Die Lineale Ausdehnungslehre - Ein neuer Zweig der Mathematik (en alemán), O. Wigand, reimpresión: Grassmann, Hermann (2000), Kannenberg, LC (ed.), Extension Theory , traducido por Kannenberg, Lloyd C., Providence, RI: American Mathematical Society , ISBN 978-0-8218-2031-5

- Guo, Hongyu (16 de junio de 2021), ¿Qué son exactamente los tensores?, World Scientific, ISBN 978-981-12-4103-1

- Hamilton, William Rowan (1853), Conferencias sobre cuaterniones, Real Academia Irlandesa

- Möbius, August Ferdinand (1827), Der Barycentrische Calcul: ein neues Hülfsmittel zur analytischen Behandlung der Geometrie (Cálculo baricéntrico: una nueva utilidad para un tratamiento analítico de la geometría) (en alemán), archivado desde el original el 23 de noviembre de 2006

- Moore, Gregory H. (1995), "La axiomatización del álgebra lineal: 1875-1940", Historia Mathematica , 22 (3): 262-303, doi : 10.1006/hmat.1995.1025

- Peano, Giuseppe (1888), Calcolo Geométrico secondo l'Ausdehnungslehre di H. Grassmann preceduto dalle Operazioni della Logica Deduttiva (en italiano), Turín

{{citation}}: CS1 maint: location missing publisher (link) - Peano, G. (1901) Formulario matemático : axiomas vct vía Internet Archive

Referencias adicionales

- Ashcroft, Neil ; Mermin, N. David (1976), Física del estado sólido , Toronto: Thomson Learning, ISBN 978-0-03-083993-1

- Atiyah, Michael Francis (1989), Teoría K , Advanced Book Classics (2.ª ed.), Addison-Wesley , ISBN 978-0-201-09394-0, Sr. 1043170

- Atiyah, Michael Francis ; Macdonald, Ian Grant (1969), Introducción al álgebra conmutativa , Advanced Book Classics, Addison-Wesley

- Blass, Andreas (1984), "La existencia de bases implica el axioma de elección" (PDF) , Teoría de conjuntos axiomáticos , Contemporary Mathematics volumen 31, Providence, RI: American Mathematical Society , pp. 31–33, ISBN 978-0-8218-5026-8, Sr. 0763890

- Bourbaki, Nicolas (1998), Elementos de matemáticas: Álgebra I, capítulos 1-3 , Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-64243-5

- Bourbaki, Nicolas (1989), Topología general. Capítulos 1-4 , Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-64241-1

- Coxeter, Harold Scott MacDonald (1987), Geometría proyectiva (2.ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-96532-1

- Eisenberg, Murray; Guy, Robert (1979), "Una prueba del teorema de la bola peluda", The American Mathematical Monthly , 86 (7): 572–574, doi :10.2307/2320587, JSTOR 2320587

- Eisenbud, David (1995), Álgebra conmutativa , Textos de posgrado en matemáticas, vol. 150, Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-94269-8, Sr. 1322960

- Goldrei, Derek (1996), Teoría de conjuntos clásica: un estudio independiente guiado (1.ª ed.), Londres: Chapman and Hall , ISBN 978-0-412-60610-6

- Griffiths, David J. (1995), Introducción a la mecánica cuántica , Upper Saddle River, NJ: Prentice Hall , ISBN 978-0-13-124405-4

- Halmos, Paul R. (1974), Espacios vectoriales de dimensión finita , Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-90093-3

- Halpern, James D. (junio de 1966), "Bases en espacios vectoriales y el axioma de elección", Actas de la American Mathematical Society , 17 (3): 670–673, doi : 10.2307/2035388 , JSTOR 2035388

- Hughes-Hallett, Deborah; McCallum, William G.; Gleason, Andrew M. (2013), Cálculo: de una y varias variables (6.ª ed.), John Wiley & Sons , ISBN 978-0470-88861-2

- Husemoller, Dale (1994), Fiber Bundles (3.ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-94087-8

- Jost, Jürgen (2005), Geometría riemanniana y análisis geométrico (4.ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-3-540-25907-7

- Kreyszig, Erwin (1991), Geometría diferencial , Nueva York: Dover Publications , pp. xiv+352, ISBN 978-0-486-66721-8

- Kreyszig, Erwin (1999), Matemáticas avanzadas de ingeniería (8.ª ed.), Nueva York: John Wiley & Sons , ISBN 978-0-471-15496-9

- Luenberger, David (1997), Optimización por métodos de espacio vectorial , Nueva York: John Wiley & Sons , ISBN 978-0-471-18117-0

- Mac Lane, Saunders (1998), Categorías para el matemático en activo (2.ª ed.), Berlín, Nueva York: Springer-Verlag , ISBN 978-0-387-98403-2

- Misner, Charles W .; Thorne, Kip ; Wheeler, John Archibald (1973), Gravitación , WH Freeman, ISBN 978-0-7167-0344-0

- Naber, Gregory L. (2003), La geometría del espacio-tiempo de Minkowski , Nueva York: Dover Publications , ISBN 978-0-486-43235-9, Sr. 2044239

- Schönhage, A .; Strassen, Volker (1971), "Schnelle Multiplikation großer Zahlen (Multiplicación rápida de números grandes)", Computing (en alemán), 7 (3–4): 281–292, doi :10.1007/bf02242355, ISSN 0010-485X, S2CID 9738629

- Spivak, Michael (1999), Una introducción completa a la geometría diferencial (volumen dos) , Houston, TX: Publish or Perish

- Stewart, Ian (1975), Teoría de Galois , Chapman and Hall Mathematics Series, Londres: Chapman and Hall , ISBN 978-0-412-10800-6

- Varadarajan, VS (1974), Grupos de Lie, álgebras de Lie y sus representaciones , Prentice Hall , ISBN 978-0-13-535732-3

- Wallace, GK (febrero de 1992), "El estándar de compresión de imágenes fijas JPEG" (PDF) , IEEE Transactions on Consumer Electronics , 38 (1): xviii–xxxiv, CiteSeerX 10.1.1.318.4292 , doi :10.1109/30.125072, ISSN 0098-3063, archivado desde el original (PDF) el 2007-01-13 , consultado el 2017-10-25

- Weibel, Charles A. (1994). Introducción al álgebra homológica . Cambridge Studies in Advanced Mathematics. Vol. 38. Cambridge University Press. ISBN 978-0-521-55987-4. Sr. 1269324. OCLC 36131259.

Enlaces externos

- "Espacio vectorial", Enciclopedia de Matemáticas , EMS Press , 2001 [1994]

![{\estilo de visualización [0,1],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/971caee396752d8bf56711f55d2c3b1207d4a236)

![{\estilo de visualización [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/738f7d23bb2d9642bab520020873cccbef49768d)

![{\estilo de visualización [a,b]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9c4b788fc5c637e26ee98b45f89a5c08c85f7935)

![{\displaystyle \mathbf {R}[x,y]/(x\cdot y-1),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7ba7424ec2e6bf0fc108cb223ae2d6209c67b44d)

![{\estilo de visualización [x,y]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1b7bd6292c6023626c6358bfd3943a031b27d663)

![{\displaystyle [x,y]=-[y,x]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f70fcda86c14de45e211c3a9a889845038bb7348)

![{\displaystyle [x,[y,z]]+[y,[z,x]]+[z,[x,y]]=0}](https://wikimedia.org/api/rest_v1/media/math/render/svg/23655a62f2a7cc545f121d9bcc30fe2c56731457)

![{\displaystyle [x,y]=xy-yx,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8c9d7bc98d1738f549c0420244c08c57decc66b3)