Sesgo de confirmación

El sesgo de confirmación (también sesgo confirmatorio , sesgo de mi lado [a] o sesgo de simpatía [2] ) es la tendencia a buscar, interpretar, favorecer y recordar información de una manera que confirme o respalde las creencias o valores previos de uno. [3] Las personas muestran este sesgo cuando seleccionan información que respalda sus puntos de vista, ignorando información contraria, o cuando interpretan evidencia ambigua como respaldo de sus actitudes existentes. El efecto es más fuerte para los resultados deseados, para los problemas con carga emocional y para las creencias profundamente arraigadas.

Se han invocado la búsqueda sesgada de información, la interpretación sesgada de esa información y la recuperación sesgada de la memoria para explicar cuatro efectos específicos:

- polarización de actitudes (cuando un desacuerdo se vuelve más extremo a pesar de que las diferentes partes están expuestas a la misma evidencia)

- Perseverancia de creencias (cuando las creencias persisten después de que se demuestra que la evidencia a favor de ellas es falsa)

- El efecto de primacía irracional (una mayor dependencia de la información encontrada al principio de una serie)

- correlación ilusoria (cuando las personas perciben falsamente una asociación entre dos eventos o situaciones).

Una serie de experimentos psicológicos realizados en la década de 1960 sugirieron que las personas tienden a confirmar sus creencias existentes. Trabajos posteriores reinterpretaron estos resultados como una tendencia a poner a prueba las ideas de manera unilateral, centrándose en una posibilidad e ignorando las alternativas. Las explicaciones de los sesgos observados incluyen la ilusión y la capacidad humana limitada para procesar la información. Otra propuesta es que las personas muestran un sesgo de confirmación porque evalúan pragmáticamente los costos de estar equivocados, en lugar de investigar de manera neutral y científica.

Se han encontrado decisiones erróneas debido al sesgo de confirmación en una amplia gama de contextos políticos, organizacionales, financieros y científicos. Estos sesgos contribuyen al exceso de confianza en las creencias personales y pueden mantener o fortalecer las creencias frente a evidencia contraria. Por ejemplo, el sesgo de confirmación produce errores sistemáticos en la investigación científica basada en el razonamiento inductivo (la acumulación gradual de evidencia de apoyo). De manera similar, un detective de policía puede identificar a un sospechoso al principio de una investigación, pero luego puede buscar solo evidencia confirmatoria en lugar de evidencia desmentida. Un médico puede centrarse prematuramente en un trastorno particular al principio de una sesión de diagnóstico y luego buscar solo evidencia confirmatoria. En las redes sociales , el sesgo de confirmación se amplifica mediante el uso de burbujas de filtro o "edición algorítmica", que muestran a las personas solo información con la que es probable que estén de acuerdo, mientras que excluyen puntos de vista opuestos.

Definición y contexto

El sesgo de confirmación, frase acuñada por el psicólogo inglés Peter Wason , es la tendencia de las personas a favorecer la información que confirma o fortalece sus creencias o valores y es difícil de desechar una vez afirmada. [4]

Los sesgos de confirmación son efectos en el procesamiento de la información . Se diferencian de lo que a veces se denomina efecto de confirmación conductual , comúnmente conocido como profecía autocumplida , en el que las expectativas de una persona influyen en su propio comportamiento, dando lugar al resultado esperado. [5]

Algunos psicólogos limitan el término "sesgo de confirmación" a la recolección selectiva de evidencia que respalda lo que uno ya cree, mientras que ignora o rechaza la evidencia que respalda una conclusión diferente. Otros aplican el término de manera más amplia a la tendencia a preservar las creencias existentes cuando se buscan evidencias, se las interpreta o se las recuerda de memoria. [6] [b] El sesgo de confirmación es el resultado de estrategias automáticas e involuntarias, más que de un engaño deliberado. [8] [9]

Tipos

Búsqueda sesgada de información

Los experimentos han demostrado repetidamente que las personas tienden a probar hipótesis de una manera unilateral, buscando evidencia consistente con su hipótesis actual . [3] : 177–178 [11] En lugar de buscar entre todas las evidencias relevantes, formulan preguntas para recibir una respuesta afirmativa que respalde su teoría. [12] Buscan las consecuencias que esperarían si su hipótesis fuera verdadera, en lugar de lo que sucedería si fuera falsa. [12] Por ejemplo, alguien que usa preguntas de sí/no para encontrar un número que sospecha que es el número 3 podría preguntar: "¿Es un número impar ?". Las personas prefieren este tipo de pregunta, llamada "prueba positiva", incluso cuando una prueba negativa como "¿Es un número par?" arrojaría exactamente la misma información. [13] Sin embargo, esto no significa que las personas busquen pruebas que garanticen una respuesta positiva. En los estudios en los que los sujetos podían seleccionar tales pseudopruebas o las genuinamente diagnósticas, favorecieron las genuinamente diagnósticas. [14] [15]

La preferencia por pruebas positivas no es en sí misma un sesgo, ya que las pruebas positivas pueden ser muy informativas. [16] Sin embargo, en combinación con otros efectos, esta estrategia puede confirmar creencias o suposiciones existentes, independientemente de si son verdaderas. [8] En situaciones del mundo real, la evidencia suele ser compleja y mixta. Por ejemplo, varias ideas contradictorias sobre alguien podrían ser apoyadas cada una si se concentraran en un aspecto de su comportamiento. [11] Por lo tanto, es probable que cualquier búsqueda de evidencia a favor de una hipótesis tenga éxito. [8] Un ejemplo de esto es la forma en que la formulación de una pregunta puede cambiar significativamente la respuesta. [11] Por ejemplo, las personas a las que se les pregunta "¿Está contento con su vida social?" manifiestan una mayor satisfacción que aquellas a las que se les pregunta "¿Está descontento con su vida social?" . [17]

Incluso un pequeño cambio en la redacción de una pregunta puede afectar la forma en que las personas buscan la información disponible y, por lo tanto, las conclusiones a las que llegan. Esto se demostró utilizando un caso ficticio de custodia de un niño. [18] Los participantes leyeron que el padre A era moderadamente adecuado para ser el tutor en múltiples aspectos. El padre B tenía una mezcla de cualidades positivas y negativas destacadas: una relación cercana con el niño pero un trabajo que lo alejaría por largos períodos de tiempo. Cuando se preguntó "¿Qué padre debería tener la custodia del niño?", la mayoría de los participantes eligió al padre B, buscando principalmente atributos positivos. Sin embargo, cuando se preguntó "¿A qué padre se le debería negar la custodia del niño?", buscaron atributos negativos y la mayoría respondió que se le debería negar la custodia al padre B, lo que implica que el padre A debería tener la custodia. [18]

Estudios similares han demostrado que las personas realizan una búsqueda sesgada de información, pero también que este fenómeno puede verse limitado por una preferencia por pruebas diagnósticas genuinas. En un experimento inicial, los participantes calificaron a otra persona en la dimensión de personalidad introversión-extroversión sobre la base de una entrevista. Eligieron las preguntas de la entrevista de una lista dada. Cuando se presentó al entrevistado como introvertido, los participantes eligieron preguntas que presumían introversión, como "¿Qué encuentra desagradable en las fiestas ruidosas?". Cuando se describió al entrevistado como extrovertido, casi todas las preguntas presumían extroversión, como "¿Qué haría para animar una fiesta aburrida?". Estas preguntas capciosas dieron a los entrevistados poca o ninguna oportunidad de falsificar la hipótesis sobre ellos. [19] Una versión posterior del experimento dio a los participantes preguntas menos presuntuosas para elegir, como "¿Evita las interacciones sociales?" . [20] Los participantes prefirieron hacer estas preguntas más diagnósticas, mostrando solo un sesgo débil hacia las pruebas positivas. Este patrón, de una preferencia principal por las pruebas diagnósticas y una preferencia más débil por las pruebas positivas, se ha replicado en otros estudios. [20]

Los rasgos de personalidad influyen e interactúan con los procesos de búsqueda sesgados. [21] Los individuos varían en sus habilidades para defender sus actitudes de ataques externos en relación con la exposición selectiva . La exposición selectiva ocurre cuando los individuos buscan información que sea consistente, en lugar de inconsistente, con sus creencias personales. [22] Un experimento examinó hasta qué punto los individuos podían refutar argumentos que contradecían sus creencias personales. [21] Las personas con altos niveles de confianza buscan más fácilmente información contradictoria con su posición personal para formar un argumento. Esto puede tomar la forma de un consumo de noticias opositor , donde los individuos buscan noticias partidistas opuestas para contraargumentar. [23] Los individuos con bajos niveles de confianza no buscan información contradictoria y prefieren información que respalde su posición personal. Las personas generan y evalúan evidencia en argumentos que están sesgados hacia sus propias creencias y opiniones. [24] Los niveles de confianza elevados disminuyen la preferencia por la información que respalda las creencias personales de los individuos.

En otro experimento, los participantes debían realizar una compleja tarea de descubrimiento de reglas que implicaba mover objetos simulados por un ordenador. [25] Los objetos que aparecían en la pantalla del ordenador seguían leyes específicas que los participantes debían descifrar. Por lo tanto, los participantes podían "lanzar" objetos a través de la pantalla para probar sus hipótesis. A pesar de realizar muchos intentos durante una sesión de diez horas, ninguno de los participantes logró descifrar las reglas del sistema. Por lo general, intentaban confirmar sus hipótesis en lugar de refutarlas y se mostraban reacios a considerar alternativas. Incluso después de ver pruebas objetivas que refutaban sus hipótesis de trabajo, con frecuencia continuaban haciendo las mismas pruebas. A algunos de los participantes se les enseñó a realizar pruebas de hipótesis adecuadas, pero estas instrucciones casi no tuvieron ningún efecto. [25]

Interpretación sesgada de la información

Las personas inteligentes creen cosas raras porque son hábiles para defender creencias a las que llegaron por razones no inteligentes.

—Michael Shermer [26]

Los sesgos de confirmación no se limitan a la recopilación de pruebas. Incluso si dos personas tienen la misma información, la forma en que la interpretan puede estar sesgada.

Un equipo de la Universidad de Stanford llevó a cabo un experimento en el que participaron personas que tenían opiniones muy claras sobre la pena de muerte, la mitad a favor y la otra mitad en contra. [27] [28] Cada participante leyó descripciones de dos estudios: una comparación de estados de EE. UU. con y sin pena de muerte, y una comparación de las tasas de homicidios en un estado antes y después de la introducción de la pena de muerte. Después de leer una breve descripción de cada estudio, se preguntó a los participantes si habían cambiado sus opiniones. Luego leyeron una descripción más detallada del procedimiento de cada estudio y tuvieron que evaluar si la investigación estaba bien realizada y era convincente. [27] De hecho, los estudios eran ficticios. A la mitad de los participantes se les dijo que un tipo de estudio apoyaba el efecto disuasorio y el otro lo socavaba, mientras que para otros participantes las conclusiones se intercambiaron. [27] [28]

Los participantes, tanto partidarios como detractores, informaron de un ligero cambio de actitud en la dirección del primer estudio que leyeron. Una vez que leyeron las descripciones más detalladas de los dos estudios, casi todos volvieron a su creencia original independientemente de la evidencia proporcionada, señalando los detalles que apoyaban su punto de vista y descartando cualquier cosa contraria. Los participantes describieron los estudios que apoyaban su punto de vista preexistente como superiores a los que lo contradecían, de forma detallada y específica. [27] [29] Al escribir sobre un estudio que parecía socavar el efecto disuasorio, un defensor de la pena de muerte escribió: "La investigación no cubrió un período de tiempo lo suficientemente largo", mientras que el comentario de un oponente sobre el mismo estudio decía: "No se ha presentado ninguna evidencia sólida que contradiga a los investigadores". [27] Los resultados ilustraron que las personas establecen estándares de evidencia más altos para las hipótesis que van en contra de sus expectativas actuales. Este efecto, conocido como "sesgo de desconfirmación", ha sido respaldado por otros experimentos. [30]

Otro estudio de interpretación sesgada se llevó a cabo durante las elecciones presidenciales de Estados Unidos de 2004 y contó con la participación de participantes que informaron tener fuertes sentimientos sobre los candidatos. Se les mostraron pares de declaraciones aparentemente contradictorias, ya sea del candidato republicano George W. Bush , el candidato demócrata John Kerry o una figura pública políticamente neutral. También se les dieron otras declaraciones que hacían que la aparente contradicción pareciera razonable. A partir de estas tres piezas de información, tuvieron que decidir si las declaraciones de cada individuo eran inconsistentes. [31] : 1948 Hubo fuertes diferencias en estas evaluaciones, y los participantes eran mucho más propensos a interpretar las declaraciones del candidato al que se oponían como contradictorias. [31] : 1951

En este experimento, los participantes emitieron sus juicios mientras estaban en un escáner de resonancia magnética que monitoreaba su actividad cerebral. A medida que los participantes evaluaban las declaraciones contradictorias de su candidato favorito, se activaban los centros emocionales de sus cerebros. Esto no sucedió con las declaraciones de las otras figuras. Los experimentadores dedujeron que las diferentes respuestas a las declaraciones no se debían a errores de razonamiento pasivo. En cambio, los participantes estaban reduciendo activamente la disonancia cognitiva inducida al leer sobre el comportamiento irracional o hipócrita de su candidato favorito . [31] : 1956

Los sesgos en la interpretación de creencias son persistentes, independientemente del nivel de inteligencia. Los participantes en un experimento tomaron el examen SAT (una prueba de admisión a la universidad utilizada en los Estados Unidos) para evaluar sus niveles de inteligencia. Luego leyeron información sobre cuestiones de seguridad para los vehículos y los experimentadores manipularon el origen nacional del automóvil. Los participantes estadounidenses dieron su opinión sobre si el automóvil debería prohibirse en una escala de seis puntos, donde uno indicaba "definitivamente sí" y seis indicaba "definitivamente no". Los participantes evaluaron primero si permitirían un automóvil alemán peligroso en las calles estadounidenses y un automóvil estadounidense peligroso en las calles alemanas. Los participantes creían que el automóvil alemán peligroso en las calles estadounidenses debería prohibirse más rápidamente que el automóvil estadounidense peligroso en las calles alemanas. No hubo diferencias entre los niveles de inteligencia en la tasa de prohibición de un automóvil por parte de los participantes. [24]

La interpretación sesgada no se limita a temas emocionalmente significativos. En otro experimento, se contó a los participantes una historia sobre un robo. Tuvieron que evaluar la importancia probatoria de las afirmaciones que defendían o desfavorecían la responsabilidad de un personaje en particular. Cuando plantearon la hipótesis de la culpabilidad de ese personaje, calificaron las afirmaciones que apoyaban esa hipótesis como más importantes que las afirmaciones contradictorias. [32]

Recuerdo sesgado de la información

Las personas pueden recordar evidencias de manera selectiva para reforzar sus expectativas, incluso si recopilan e interpretan evidencias de manera neutral. Este efecto se denomina "recuerdo selectivo", "memoria confirmatoria" o "memoria con sesgo de acceso". [33] Las teorías psicológicas difieren en sus predicciones sobre el recuerdo selectivo. La teoría de esquemas predice que la información que coincide con las expectativas previas se almacenará y recordará más fácilmente que la información que no coincide. [34] Algunos enfoques alternativos dicen que la información sorprendente se destaca y, por lo tanto, es memorable. [34] Las predicciones de ambas teorías se han confirmado en diferentes contextos experimentales, sin que ninguna teoría gane por completo. [35]

En un estudio, los participantes leyeron el perfil de una mujer que describía una mezcla de comportamientos introvertidos y extrovertidos. [36] Más tarde tuvieron que recordar ejemplos de su introversión y extroversión. A un grupo se le dijo que esto era para evaluar a la mujer para un trabajo como bibliotecaria, mientras que a un segundo grupo se le dijo que era para un trabajo en ventas de bienes raíces. Hubo una diferencia significativa entre lo que recordaron estos dos grupos, ya que el grupo "bibliotecario" recordó más ejemplos de introversión y los grupos "ventas" recordaron un comportamiento más extrovertido. [36] También se ha demostrado un efecto de memoria selectiva en experimentos que manipulan la deseabilidad de los tipos de personalidad. [34] [37] En uno de estos, a un grupo de participantes se le mostró evidencia de que las personas extrovertidas tienen más éxito que los introvertidos. A otro grupo se le dijo lo contrario. En un estudio posterior, aparentemente no relacionado, se pidió a los participantes que recordaran eventos de sus vidas en los que habían sido introvertidos o extrovertidos. Cada grupo de participantes proporcionó más recuerdos que los conectaban con el tipo de personalidad más deseable y recordaron esos recuerdos más rápidamente. [38]

Los cambios en los estados emocionales también pueden influir en la evocación de la memoria. [39] [40] Los participantes calificaron cómo se sintieron cuando se enteraron por primera vez de que OJ Simpson había sido absuelto de los cargos de asesinato. [39] Describieron sus reacciones emocionales y su confianza con respecto al veredicto una semana, dos meses y un año después del juicio. Los resultados indicaron que las evaluaciones de los participantes sobre la culpabilidad de Simpson cambiaron con el tiempo. Cuanto más había cambiado la opinión de los participantes sobre el veredicto, menos estables eran los recuerdos de los participantes con respecto a sus reacciones emocionales iniciales. Cuando los participantes recordaron sus reacciones emocionales iniciales dos meses y un año después, las evaluaciones pasadas se parecían mucho a las evaluaciones actuales de la emoción. Las personas demuestran un sesgo considerable de mi lado cuando discuten sus opiniones sobre temas controvertidos. [24] El recuerdo de la memoria y la construcción de experiencias sufren una revisión en relación con los estados emocionales correspondientes.

Se ha demostrado que el sesgo de mi lado influye en la precisión de la evocación de recuerdos. [40] En un experimento, viudos y viudas calificaron la intensidad del dolor que experimentaron seis meses y cinco años después de la muerte de sus cónyuges. Los participantes notaron una mayor experiencia de dolor a los seis meses que a los cinco años. Sin embargo, cuando se les preguntó a los participantes después de cinco años cómo se habían sentido seis meses después de la muerte de su pareja, la intensidad del dolor que recordaban los participantes estaba altamente correlacionada con su nivel actual de dolor. Las personas parecen utilizar sus estados emocionales actuales para analizar cómo se deben haber sentido al experimentar eventos pasados. [39] Los recuerdos emocionales se reconstruyen a partir de los estados emocionales actuales.

Un estudio demostró cómo la memoria selectiva puede mantener la creencia en la percepción extrasensorial (PES). [41] A los creyentes y a los no creyentes se les mostraron descripciones de experimentos de PES. A la mitad de cada grupo se les dijo que los resultados experimentales apoyaban la existencia de la PES, mientras que a los demás se les dijo que no. En una prueba posterior, los participantes recordaron el material con precisión, excepto los creyentes que habían leído la evidencia que no apoyaba la PES. Este grupo recordó significativamente menos información y algunos de ellos recordaron incorrectamente los resultados como si apoyaran la PES. [41]

Diferencias individuales

En el pasado se creía que el sesgo de mi lado estaba relacionado con la inteligencia; sin embargo, los estudios han demostrado que el sesgo de mi lado puede estar más influenciado por la capacidad de pensar racionalmente que por el nivel de inteligencia. [24] El sesgo de mi lado puede causar una incapacidad para evaluar de manera efectiva y lógica el lado opuesto de un argumento. Los estudios han afirmado que el sesgo de mi lado es una ausencia de "mentalidad abierta activa", es decir, la búsqueda activa de por qué una idea inicial puede ser errónea. [42] Por lo general, el sesgo de mi lado se operacionaliza en estudios empíricos como la cantidad de evidencia utilizada en apoyo de su lado en comparación con el lado opuesto. [43]

Un estudio ha encontrado diferencias individuales en el sesgo de mi lado. Este estudio investiga las diferencias individuales que se adquieren a través del aprendizaje en un contexto cultural y que son mutables. El investigador encontró diferencias individuales importantes en la argumentación. Los estudios han sugerido que las diferencias individuales, como la capacidad de razonamiento deductivo, la capacidad de superar el sesgo de creencia, la comprensión epistemológica y la disposición de pensamiento son predictores significativos del razonamiento y la generación de argumentos, contraargumentos y refutaciones. [44] [45] [46]

Un estudio de Christopher Wolfe y Anne Britt también investigó cómo las opiniones de los participantes sobre "¿qué hace que un argumento sea bueno?" pueden ser una fuente de sesgo de "mi lado" que influye en la forma en que una persona formula sus propios argumentos. [43] El estudio investigó las diferencias individuales del esquema de argumentación y pidió a los participantes que escribieran ensayos. Los participantes fueron asignados aleatoriamente para escribir ensayos a favor o en contra de su lado preferido de un argumento y recibieron instrucciones de investigación que adoptaron un enfoque equilibrado o sin restricciones. Las instrucciones de investigación equilibrada dirigían a los participantes a crear un argumento "equilibrado", es decir, que incluyera tanto pros como contras; las instrucciones de investigación sin restricciones no incluían nada sobre cómo crear el argumento. [43]

En general, los resultados revelaron que las instrucciones de investigación equilibrada aumentaron significativamente la incidencia de información contraria en los argumentos. Estos datos también revelan que la creencia personal no es una fuente de sesgo de opinión; sin embargo, aquellos participantes que creen que un buen argumento es aquel que se basa en hechos tienen más probabilidades de exhibir sesgo de opinión que otros participantes. Esta evidencia es consistente con las afirmaciones propuestas en el artículo de Baron: que las opiniones de las personas sobre lo que constituye un buen pensamiento pueden influir en la forma en que se generan los argumentos. [43]

Descubrimiento

Observaciones informales

Antes de la investigación psicológica sobre el sesgo de confirmación, el fenómeno se había observado a lo largo de la historia. Empezando por el historiador griego Tucídides ( c. 460 a. C. - c. 395 a. C. ), que escribió sobre la razón equivocada en La guerra del Peloponeso : "... porque es un hábito de la humanidad confiar a la esperanza descuidada lo que anhela, y usar la razón soberana para dejar de lado lo que no le gusta". [47] El poeta italiano Dante Alighieri (1265-1321) lo señaló en la Divina Comedia , en la que Santo Tomás de Aquino le advierte a Dante al encontrarse en el Paraíso: "la opinión -apresurada- a menudo puede inclinarse hacia el lado equivocado, y entonces el afecto por la propia opinión ata, confina la mente". [48] Ibn Jaldún notó el mismo efecto en su Muqaddimah : [49]

La falsedad afecta naturalmente a la información histórica. Hay varias razones que la hacen inevitable. Una de ellas es la inclinación por opiniones y escuelas. ... si el alma está infectada de inclinación por una opinión o secta particular, acepta sin vacilar un momento la información que le agrada. El prejuicio y la inclinación por el partidismo oscurecen la facultad crítica e impiden la investigación crítica. El resultado es que se aceptan y transmiten falsedades.

En el Novum Organum , el filósofo y científico inglés Francis Bacon (1561-1626) [50] señaló que la evaluación sesgada de la evidencia impulsaba "todas las supersticiones, ya sea en astrología, sueños, presagios, juicios divinos o similares". [51] Escribió: [51]

El entendimiento humano, una vez que ha adoptado una opinión... atrae todas las demás cosas para apoyarla y estar de acuerdo con ella. Y aunque se puedan encontrar más ejemplos en contra, los descuida o los desprecia, o bien los descarta o rechaza por alguna distinción.

En el segundo volumen de su obra El mundo como voluntad y representación (1844), el filósofo alemán Arthur Schopenhauer observó que «una hipótesis adoptada nos da ojos de lince para todo lo que la confirma y nos hace ciegos para todo lo que la contradice». [52]

En su ensayo (1897) ¿Qué es el arte?, el novelista ruso León Tolstoi escribió: [53]

Sé que la mayoría de los hombres —no sólo aquellos considerados inteligentes, sino incluso aquellos que son muy inteligentes y capaces de comprender los problemas científicos, matemáticos o filosóficos más difíciles— rara vez pueden discernir incluso la verdad más simple y obvia si es tal que los obliga a admitir la falsedad de las conclusiones que han formado, tal vez con mucha dificultad, conclusiones de las que están orgullosos, que han enseñado a otros y sobre las que han construido sus vidas.

En su ensayo (1894) El reino de Dios está dentro de vosotros , Tolstoi había escrito anteriormente: [54]

Los temas más difíciles pueden ser explicados al hombre más torpe si aún no se ha formado ninguna idea sobre ellos; pero la cosa más sencilla no puede ser aclarada al hombre más inteligente si está firmemente convencido de que ya sabe, sin sombra de duda, lo que se le presenta.

Explicación de la prueba de hipótesis (falsificación) (Wason)

En el experimento inicial de Peter Wason publicado en 1960 (que no menciona el término "sesgo de confirmación"), desafió repetidamente a los participantes a identificar una regla que se aplicara a los triples de números. Se les dijo que (2,4,6) se ajustaba a la regla. Generaron triples y el experimentador les dijo si cada triple se ajustaba a la regla. [3] : 179

La regla real era simplemente "cualquier secuencia ascendente", pero los participantes tuvieron grandes dificultades para encontrarla, y a menudo anunciaban reglas que eran mucho más específicas, como "el número del medio es el promedio del primero y el último". [55] Los participantes parecían probar solo ejemplos positivos: triples que obedecían la regla que habían hipotetizado. Por ejemplo, si pensaban que la regla era "Cada número es dos veces mayor que su predecesor", ofrecerían un triple que se ajustara a (confirmara) esta regla, como (11,13,15) en lugar de un triple que la violara (falsificara), como (11,12,19). [56]

Wason interpretó sus resultados como una muestra de una preferencia por la confirmación sobre la falsificación, por lo que acuñó el término "sesgo de confirmación". [c] [58] Wason también utilizó el sesgo de confirmación para explicar los resultados de su experimento de tarea de selección . [59] Los participantes obtuvieron malos resultados repetidamente en varias formas de esta prueba, en la mayoría de los casos ignorando información que potencialmente podría refutar (falsificar) la regla especificada. [60] [61]

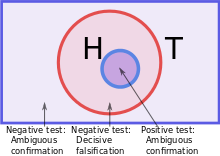

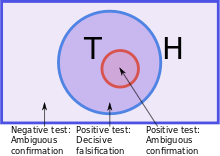

Explicación de la prueba de hipótesis (estrategia de prueba positiva) (Klayman y Ha)

El artículo de Klayman y Ha de 1987 sostiene que los experimentos de Wason no demuestran en realidad un sesgo hacia la confirmación, sino más bien una tendencia a hacer que las pruebas sean consistentes con la hipótesis de trabajo. [16] [62] Llamaron a esto la "estrategia de prueba positiva". [11] Esta estrategia es un ejemplo de una heurística : un atajo de razonamiento que es imperfecto pero fácil de calcular. [63] Klayman y Ha utilizaron la teoría de la probabilidad y la información bayesiana como su estándar de prueba de hipótesis, en lugar del falsacionismo utilizado por Wason. Según estas ideas, cada respuesta a una pregunta produce una cantidad diferente de información, que depende de las creencias previas de la persona. Por lo tanto, una prueba científica de una hipótesis es aquella que se espera que produzca la mayor cantidad de información. Dado que el contenido de información depende de las probabilidades iniciales, una prueba positiva puede ser altamente informativa o poco informativa. Klayman y Ha argumentaron que cuando las personas piensan en problemas realistas, buscan una respuesta específica con una pequeña probabilidad inicial. En este caso, las pruebas positivas suelen ser más informativas que las pruebas negativas. [16] Sin embargo, en la tarea de descubrimiento de la regla de Wason, la respuesta (tres números en orden ascendente) es muy amplia, por lo que es poco probable que las pruebas positivas produzcan respuestas informativas. Klayman y Ha respaldaron su análisis citando un experimento que utilizó las etiquetas "DAX" y "MED" en lugar de "se ajusta a la regla" y "no se ajusta a la regla". Esto evitó dar a entender que el objetivo era encontrar una regla de baja probabilidad. Los participantes tuvieron mucho más éxito con esta versión del experimento. [64] [65]

A la luz de esta y otras críticas, el foco de la investigación se alejó de la confirmación versus la refutación de una hipótesis, para examinar si las personas ponen a prueba hipótesis de una manera informativa o de una manera no informativa pero positiva. La búsqueda del sesgo de confirmación "verdadero" llevó a los psicólogos a observar una gama más amplia de efectos en cómo las personas procesan la información. [66]

Explicaciones sobre el procesamiento de la información

Actualmente existen tres explicaciones principales sobre el sesgo de confirmación desde el punto de vista del procesamiento de la información , además de una incorporación reciente.

Cognitivo versus motivacional

Según Robert MacCoun , la mayor parte del procesamiento de evidencia sesgada ocurre a través de una combinación de mecanismos "fríos" (cognitivos) y "calientes" (motivados). [67]

Las explicaciones cognitivas del sesgo de confirmación se basan en las limitaciones de la capacidad de las personas para manejar tareas complejas y en los atajos, llamados heurísticas , que utilizan. [68] Por ejemplo, las personas pueden juzgar la fiabilidad de la evidencia utilizando la heurística de disponibilidad , es decir, la facilidad con la que una idea particular viene a la mente. [69] También es posible que las personas solo puedan centrarse en un pensamiento a la vez, por lo que les resulta difícil probar hipótesis alternativas en paralelo. [3] : 198–199 Otra heurística es la estrategia de prueba positiva identificada por Klayman y Ha, en la que las personas prueban una hipótesis examinando casos en los que esperan que ocurra una propiedad o un evento. Esta heurística evita la difícil o imposible tarea de determinar qué tan diagnóstica será cada posible pregunta. Sin embargo, no es universalmente confiable, por lo que las personas pueden pasar por alto los desafíos a sus creencias existentes. [16] [3] : 200

Las explicaciones motivacionales implican un efecto del deseo sobre la creencia . [3] : 197 [70] Se sabe que las personas prefieren los pensamientos positivos a los negativos de varias maneras: esto se llama el " principio de Pollyanna ". [71] Aplicado a argumentos o fuentes de evidencia , esto podría explicar por qué es más probable que las conclusiones deseadas se crean verdaderas. Según los experimentos que manipulan la deseabilidad de la conclusión, las personas exigen un alto estándar de evidencia para las ideas desagradables y un bajo estándar para las ideas preferidas. En otras palabras, preguntan: "¿Puedo creer esto?" para algunas sugerencias y "¿Debo creer esto?" para otras. [72] [73] Aunque la consistencia es una característica deseable de las actitudes, un impulso excesivo por la consistencia es otra fuente potencial de sesgo porque puede evitar que las personas evalúen de manera neutral la información nueva y sorprendente. El psicólogo social Ziva Kunda combina las teorías cognitivas y motivacionales, argumentando que la motivación crea el sesgo, pero los factores cognitivos determinan el tamaño del efecto. [3] : 198

Costo-beneficio

Las explicaciones en términos de análisis de costo-beneficio suponen que las personas no solo prueban hipótesis de manera desinteresada, sino que evalúan los costos de diferentes errores. [74] Usando ideas de la psicología evolutiva , James Friedrich sugiere que las personas no apuntan principalmente a la verdad al probar hipótesis, sino que intentan evitar los errores más costosos. Por ejemplo, los empleadores pueden hacer preguntas unilaterales en las entrevistas de trabajo porque están enfocados en eliminar a los candidatos no adecuados. [75] El refinamiento de esta teoría de Yaacov Trope y Akiva Liberman supone que las personas comparan los dos tipos diferentes de error: aceptar una hipótesis falsa o rechazar una hipótesis verdadera. Por ejemplo, alguien que subestima la honestidad de un amigo puede tratarlo con sospecha y socavar así la amistad. Sobreestimar la honestidad del amigo también puede ser costoso, pero menos. En este caso, sería racional buscar, evaluar o recordar evidencia de su honestidad de manera sesgada. [76] Cuando alguien da una impresión inicial de ser introvertido o extrovertido, las preguntas que coinciden con esa impresión resultan más empáticas . [77] Esto sugiere que cuando se habla con alguien que parece ser introvertido, es un signo de mejores habilidades sociales preguntar: "¿Te sientes incómodo en situaciones sociales?" en lugar de "¿Te gustan las fiestas ruidosas?". La conexión entre el sesgo de confirmación y las habilidades sociales fue corroborada por un estudio sobre cómo los estudiantes universitarios conocen a otras personas. Los estudiantes con un alto nivel de autocontrol , que son más sensibles a su entorno y a las normas sociales , hicieron más preguntas de coincidencia cuando entrevistaron a un miembro del personal de alto estatus que cuando conocieron a sus compañeros. [77]

Exploratorio versus confirmatorio

Los psicólogos Jennifer Lerner y Philip Tetlock distinguen dos tipos diferentes de proceso de pensamiento. El pensamiento exploratorio considera de manera neutral múltiples puntos de vista e intenta anticipar todas las objeciones posibles a una posición particular, mientras que el pensamiento confirmatorio busca justificar un punto de vista específico. Lerner y Tetlock dicen que cuando las personas esperan justificar su posición ante otras personas cuyas opiniones ya conocen, tenderán a adoptar una posición similar a la de esas personas y luego usarán el pensamiento confirmatorio para reforzar su propia credibilidad. Sin embargo, si las partes externas son demasiado agresivas o críticas, las personas se desvincularán del pensamiento por completo y simplemente afirmarán sus opiniones personales sin justificación. Lerner y Tetlock dicen que las personas solo se esfuerzan por pensar de manera crítica y lógica cuando saben de antemano que necesitarán explicarse ante otras personas que están bien informadas, genuinamente interesadas en la verdad y cuyas opiniones aún no conocen. Como esas condiciones rara vez se dan, argumentan, la mayoría de las personas usan el pensamiento confirmatorio la mayor parte del tiempo. [78] [79] [80]

Hacer creer

La psicóloga del desarrollo Eve Whitmore ha sostenido que las creencias y los sesgos implicados en el sesgo de confirmación tienen sus raíces en la manera en que los niños afrontan las cosas a través de la simulación, que se convierte en "la base de formas más complejas de autoengaño e ilusión en la edad adulta". La fricción que genera el cuestionamiento en la adolescencia con el desarrollo del pensamiento crítico puede llevar a la racionalización de creencias falsas, y el hábito de tal racionalización puede volverse inconsciente con el paso de los años. [81]

Adquisición óptima de información

Las investigaciones económicas recientes han puesto en tela de juicio la visión tradicional del sesgo de confirmación como un defecto puramente cognitivo. [82] En condiciones en las que la adquisición y el procesamiento de información son costosos, buscar evidencia confirmatoria puede ser en realidad una estrategia óptima. En lugar de buscar evidencia contraria o que refute la información, puede ser más eficiente centrarse en fuentes que probablemente coincidan con las creencias existentes, dadas las limitaciones de tiempo y recursos.

El economista Weijie Zhong ha desarrollado un modelo que demuestra que las personas que deben tomar decisiones bajo presión del tiempo y que enfrentan costos para obtener más información, a menudo preferirán señales confirmatorias. Según este modelo, cuando las personas creen firmemente en una determinada hipótesis, buscan de manera óptima información que la confirme, lo que les permite generar confianza de manera más eficiente. Si no reciben las señales confirmatorias esperadas, su confianza en la hipótesis inicial disminuirá gradualmente, lo que llevará a una actualización de las creencias. Este enfoque muestra que la búsqueda de confirmación no es necesariamente sesgada, sino que puede ser una asignación racional de atención y recursos limitados. [83]

Efectos en el mundo real

Redes sociales

En las redes sociales , el sesgo de confirmación se amplifica mediante el uso de burbujas de filtro o "edición algorítmica", que muestra a los individuos solo información con la que es probable que estén de acuerdo, mientras que excluye las opiniones opuestas. [84] Algunos han argumentado que el sesgo de confirmación es la razón por la que la sociedad nunca puede escapar de las burbujas de filtro, porque los individuos están psicológicamente programados para buscar información que concuerde con sus valores y creencias preexistentes. [85] Otros han argumentado además que la mezcla de los dos está degradando la democracia , afirmando que esta "edición algorítmica" elimina diversos puntos de vista e información, y que a menos que se eliminen los algoritmos de burbujas de filtro, los votantes no podrán tomar decisiones políticas completamente informadas. [86] [84]

El auge de las redes sociales ha contribuido en gran medida a la rápida difusión de noticias falsas , es decir, información falsa y engañosa que se presenta como noticias creíbles de una fuente aparentemente fiable. El sesgo de confirmación (selección o reinterpretación de pruebas para apoyar las propias creencias) es uno de los tres principales obstáculos citados como motivo de por qué el pensamiento crítico se extravía en estas circunstancias. Los otros dos son las heurísticas de atajo (cuando se está abrumado o corto de tiempo, las personas confían en reglas simples como el consenso grupal o la confianza en un experto o modelo a seguir) y los objetivos sociales (la motivación social o la presión de los pares pueden interferir con el análisis objetivo de los hechos en cuestión). [87]

Para combatir la difusión de noticias falsas, los sitios de redes sociales han considerado recurrir a la "incitación digital" [88] . Actualmente, esto se puede hacer de dos formas diferentes: la incitación a la información y la incitación a la presentación. La incitación a la información implica que los sitios de redes sociales proporcionen una exención de responsabilidad o una etiqueta que cuestione o advierta a los usuarios sobre la validez de la fuente, mientras que la incitación a la presentación incluye exponer a los usuarios a información nueva que tal vez no hayan buscado, pero que podría presentarles puntos de vista que pueden combatir sus propios sesgos de confirmación [89] .

Ciencia e investigación científica

Una característica distintiva del pensamiento científico es la búsqueda de evidencia confirmatoria o de apoyo ( razonamiento inductivo ), así como de evidencia falsificadora ( razonamiento deductivo ). [90] [91]

Muchas veces en la historia de la ciencia , los científicos se han resistido a nuevos descubrimientos interpretando selectivamente o ignorando datos desfavorables. [3] : 192–194 Varios estudios han demostrado que los científicos califican los estudios que informan hallazgos consistentes con sus creencias previas de manera más favorable que los estudios que informan hallazgos inconsistentes con sus creencias previas. [9] [92] [93]

Sin embargo, suponiendo que la pregunta de investigación sea relevante, el diseño experimental adecuado y los datos estén descritos de forma clara y completa, los datos empíricos obtenidos deberían ser importantes para la comunidad científica y no deberían verse de manera prejuiciosa, independientemente de si se ajustan a las predicciones teóricas actuales. [93] En la práctica, los investigadores pueden malinterpretar, malinterpretar o no leer en absoluto los estudios que contradicen sus preconcepciones, o citarlos erróneamente de todos modos como si realmente respaldaran sus afirmaciones. [94]

Además, los sesgos de confirmación pueden sustentar teorías científicas o programas de investigación frente a evidencia inadecuada o incluso contradictoria. [60] [95] La disciplina de la parapsicología se cita a menudo como ejemplo. [96]

El sesgo de confirmación de un experimentador puede afectar potencialmente a los datos que se informan. Los datos que entran en conflicto con las expectativas del experimentador pueden descartarse más fácilmente por no ser confiables, lo que produce el llamado efecto del cajón de archivos . Para combatir esta tendencia, la formación científica enseña formas de prevenir el sesgo. [97] Por ejemplo, el diseño experimental de ensayos controlados aleatorios (junto con su revisión sistemática ) tiene como objetivo minimizar las fuentes de sesgo. [97] [98]

El proceso social de revisión por pares tiene como objetivo mitigar el efecto de los sesgos de los científicos individuales, aunque el proceso de revisión por pares en sí mismo puede ser susceptible a tales sesgos [99] [100] [93] [101] [102] El sesgo de confirmación puede, por lo tanto, ser especialmente perjudicial para las evaluaciones objetivas sobre resultados no conformes, ya que los individuos sesgados pueden considerar que la evidencia opuesta es débil en principio y dar poca importancia a la revisión de sus creencias. [92] Los innovadores científicos a menudo se encuentran con la resistencia de la comunidad científica, y la investigación que presenta resultados controvertidos con frecuencia recibe una dura revisión por pares. [103]

Finanzas

El sesgo de confirmación puede llevar a los inversores a confiar demasiado, ignorando la evidencia de que sus estrategias les harán perder dinero. [10] [104] En estudios sobre mercados bursátiles políticos , los inversores obtuvieron más beneficios cuando resistieron el sesgo. Por ejemplo, los participantes que interpretaron el desempeño de un candidato en un debate de una manera neutral en lugar de partidista tenían más probabilidades de obtener beneficios. [105] Para combatir el efecto del sesgo de confirmación, los inversores pueden tratar de adoptar un punto de vista contrario "por el bien del argumento". [106] En una técnica, imaginan que sus inversiones se han derrumbado y se preguntan por qué podría suceder esto. [10]

Medicina y salud

Los sesgos cognitivos son variables importantes en la toma de decisiones clínicas por parte de los médicos generales y los especialistas médicos. Dos de ellos son el sesgo de confirmación y el sesgo de disponibilidad superpuesta. Un médico general puede hacer un diagnóstico al principio de un examen y luego buscar evidencia que lo confirme en lugar de falsificarlo. Este error cognitivo se debe en parte a la disponibilidad de evidencia sobre el supuesto trastorno que se está diagnosticando. Por ejemplo, el paciente puede haber mencionado el trastorno o el médico general puede haber leído recientemente un artículo muy debatido sobre el trastorno. La base de este atajo o heurística cognitiva (denominada anclaje) es que el médico no considera múltiples posibilidades basadas en la evidencia, sino que se aferra prematuramente a una sola causa. [107] En la medicina de urgencias, debido a la presión del tiempo, hay una alta densidad de toma de decisiones y con frecuencia se aplican atajos. La tasa potencial de fracaso de estas decisiones cognitivas debe gestionarse mediante la educación sobre los 30 o más sesgos cognitivos que pueden ocurrir, a fin de establecer estrategias adecuadas para eliminar los sesgos. [108] El sesgo de confirmación también puede provocar que los médicos realicen procedimientos médicos innecesarios debido a la presión de pacientes inflexibles. [109]

El psicólogo Raymond Nickerson atribuye al sesgo de confirmación la ineficacia de los procedimientos médicos que se utilizaban durante siglos antes de la llegada de la medicina científica . [3] : 192 Si un paciente se recuperaba, las autoridades médicas consideraban que el tratamiento había tenido éxito, en lugar de buscar explicaciones alternativas como que la enfermedad había seguido su curso natural. La asimilación sesgada es un factor del atractivo moderno de la medicina alternativa , cuyos defensores se dejan influir por la evidencia anecdótica positiva , pero tratan la evidencia científica de forma hipercrítica. [110] [111] [112]

La terapia cognitiva fue desarrollada por Aaron T. Beck a principios de los años 1960 y se ha convertido en un enfoque popular. [113] Según Beck, el procesamiento sesgado de la información es un factor en la depresión . [114] Su enfoque enseña a las personas a tratar la evidencia de manera imparcial, en lugar de reforzar selectivamente las perspectivas negativas. [50] También se ha demostrado que las fobias y la hipocondría implican un sesgo de confirmación de la información amenazante. [115]

Política, derecho y policía

Nickerson sostiene que el razonamiento en contextos judiciales y políticos a veces está sesgado inconscientemente, favoreciendo conclusiones a las que los jueces, jurados o gobiernos ya se han comprometido. [3] : 191–193 Dado que la evidencia en un juicio con jurado puede ser compleja, y los jurados a menudo llegan a decisiones sobre el veredicto desde el principio, es razonable esperar un efecto de polarización de actitudes. La predicción de que los jurados se volverán más extremos en sus puntos de vista a medida que vean más evidencia se ha confirmado en experimentos con juicios simulados . [116] [117] Tanto los sistemas de justicia penal inquisitivos como adversariales se ven afectados por el sesgo de confirmación. [118]

El sesgo de confirmación puede ser un factor en la creación o extensión de conflictos, desde debates cargados de emociones hasta guerras: al interpretar la evidencia a su favor, cada parte contraria puede llegar a confiarse demasiado en que está en la posición más fuerte. [119] Por otro lado, el sesgo de confirmación puede hacer que las personas ignoren o malinterpreten las señales de un conflicto inminente o incipiente. Por ejemplo, los psicólogos Stuart Sutherland y Thomas Kida han argumentado que el almirante de la Armada de los EE. UU. Husband E. Kimmel mostró sesgo de confirmación al restar importancia a las primeras señales del ataque japonés a Pearl Harbor . [60] [120]

Un estudio de dos décadas sobre analistas políticos realizado por Philip E. Tetlock concluyó que, en general, sus predicciones no eran mucho mejores que las del azar. Tetlock dividió a los expertos en "zorros", que mantenían múltiples hipótesis, y "erizos", que eran más dogmáticos. En general, los erizos eran mucho menos precisos. Tetlock atribuyó su fracaso al sesgo de confirmación y, específicamente, a su incapacidad para hacer uso de nueva información que contradecía sus teorías existentes. [121]

En las investigaciones policiales, un detective puede identificar a un sospechoso al principio de una investigación, pero luego a veces busca principalmente evidencia que apoye o confirme, ignorando o minimizando la evidencia falsificada. [122]

Psicología social

Los psicólogos sociales han identificado dos tendencias en la forma en que las personas buscan o interpretan información sobre sí mismas. La autoverificación es el impulso para reforzar la autoimagen existente y la automejora es el impulso para buscar retroalimentación positiva. Ambas son alimentadas por sesgos de confirmación. [123] En experimentos en los que las personas reciben retroalimentación que entra en conflicto con su autoimagen, es menos probable que presten atención a ella o la recuerden que cuando se les da retroalimentación de autoverificación. [124] [125] [126] Reducen el impacto de dicha información interpretándola como poco confiable. [124] [127] [128] Experimentos similares han encontrado una preferencia por la retroalimentación positiva, y las personas que la dan, sobre la retroalimentación negativa. [123]

Delirios de masas

El sesgo de confirmación puede desempeñar un papel clave en la propagación de delirios masivos . Los juicios por brujería se citan con frecuencia como ejemplo. [129] [130]

Otro ejemplo es la epidemia de picaduras en los parabrisas de Seattle , en la que los parabrisas se dañaban por una causa desconocida. A medida que se difundían las noticias de la aparente ola de daños, cada vez más personas revisaban sus parabrisas y descubrían que también los suyos habían sufrido daños, lo que confirmaba la creencia en la supuesta epidemia. De hecho, los parabrisas ya habían sufrido daños, pero el daño pasó desapercibido hasta que la gente revisó sus parabrisas cuando se extendió la ilusión. [131]

Creencias paranormales

Un factor que hace que las supuestas lecturas psíquicas resulten atractivas es que los oyentes aplican un sesgo de confirmación que ajusta las declaraciones del psíquico a sus propias vidas. [132] Al hacer una gran cantidad de declaraciones ambiguas en cada sesión, el psíquico le da al cliente más oportunidades de encontrar una coincidencia. Esta es una de las técnicas de lectura en frío , con la que un psíquico puede ofrecer una lectura subjetivamente impresionante sin ninguna información previa sobre el cliente. [132] El investigador James Randi comparó la transcripción de una lectura con el informe del cliente sobre lo que el psíquico había dicho, y descubrió que el cliente mostraba un fuerte recuerdo selectivo de los "aciertos". [133]

Como una ilustración llamativa del sesgo de confirmación en el mundo real, Nickerson menciona la piramidología numerológica : la práctica de encontrar significado en las proporciones de las pirámides egipcias. [3] : 190 Hay muchas mediciones de longitud diferentes que se pueden hacer, por ejemplo, de la Gran Pirámide de Giza y muchas formas de combinarlas o manipularlas. Por lo tanto, es casi inevitable que las personas que miran estos números de manera selectiva encuentren correspondencias superficialmente impresionantes, por ejemplo, con las dimensiones de la Tierra. [3] : 190

Reclutamiento y selección

El sesgo cognitivo inconsciente (incluido el sesgo de confirmación) en la contratación laboral afecta las decisiones de contratación y puede impedir un lugar de trabajo diverso e inclusivo. Hay una variedad de sesgos inconscientes que afectan las decisiones de contratación, pero el sesgo de confirmación es uno de los principales, especialmente durante la etapa de la entrevista. [134] El entrevistador a menudo seleccionará a un candidato que confirme sus propias creencias, aunque otros candidatos estén igualmente calificados o mejor.

Efectos y resultados asociados

Polarización de la opinión

Cuando las personas con puntos de vista opuestos interpretan la nueva información de forma sesgada, sus puntos de vista pueden distanciarse aún más. Esto se llama "polarización de actitudes". [135] El efecto se demostró mediante un experimento que consistía en extraer una serie de bolas rojas y negras de una de dos "cestas de bingo" ocultas. Los participantes sabían que una de las cestas contenía un 60 por ciento de bolas negras y un 40 por ciento de bolas rojas; la otra, un 40 por ciento de negras y un 60 por ciento de rojas. Los experimentadores observaron lo que sucedía cuando se extraían bolas de colores alternativos por turno, una secuencia que no favorece a ninguna de las cestas. Después de extraer cada bola, se pidió a los participantes de un grupo que expresaran en voz alta sus juicios sobre la probabilidad de que las bolas se extrajeran de una u otra cesta. Estos participantes tendían a sentirse más seguros con cada extracción sucesiva: tanto si pensaban inicialmente que la cesta con el 60 por ciento de bolas negras como la que tenía el 60 por ciento de bolas rojas era la fuente más probable, su estimación de la probabilidad aumentaba. A otro grupo de participantes se les pidió que expresaran estimaciones de probabilidad solo al final de una secuencia de bolas extraídas, en lugar de después de cada bola. No mostraron el efecto de polarización, sugiriendo que no ocurre necesariamente cuando las personas simplemente mantienen posiciones opuestas, sino más bien cuando se comprometen abiertamente con ellas. [136]

Un estudio menos abstracto fue el experimento de interpretación sesgada de Stanford, en el que los participantes con opiniones firmes sobre la pena de muerte leyeron sobre evidencia experimental mixta. El veintitrés por ciento de los participantes informaron que sus opiniones se habían vuelto más extremas, y este cambio auto-reportado se correlacionó fuertemente con sus actitudes iniciales. [27] En experimentos posteriores, los participantes también informaron que sus opiniones se volvieron más extremas en respuesta a información ambigua. Sin embargo, las comparaciones de sus actitudes antes y después de la nueva evidencia no mostraron cambios significativos, lo que sugiere que los cambios auto-reportados podrían no ser reales. [30] [135] [137] Basándose en estos experimentos, Deanna Kuhn y Joseph Lao concluyeron que la polarización es un fenómeno real pero lejos de ser inevitable, que solo ocurre en una pequeña minoría de casos, y que fue provocada no solo por considerar evidencia mixta, sino simplemente por pensar en el tema. [135]

Charles Taber y Milton Lodge argumentaron que el resultado del equipo de Stanford había sido difícil de replicar porque los argumentos utilizados en experimentos posteriores eran demasiado abstractos o confusos para evocar una respuesta emocional. El estudio de Taber y Lodge utilizó los temas emocionalmente cargados del control de armas y la acción afirmativa . [30] Midieron las actitudes de sus participantes hacia estos temas antes y después de leer los argumentos de cada lado del debate. Dos grupos de participantes mostraron polarización de actitudes: aquellos con fuertes opiniones previas y aquellos que tenían conocimientos políticos. En parte de este estudio, los participantes eligieron qué fuentes de información leer, de una lista preparada por los experimentadores. Por ejemplo, podían leer argumentos sobre el control de armas de la Asociación Nacional del Rifle de Estados Unidos y la Coalición Brady Anti-Handgun . Incluso cuando se les indicó que fueran imparciales, los participantes eran más propensos a leer argumentos que apoyaban sus actitudes existentes que argumentos que no lo hacían. Esta búsqueda sesgada de información se correlacionó bien con el efecto de polarización. [30]

ElEl efecto contraproducente es el nombre que recibe el hallazgo de que, dada evidencia en contra de sus creencias, las personas pueden rechazar la evidencia y creer aún más firmemente.[138][139]La frase fue acuñada porBrendan Nyhany Jason Reifler en 2010.[140]Sin embargo, las investigaciones posteriores no han logrado replicar los hallazgos que respaldan el efecto contraproducente.[141]Un estudio realizado en la Universidad Estatal de Ohio y la Universidad George Washington estudió a 10.100 participantes con 52 problemas diferentes que se esperaba que desencadenaran un efecto contraproducente. Si bien los hallazgos concluyeron que las personas son reacias a aceptar hechos que contradicen su ideología ya sostenida, no se detectaron casos de efecto contraproducente.[142]Desde entonces se ha observado que el efecto contraproducente es un fenómeno raro en lugar de una ocurrencia común[143](compárese con elefecto bumerán).

Persistencia de creencias desacreditadas

Las creencias pueden sobrevivir a potentes desafíos lógicos o empíricos. Pueden sobrevivir e incluso verse reforzadas por evidencias que la mayoría de los observadores no comprometidos con la teoría considerarían lógicamente necesarias para debilitarlas. Pueden incluso sobrevivir a la destrucción total de sus bases evidenciales originales.

—Lee Ross y Craig Anderson [144]

Los sesgos de confirmación proporcionan una explicación plausible para la persistencia de las creencias cuando se elimina la evidencia inicial que las respalda o cuando han sido contradichas tajantemente. [3] : 187 Este efecto de perseverancia de la creencia fue demostrado experimentalmente por primera vez por Festinger , Riecken y Schachter. Estos psicólogos pasaron tiempo con una secta cuyos miembros estaban convencidos de que el mundo terminaría el 21 de diciembre de 1954. Después de que la predicción fallara, la mayoría de los creyentes todavía se aferraron a su fe. Su libro que describe esta investigación se titula acertadamente When Prophecy Fails . [145]

Sin embargo, el término perseverancia en la creencia se acuñó en una serie de experimentos que utilizaban lo que se denomina el "paradigma del debriefing": los participantes leen evidencia falsa a favor de una hipótesis, se mide su cambio de actitud y luego se expone la falsedad en detalle. Luego se miden sus actitudes una vez más para ver si su creencia vuelve a su nivel anterior. [144]

Un hallazgo común es que al menos parte de la creencia inicial permanece incluso después de un informe completo. [146] En un experimento, los participantes tuvieron que distinguir entre notas de suicidio reales y falsas. La retroalimentación fue aleatoria: a algunos se les dijo que lo habían hecho bien, mientras que a otros se les dijo que lo habían hecho mal. Incluso después de haber sido completamente informados, los participantes todavía estaban influenciados por la retroalimentación. Todavía pensaban que eran mejores o peores que el promedio en ese tipo de tarea, dependiendo de lo que se les había dicho inicialmente. [147]

En otro estudio, los participantes leyeron las calificaciones de desempeño laboral de dos bomberos, junto con sus respuestas a una prueba de aversión al riesgo . [144] Estos datos ficticios se organizaron para mostrar una asociación positiva o negativa: a algunos participantes se les dijo que un bombero que tomaba riesgos se desempeñaba mejor, mientras que a otros se les dijo que se desempeñaban peor que un colega reacio al riesgo. [148] Incluso si estos dos estudios de caso fueran verdaderos, habrían sido evidencia científicamente pobre para una conclusión sobre los bomberos en general. Sin embargo, los participantes los encontraron subjetivamente persuasivos. [148] Cuando se demostró que los estudios de caso eran ficticios, la creencia de los participantes en un vínculo disminuyó, pero aproximadamente la mitad del efecto original permaneció. [144] Las entrevistas de seguimiento establecieron que los participantes habían comprendido la sesión informativa y la habían tomado en serio. Los participantes parecían confiar en la sesión informativa, pero consideraban que la información desacreditada era irrelevante para su creencia personal. [148]

El efecto de influencia continua es la tendencia de la desinformación a seguir influyendo en la memoria y el razonamiento sobre un acontecimiento, a pesar de que se haya retractado o corregido. Esto ocurre incluso cuando el individuo cree en la corrección. [149]

Preferencia por información temprana

Los experimentos han demostrado que la información tiene un mayor peso cuando aparece al principio de una serie, incluso cuando el orden no es importante. Por ejemplo, las personas se forman una impresión más positiva de alguien descrito como "inteligente, trabajador, impulsivo, crítico, testarudo, envidioso" que cuando se les dan las mismas palabras en orden inverso. [150] Este efecto de primacía irracional es independiente del efecto de primacía en la memoria en el que los elementos anteriores de una serie dejan un rastro más fuerte en la memoria. [150] La interpretación sesgada ofrece una explicación para este efecto: al ver la evidencia inicial, las personas forman una hipótesis de trabajo que afecta la forma en que interpretan el resto de la información. [3] : 187

Una demostración de primacía irracional utilizó fichas de colores supuestamente extraídas de dos urnas. A los participantes se les dijo la distribución de colores de las urnas y tuvieron que estimar la probabilidad de que una ficha fuera extraída de una de ellas. [150] De hecho, los colores aparecieron en un orden preestablecido. Las primeras treinta extracciones favorecieron a una urna y las siguientes treinta favorecieron a la otra. [3] : 187 La serie en su conjunto fue neutral, por lo que racionalmente, las dos urnas eran igualmente probables. Sin embargo, después de sesenta extracciones, los participantes favorecieron la urna sugerida por las treinta iniciales. [150]

Otro experimento consistía en una presentación de diapositivas de un solo objeto, que al principio se veía borroso y que se enfocaba un poco mejor con cada diapositiva siguiente. [150] Después de cada diapositiva, los participantes tenían que indicar su mejor suposición de qué era el objeto. Los participantes cuyas primeras suposiciones eran erróneas persistían en ellas, incluso cuando la imagen estaba lo suficientemente enfocada como para que otras personas pudieran reconocer fácilmente el objeto. [3] : 187

Asociación ilusoria entre acontecimientos

La correlación ilusoria es la tendencia a ver correlaciones inexistentes en un conjunto de datos. [151] Esta tendencia se demostró por primera vez en una serie de experimentos a finales de los años 1960. [152] En un experimento, los participantes leyeron un conjunto de estudios de casos psiquiátricos, incluidas las respuestas a la prueba de manchas de tinta de Rorschach . Los participantes informaron que los hombres homosexuales en el conjunto tenían más probabilidades de informar haber visto nalgas, anos o figuras sexualmente ambiguas en las manchas de tinta. De hecho, los estudios de casos ficticios habían sido construidos de modo que los hombres homosexuales no tuvieran más probabilidades de informar sobre estas imágenes o, en una versión del experimento, tuvieran menos probabilidades de informar sobre ellas que los hombres heterosexuales. [151] En una encuesta, un grupo de psicoanalistas experimentados informó el mismo conjunto de asociaciones ilusorias con la homosexualidad. [151] [152]

Otro estudio registró los síntomas que experimentaron los pacientes artríticos junto con las condiciones climáticas durante un período de 15 meses. Casi todos los pacientes informaron que sus dolores estaban correlacionados con las condiciones climáticas, aunque la correlación real fue cero. [153]

| Días | Lluvia | Sin lluvia |

|---|---|---|

| Artritis | 14 | 6 |

| Sin artritis | 7 | 2 |

Este efecto es un tipo de interpretación sesgada, en el sentido de que se interpretan pruebas objetivamente neutrales o desfavorables para apoyar creencias existentes. También está relacionado con sesgos en la conducta de prueba de hipótesis. [154] Al juzgar si dos eventos, como la enfermedad y el mal tiempo, están correlacionados, las personas se basan en gran medida en el número de casos positivos-positivos : en este ejemplo, instancias tanto de dolor como de mal tiempo. Prestan relativamente poca atención a los otros tipos de observación (de ausencia de dolor y/o buen tiempo). [155] Esto es paralelo a la dependencia de pruebas positivas en la prueba de hipótesis. [154] También puede reflejar un recuerdo selectivo, en el sentido de que las personas pueden tener la sensación de que dos eventos están correlacionados porque es más fácil recordar momentos en los que sucedieron juntos. [154]

Véase también

Notas

- ^ David Perkins , profesor e investigador de la Escuela de Educación de la Universidad de Harvard, acuñó el término "sesgo de mi lado" en referencia a una preferencia por "mi" lado de una cuestión. [1]

- ^ "Sesgo de asimilación" es otro término utilizado para referirse a una interpretación sesgada de la evidencia. [7]

- ^ Wason también utilizó el término "sesgo de verificación". [57]

Referencias

Citas

- ^ Barón 2000, pág. 195.

- ^ Hart, William; Albarracin, D.; Eagly, AH; Brechan, I.; Lindberg, MJ; Merrill, L. (2009), "Sentirse validado versus estar en lo correcto: un metaanálisis de la exposición selectiva a la información", Psychological Bulletin , 135 (4): 555–588, doi :10.1037/a0015701, PMC 4797953 , PMID 19586162

- ^ abcdefghijklmnop Nickerson 1998, págs. 175-220

- ^ Plus 1993, pág. 233

- ^ Darley, John M.; Gross, Paget H. (2000), "Un sesgo de confirmación de hipótesis en los efectos del etiquetado", en Stangor, Charles (ed.), Estereotipos y prejuicios: lecturas esenciales , Psychology Press , pág. 212, ISBN 978-0-86377-589-5, OCLC 42823720

- ^ Resucitado y Gilovich 2007

- ^ Risen y Gilovich 2007, pág. 113.

- ^ abc Oswald y Grosjean 2004, págs. 82-83

- ^ por Hergovich, Schott y Burger 2010

- ^ abc Zweig, Jason (19 de noviembre de 2009), "Cómo ignorar al hombre que dice sí a todo en tu cabeza", Wall Street Journal , archivado desde el original el 14 de febrero de 2015 , consultado el 13 de junio de 2010

- ^ abcd Kunda 1999, págs. 112-115

- ^ Ab Baron 2000, págs. 162-64

- ^ Kida 2006, págs. 162–65

- ^ Devine, Patricia G.; Hirt, Edward R.; Gehrke, Elizabeth M. (1990), "Estrategias de diagnóstico y confirmación en pruebas de hipótesis de rasgos", Journal of Personality and Social Psychology , 58 (6): 952–963, doi :10.1037/0022-3514.58.6.952, ISSN 1939-1315

- ^ Trope, Yaacov; Bassok, Miriam (1982), "Estrategias confirmatorias y diagnósticas en la recopilación de información social", Journal of Personality and Social Psychology , 43 (1): 22–34, doi :10.1037/0022-3514.43.1.22, ISSN 1939-1315

- ^ abcd Klayman, Joshua; Ha, Young-Won (1987), "Confirmación, desconfirmación e información en las pruebas de hipótesis" (PDF) , Psychological Review , 94 (2): 211–228, CiteSeerX 10.1.1.174.5232 , doi :10.1037/0033-295X.94.2.211, ISSN 0033-295X, S2CID 10853196, archivado (PDF) del original el 1 de octubre de 2011 , consultado el 14 de agosto de 2009

- ^ Kunda, Ziva; Fong, GT; Sanitoso, R.; Reber, E. (1993), "Las preguntas direccionales dirigen las autoconcepciones", Journal of Experimental Social Psychology , 29 : 62–63, doi :10.1006/jesp.1993.1004, ISSN 0022-1031Vía Fine 2006, págs. 63–65

- ^ ab Shafir, E. (1993), "Elegir versus rechazar: por qué algunas opciones son mejores y peores que otras", Memory and Cognition , 21 (4): 546–556, doi : 10.3758/bf03197186 , PMID 8350746Vía Fine 2006, págs. 63–65

- ^ Snyder, Mark; Swann, William B. Jr. (1978), "Procesos de prueba de hipótesis en la interacción social", Journal of Personality and Social Psychology , 36 (11): 1202–1212, doi :10.1037/0022-3514.36.11.1202Vía Poletiek 2001, pág. 131

- ^ Ab Kunda 1999, págs. 117-18

- ^ ab Albarracin, D.; Mitchell, AL (2004), "El papel de la confianza defensiva en la preferencia por información proactitudinal: cómo creer que uno es fuerte puede ser a veces una debilidad defensiva", Personality and Social Psychology Bulletin , 30 (12): 1565–1584, doi :10.1177/0146167204271180, PMC 4803283 , PMID 15536240

- ^ Fischer, P.; Fischer, Julia K.; Aydin, Nilüfer; Frey, Dieter (2010), "Las fuentes de información social físicamente atractivas conducen a una mayor exposición selectiva a la información", Basic and Applied Social Psychology , 32 (4): 340–347, doi :10.1080/01973533.2010.519208, S2CID 143133082

- ^ Dahlgren, Peter M. (2020), Cámaras de eco de los medios: exposición selectiva y sesgo de confirmación en el uso de los medios y sus consecuencias para la polarización política, Gotemburgo: Universidad de Gotemburgo, ISBN 978-91-88212-95-5, archivado del original el 6 de abril de 2023 , consultado el 16 de octubre de 2021

- ^ abcd Stanovich, KE; West, RF; Toplak, ME (2013), "Sesgo de Myside, pensamiento racional e inteligencia", Current Directions in Psychological Science , 22 (4): 259–264, doi :10.1177/0963721413480174, S2CID 14505370

- ^ ab Mynatt, Clifford R.; Doherty, Michael E.; Tweney, Ryan D. (1978), "Consecuencias de la confirmación y la desconfirmación en un entorno de investigación simulado", Quarterly Journal of Experimental Psychology , 30 (3): 395–406, doi :10.1080/00335557843000007, S2CID 145419628

- ^ Kida 2006, pág. 157

- ^ abcdef Lord, Charles G.; Ross, Lee; Lepper, Mark R. (1979), "Asimilación sesgada y polarización de actitudes: los efectos de las teorías previas en la evidencia considerada posteriormente", Journal of Personality and Social Psychology , 37 (11): 2098–2109, CiteSeerX 10.1.1.372.1743 , doi :10.1037/0022-3514.37.11.2098, ISSN 0022-3514, S2CID 7465318

- ^ ab Barón 2000, págs. 201-202

- ^ Vyse 1997, pág. 122

- ^ abcd Taber, Charles S.; Lodge, Milton (julio de 2006), "Escepticismo motivado en la evaluación de las creencias políticas", American Journal of Political Science , 50 (3): 755–769, CiteSeerX 10.1.1.472.7064 , doi :10.1111/j.1540-5907.2006.00214.x, ISSN 0092-5853, S2CID 3770487

- ^ abc Westen, Drew; Blagov, Pavel S.; Harenski, Keith; Kilts, Clint; Hamann, Stephan (2006), "Bases neuronales del razonamiento motivado: un estudio fMRI de las limitaciones emocionales en el juicio político partidista en las elecciones presidenciales estadounidenses de 2004", Journal of Cognitive Neuroscience , 18 (11): 1947–1958, CiteSeerX 10.1.1.578.8097 , doi :10.1162/jocn.2006.18.11.1947, PMID 17069484, S2CID 8625992

- ^ Gadenne, V.; Oswald, M. (1986), "Entstehung und Veränderung von Bestätigungstendenzen beim Testen von Hypothesen [Formación y alteración de tendencias confirmatorias durante la prueba de hipótesis]", Zeitschrift für Experimentelle und Angewandte Psychologie , 33 : 360–374Vía Oswald & Grosjean 2004, pág. 89

- ^ Hastie, Reid; Park, Bernadette (2005), "La relación entre la memoria y el juicio depende de si la tarea de juicio se basa en la memoria o en línea", en Hamilton, David L. (ed.), Cognición social: lecturas clave , Nueva York: Psychology Press, pág. 394, ISBN 978-0-86377-591-8, OCLC 55078722

- ^ abc Oswald y Grosjean 2004, págs. 88-89

- ^ Stangor, Charles; McMillan, David (1992), "Memoria para información congruente con las expectativas y no congruente con las expectativas: una revisión de la literatura social y del desarrollo social", Psychological Bulletin , 111 (1): 42–61, doi :10.1037/0033-2909.111.1.42

- ^ ab Snyder, M.; Cantor, N. (1979), "Prueba de hipótesis sobre otras personas: el uso del conocimiento histórico", Journal of Experimental Social Psychology , 15 (4): 330–342, doi :10.1016/0022-1031(79)90042-8Vía Goldacre 2008, pág. 231

- ^ Kunda 1999, págs. 225-232

- ^ Sanitioso, Rasyid; Kunda, Ziva; Fong, GT (1990), "Reclutamiento motivado de recuerdos autobiográficos", Journal of Personality and Social Psychology , 59 (2): 229–241, doi :10.1037/0022-3514.59.2.229, ISSN 0022-3514, PMID 2213492

- ^ abc Levine, L.; Prohaska, V.; Burgess, SL; Rice, JA; Laulhere, TM (2001), "Recordando emociones pasadas: el papel de las valoraciones actuales", Cognition and Emotion , 15 (4): 393–417, doi :10.1080/02699930125955, S2CID 22743423

- ^ ab Safer, MA; Bonanno, GA; Field, N. (2001), "Nunca fue tan malo: recuerdo sesgado del duelo y adaptación a largo plazo a la muerte de un cónyuge", Memory , 9 (3): 195–203, doi :10.1080/09658210143000065, PMID 11469313, S2CID 24729233

- ^ ab Russell, Dan; Jones, Warren H. (1980), "Cuando la superstición falla: reacciones a la refutación de las creencias paranormales", Personality and Social Psychology Bulletin , 6 (1): 83–88, doi :10.1177/014616728061012, ISSN 1552-7433, S2CID 145060971Vía Vyse 1997, pág. 121

- ^ Baron, Jonathan (1995), "Sesgo de mi lado al pensar en el aborto"., Pensamiento y razonamiento , 1 (3): 221–235, CiteSeerX 10.1.1.112.1603 , doi :10.1080/13546789508256909

- ^ abcd Wolfe, Christopher; Anne Britt (2008), "El lugar del sesgo de mi lado en la argumentación escrita" (PDF) , Thinking & Reasoning , 14 : 1–27, doi :10.1080/13546780701527674, S2CID 40527220, archivado (PDF) del original el 4 de marzo de 2016 , consultado el 11 de noviembre de 2014

- ^ Mason, Lucia; Scirica, Fabio (octubre de 2006), "Predicción de las habilidades de argumentación de los estudiantes sobre temas controvertidos mediante la comprensión epistemológica", Aprendizaje e instrucción , 16 (5): 492–509, doi :10.1016/j.learninstruc.2006.09.007

- ^ Weinstock, Michael (2009), "Experiencia relativa en una tarea de razonamiento cotidiano: comprensión epistémica, representación del problema y competencia de razonamiento", Learning and Individual Differences , 19 (4): 423–434, doi :10.1016/j.lindif.2009.03.003

- ^ Weinstock, Michael; Neuman, Yair; Tabak, Iris (2004), "¿Pasando por alto el punto o pasando por alto las normas? Las normas epistemológicas como predictores de la capacidad de los estudiantes para identificar argumentos falaces", Contemporary Educational Psychology , 29 (1): 77–94, doi :10.1016/S0361-476X(03)00024-9

- ^ Tucídides 4.108.4.

- ^ Alighieri, Dante. Paradiso canto XIII: 118-120. Trans. Allen Mandelbaum.

- ^ Ibn Khaldun (1958), The Muqadimmah , Princeton, Nueva Jersey: Princeton University Press , p. 71.

- ^ ab Baron 2000, págs. 195-196.

- ^ ab Bacon, Francis (1620). Novum Organum . Reimpreso en Burtt, E. A., ed. (1939), Los filósofos ingleses desde Bacon hasta Mill , Nueva York: Random House , pág. 36.vía Nickerson 1998, pág. 176.

- ^ Schopenhauer, Arthur (2011) [1844], Carus, David; Aquila, Richard E. (eds.),El mundo como voluntad y presentación, vol. 2, Nueva York: Routledge , pág. 246.

- ^ Tolstoi, Leo (1896). ¿Qué es el arte? cap. 14 p. 143 Archivado el 17 de agosto de 2021 en Wayback Machine . Traducido del ruso por Aylmer Maude, Nueva York, 1904. Edición del Proyecto Gutenberg Archivado el 7 de agosto de 2021 en Wayback Machine. Publicado el 23 de marzo de 2021. Consultado el 17 de agosto de 2021.

- ^ Tolstoi, León (1894). El reino de Dios está en vosotros, pág. 49 Archivado el 17 de agosto de 2021 en Wayback Machine . Traducido del ruso por Constance Garnett, Nueva York, 1894. Edición del Proyecto Gutenberg Archivado el 17 de agosto de 2021 en Wayback Machine, publicado el 26 de julio de 2013. Consultado el 17 de agosto de 2021.

- ^ Wasson 1960

- ^ Lewicka 1998, pág. 238

- ^ Poletiek 2001, pág. 73.

- ^ Oswald y Grosjean 2004, págs. 79-96

- ^ Wason, Peter C. (1968), "Razonando sobre una regla", Quarterly Journal of Experimental Psychology , 20 (3): 273–278, doi :10.1080/14640746808400161, ISSN 1747-0226, PMID 5683766, S2CID 1212273

- ^ abc Sutherland, Stuart (2007), Irracionalidad (2.ª ed.), Londres: Pinter y Martin, págs. 95-103, ISBN 978-1-905177-07-3, OCLC 72151566

- ^ Barkow, Jerome H.; Cosmides, Leda; Tooby, John (1995), La mente adaptada: psicología evolutiva y la generación de cultura, Oxford University Press US, págs. 181–184, ISBN 978-0-19-510107-2, OCLC 33832963

- ^ Oswald y Grosjean 2004, págs. 81-82, 86-87

- ^ Plus 1993, pág. 233

- ^ Lewicka 1998, pág. 239

- ^ Tweney, Ryan D.; Doherty, Michael E. (1980), "Estrategias de descubrimiento de reglas en una tarea de inferencia", The Quarterly Journal of Experimental Psychology , 32 (1): 109–123, doi :10.1080/00335558008248237, ISSN 1747-0226, S2CID 143148831(Experimento IV)

- ^ Oswald y Grosjean 2004, págs. 86-89

- ^ MacCoun 1998

- ^ Friedrich 1993, pág. 298

- ^ Kunda 1999, pág. 94

- ^ Barón 2000, pág. 206

- ^ Matlin, Margaret W. (2004), "Principio de Pollyanna", en Pohl, Rüdiger F. (ed.), Ilusiones cognitivas: un manual sobre falacias y sesgos en el pensamiento, el juicio y la memoria , Hove, Reino Unido: Psychology Press , pp. 255–272, ISBN 978-1-84169-351-4, OCLC 55124398

- ^ Dawson, Erica; Gilovich, Thomas ; Regan, Dennis T. (octubre de 2002), "Razonamiento motivado y desempeño en la tarea de selección de Wason", Personality and Social Psychology Bulletin , 28 (10): 1379–1387, doi :10.1177/014616702236869, S2CID 143957893

- ^ Ditto, Peter H.; Lopez, David F. (1992), "Escepticismo motivado: uso de criterios de decisión diferencial para conclusiones preferidas y no preferidas", Journal of Personality and Social Psychology , 63 (4): 568–584, doi :10.1037/0022-3514.63.4.568, ISSN 0022-3514

- ^ Oswald y Grosjean 2004, págs. 91-93

- ^ Friedrich 1993, págs. 299, 316–317

- ^ Trope, Y.; Liberman, A. (1996), "Pruebas de hipótesis sociales: mecanismos cognitivos y motivacionales", en Higgins, E. Tory; Kruglanski, Arie W. (eds.), Psicología social: Manual de principios básicos , Nueva York: Guilford Press, ISBN 978-1-57230-100-9, OCLC 34731629Vía Oswald y Grosjean 2004, págs. 91–93