Detección de esquinas

| Detección de características |

|---|

| Edge detection |

| Corner detection |

|

| Blob detection |

| Ridge detection |

| Hough transform |

| Structure tensor |

| Affine invariant feature detection |

| Feature description |

| Scale space |

La detección de esquinas es un enfoque utilizado en los sistemas de visión artificial para extraer determinados tipos de características e inferir el contenido de una imagen. La detección de esquinas se utiliza con frecuencia en la detección de movimiento , el registro de imágenes , el seguimiento de vídeo , la creación de mosaicos de imágenes , la unión de panoramas , la reconstrucción 3D y el reconocimiento de objetos . La detección de esquinas se superpone con el tema de interés de la detección de puntos .

Formalización

Una esquina puede definirse como la intersección de dos aristas. Una esquina también puede definirse como un punto para el cual existen dos direcciones de aristas dominantes y diferentes en un entorno local del punto.

Un punto de interés es un punto de una imagen que tiene una posición bien definida y que se puede detectar de forma fiable. Esto significa que un punto de interés puede ser una esquina, pero también puede ser, por ejemplo, un punto aislado de intensidad local máxima o mínima, finales de línea o un punto en una curva donde la curvatura es máxima a nivel local.

En la práctica, la mayoría de los métodos de detección de esquinas detectan puntos de interés en general y, de hecho, el término "esquina" y "punto de interés" se utilizan de forma más o menos intercambiable en la literatura [1] . En consecuencia, si solo se van a detectar esquinas, es necesario realizar un análisis local de los puntos de interés detectados para determinar cuáles de ellos son esquinas reales. Algunos ejemplos de detección de bordes que se pueden utilizar con posprocesamiento para detectar esquinas son el operador de Kirsch y el conjunto de enmascaramiento de Frei-Chen [2] .

En la literatura, los términos "esquina", "punto de interés" y "característica" se utilizan indistintamente, lo que genera confusión. En concreto, existen varios detectores de manchas a los que se puede hacer referencia como "operadores de puntos de interés", pero que a veces se denominan erróneamente "detectores de esquinas". Además, existe un concepto de detección de crestas para captar la presencia de objetos alargados.

Los detectores de esquinas no suelen ser muy robustos y a menudo requieren la introducción de grandes redundancias para evitar que el efecto de errores individuales domine la tarea de reconocimiento.

Una determinación de la calidad de un detector de esquinas es su capacidad para detectar la misma esquina en múltiples imágenes similares, bajo diferentes condiciones de iluminación, traslación, rotación y otras transformaciones.

Un método simple para detectar esquinas en imágenes es el uso de la correlación , pero resulta muy costoso en términos computacionales y no es óptimo. Un método alternativo que se utiliza con frecuencia se basa en un método propuesto por Harris y Stephens (abajo), que a su vez es una mejora de un método de Moravec.

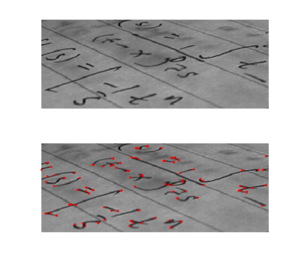

Algoritmo de detección de esquinas de Moravec

Este es uno de los primeros algoritmos de detección de esquinas y define una esquina como un punto con baja autosimilitud. [3] El algoritmo prueba cada píxel de la imagen para ver si hay una esquina, considerando qué tan similar es un parche centrado en el píxel a parches cercanos, en gran medida superpuestos. La similitud se mide tomando la suma de las diferencias al cuadrado (SSD) entre los píxeles correspondientes de dos parches. Un número más bajo indica mayor similitud.

Si el píxel se encuentra en una región de intensidad uniforme, las áreas cercanas se verán similares. Si el píxel se encuentra en un borde, las áreas cercanas en una dirección perpendicular al borde se verán bastante diferentes, pero las áreas cercanas en una dirección paralela al borde solo tendrán un pequeño cambio. Si el píxel se encuentra en una característica con variación en todas las direcciones, ninguna de las áreas cercanas se verá similar.

La fuerza de la esquina se define como la SSD más pequeña entre el parche y sus vecinos (horizontal, vertical y en las dos diagonales). La razón es que si este número es alto, entonces la variación a lo largo de todos los desplazamientos es igual o mayor que él, por lo que se captura que todos los parches cercanos se ven diferentes.

Si se calcula el número de resistencia de las esquinas para todas las ubicaciones, el hecho de que sea localmente máximo para una ubicación indica que en ella está presente una característica de interés.

Como señala Moravec, uno de los principales problemas de este operador es que no es isótropo : si hay un borde que no está en la dirección de los vecinos (horizontal, vertical o diagonal), entonces el SSD más pequeño será grande y el borde se elegirá incorrectamente como punto de interés. [4]

Algoritmos de detección de esquinas de Harris & Stephens/Shi–Tomasi

Harris y Stephens [5] mejoraron el detector de esquinas de Moravec al considerar el diferencial de la puntuación de esquina con respecto a la dirección directamente, en lugar de utilizar parches desplazados. (Esta puntuación de esquina se conoce a menudo como autocorrelación , ya que el término se utiliza en el artículo en el que se describe este detector. Sin embargo, las matemáticas en el artículo indican claramente que se utiliza la suma de las diferencias al cuadrado).

Sin perder generalidad, supondremos que se utiliza una imagen bidimensional en escala de grises. Sea esta imagen dada por . Consideremos tomar un parche de imagen sobre el área y desplazarlo por . La suma ponderada de las diferencias al cuadrado (SSD) entre estos dos parches, denotada , está dada por:

se puede aproximar mediante una expansión de Taylor . Sean y las derivadas parciales de , tales que

Esto produce la aproximación

que puede escribirse en forma matricial:

donde A es el tensor de estructura ,

En palabras, encontramos la covarianza de la derivada parcial de la intensidad de la imagen con respecto a los ejes y .

Los corchetes angulares indican el promedio (es decir, la suma de ). indica el tipo de ventana que se desliza sobre la imagen. Si se utiliza un filtro Box , la respuesta será anisotrópica , pero si se utiliza un filtro Gaussiano , la respuesta será isotrópica .

Una esquina (o en general un punto de interés) se caracteriza por una gran variación de en todas las direcciones del vector . Analizando los valores propios de , esta caracterización se puede expresar de la siguiente manera: debería tener dos valores propios "grandes" para un punto de interés. Con base en las magnitudes de los valores propios, se pueden hacer las siguientes inferencias basadas en este argumento:

- Si y entonces este píxel no tiene características de interés.

- Si y tiene algún valor positivo grande, entonces se encuentra una arista.

- Si y tienen valores positivos grandes, entonces se encuentra una esquina.

Harris y Stephens señalan que el cálculo exacto de los valores propios es computacionalmente costoso, ya que requiere el cálculo de una raíz cuadrada , y en su lugar sugieren la siguiente función , donde es un parámetro de sensibilidad ajustable:

Por lo tanto, el algoritmo [6] no tiene que calcular realmente la descomposición del valor propio de la matriz y en su lugar es suficiente evaluar el determinante y la traza para encontrar esquinas, o más bien puntos de interés en general.

El detector de esquinas Shi-Tomasi [7] realiza el cálculo directamente porque, bajo ciertas suposiciones, las esquinas son más estables para el seguimiento. Tenga en cuenta que este método también se conoce a veces como detector de esquinas Kanade-Tomasi.

El valor de debe determinarse empíricamente y en la literatura se han reportado como factibles valores en el rango de 0,04 a 0,15.

Se puede evitar la configuración del parámetro utilizando la medida de esquina de Noble [8] , que equivale a la media armónica de los valores propios:

siendo una pequeña constante positiva.

Si se puede interpretar como la matriz de precisión para la posición de la esquina, la matriz de covarianza para la posición de la esquina es , es decir

La suma de los valores propios de , que en ese caso puede interpretarse como una varianza generalizada (o una "incertidumbre total") de la posición de la esquina, está relacionada con la medida de la esquina de Noble mediante la siguiente ecuación:

El detector de esquinas de Förstner

En algunos casos, es posible que se desee calcular la ubicación de una esquina con una precisión de subpíxeles. Para lograr una solución aproximada, el algoritmo de Förstner [9] resuelve el punto más cercano a todas las líneas tangentes de la esquina en una ventana dada y es una solución de mínimos cuadrados. El algoritmo se basa en el hecho de que, en una esquina ideal, las líneas tangentes se cruzan en un único punto.

La ecuación de una línea tangente en un píxel viene dada por:

¿Dónde está el vector de gradiente de la imagen en ?

El punto más cercano a todas las líneas tangentes en la ventana es:

La distancia desde las líneas tangentes se pondera según la magnitud del gradiente, lo que da más importancia a las tangentes que pasan por píxeles con gradientes fuertes.

Resolviendo para :

se definen como:

Esta ecuación se puede minimizar derivándola con respecto a y fijándola igual a 0:

Nótese que es la estructura tensor . Para que la ecuación tenga solución, debe ser invertible, lo que implica que debe ser de rango completo (rango 2). Por lo tanto, la solución

Sólo existe donde existe una esquina real en la ventana .

Lindeberg [10] [11] presentó una metodología para realizar la selección automática de escala para este método de localización de esquinas minimizando el residuo normalizado.

sobre escalas. De este modo, el método tiene la capacidad de adaptar automáticamente los niveles de escala para calcular los gradientes de imagen al nivel de ruido en los datos de imagen, eligiendo niveles de escala más gruesos para datos de imagen ruidosos y niveles de escala más finos para estructuras similares a esquinas casi ideales.

Notas:

- puede verse como un residuo en el cálculo de la solución de mínimos cuadrados: si , entonces no hubo error.

- Este algoritmo se puede modificar para calcular centros de características circulares cambiando las líneas tangentes por líneas normales.

El operador multiescala de Harris

El cálculo de la segunda matriz de momentos (a veces también denominada tensor de estructura ) en el operador de Harris requiere el cálculo de las derivadas de la imagen en el dominio de la imagen, así como la suma de las combinaciones no lineales de estas derivadas en los vecindarios locales. Dado que el cálculo de las derivadas generalmente implica una etapa de suavizado del espacio de escala, una definición operativa del operador de Harris requiere dos parámetros de escala: (i) una escala local para suavizar antes del cálculo de las derivadas de la imagen , y (ii) una escala de integración para acumular las operaciones no lineales sobre los operadores de derivada en un descriptor de imagen integrado.

Con la denotación de la intensidad de la imagen original, denotemos la representación del espacio de escala obtenida por convolución con un núcleo gaussiano

con parámetro de escala local :

y sean y las derivadas parciales de . Además, introduzca una función de ventana gaussiana con parámetro de escala de integración . Entonces, la matriz de segundo momento multiescala [12] [13] [14] se puede definir como

Luego, podemos calcular los valores propios de una manera similar a los valores propios de y definir la medida de esquina de Harris de múltiples escalas como

En cuanto a la elección del parámetro de escala local y el parámetro de escala de integración , estos parámetros de escala suelen estar acoplados por un parámetro de escala de integración relativa tal que , donde normalmente se elige en el intervalo . [12] [13] Por lo tanto, podemos calcular la medida de esquina de Harris de múltiples escalas en cualquier escala en el espacio de escala para obtener un detector de esquinas de múltiples escalas, que responde a estructuras de esquinas de diferentes tamaños en el dominio de la imagen.

En la práctica, este detector de esquinas de múltiples escalas a menudo se complementa con un paso de selección de escala , donde se utiliza el operador laplaciano normalizado de escala [11] [12]

se calcula en cada escala en el espacio de escala y los puntos de esquina adaptados a la escala con selección de escala automática (el "operador Harris-Laplace") se calculan a partir de los puntos que son simultáneamente: [15]

- Máximos espaciales de la medida de esquina multiescala

- máximos o mínimos locales sobre escalas del operador laplaciano normalizado en escala [11] :

El enfoque de la curvatura de la curva de nivel

Un enfoque anterior para la detección de esquinas es detectar puntos donde la curvatura de las curvas de nivel y la magnitud del gradiente son simultáneamente altas. [16] [17] Una forma diferencial de detectar dichos puntos es calculando la curvatura de la curva de nivel reescalada (el producto de la curvatura de la curva de nivel y la magnitud del gradiente elevada a la potencia de tres).

y detectar máximos positivos y mínimos negativos de esta expresión diferencial en alguna escala en la representación del espacio de escala de la imagen original. [10] [11] Sin embargo, un problema principal al calcular la entidad de curvatura de la curva de nivel reescalada en una sola escala es que puede ser sensible al ruido y a la elección del nivel de escala. Un método mejor es calcular la curvatura de la curva de nivel reescalada normalizada

con y para detectar extremos de escala-espacio con signo de esta expresión, que son puntos y escalas que son máximos positivos y mínimos negativos con respecto tanto al espacio como a la escala

en combinación con un paso de localización complementario para manejar el aumento del error de localización en escalas más gruesas. [10] [11] [12] De esta manera, los valores de escala más grandes se asociarán con esquinas redondeadas de gran extensión espacial, mientras que los valores de escala más pequeñas se asociarán con esquinas agudas con pequeña extensión espacial. Este enfoque es el primer detector de esquinas con selección de escala automática (antes del "operador Harris-Laplace" mencionado anteriormente) y se ha utilizado para rastrear esquinas bajo variaciones de gran escala en el dominio de la imagen [18] y para hacer coincidir las respuestas de las esquinas con los bordes para calcular características de imagen estructural para el reconocimiento de objetos basado en geones . [19]

Laplaciano de Gauss, diferencias de Gauss y determinante de los puntos de interés del espacio de escala hessiano

LoG [11] [12] [15] es un acrónimo que significa Laplaciano de Gauss , DoG [20] es un acrónimo que significa Diferencia de Gaussianos (DoG es una aproximación de LoG) y DoH es un acrónimo que significa Determinante de Hessiano . [11] Todos estos puntos de interés invariantes en la escala se extraen detectando los extremos del espacio de escala de expresiones diferenciales normalizadas en la escala, es decir, puntos en el espacio de escala donde las expresiones diferenciales normalizadas en la escala correspondientes asumen extremos locales con respecto tanto al espacio como a la escala [11]

donde denota la entidad diferencial normalizada de escala apropiada (definida a continuación).

Estos detectores se describen de forma más completa en la detección de manchas . El laplaciano normalizado a escala de las características gaussianas y de diferencia de gaussianas (Lindeberg 1994, 1998; Lowe 2004) [11] [12] [20]

no necesariamente hacen características altamente selectivas, ya que estos operadores también pueden conducir a respuestas cerca de los bordes. Para mejorar la capacidad de detección de esquinas del detector de diferencias de Gaussianas, el detector de características utilizado en el sistema SIFT [20] utiliza una etapa de posprocesamiento adicional, donde los valores propios del hessiano de la imagen en la escala de detección se examinan de manera similar al operador de Harris. Si la relación de los valores propios es demasiado alta, entonces la imagen local se considera demasiado parecida a un borde, por lo que la característica se rechaza. También el Laplaciano de Lindeberg del detector de características Gaussianas se puede definir para que comprenda un umbral complementario en un invariante diferencial complementario para suprimir las respuestas cerca de los bordes. [21]

El determinante normalizado de escala del operador hessiano (Lindeberg 1994, 1998) [11] [12]

Por otra parte, es altamente selectivo para las características de la imagen bien localizadas y solo responde cuando hay variaciones significativas en el nivel de gris en dos direcciones de la imagen [11] [14] y es en este y otros aspectos un mejor detector de puntos de interés que el laplaciano del gaussiano. El determinante del hessiano es una expresión diferencial covariante afín y tiene mejores propiedades de selección de escala bajo transformaciones de imágenes afines que el operador laplaciano (Lindeberg 2013, 2015). [21] [22] Experimentalmente, esto implica que el determinante de los puntos de interés del hessiano tiene mejores propiedades de repetibilidad bajo la deformación de la imagen local que los puntos de interés laplacianos, lo que a su vez conduce a un mejor rendimiento de la correspondencia basada en imágenes en términos de puntuaciones de eficiencia más altas y puntuaciones de precisión 1− más bajas . [21]

Las propiedades de selección de escala, las propiedades de transformación afín y las propiedades experimentales de estos y otros detectores de puntos de interés en el espacio de escala se analizan en detalle en (Lindeberg 2013, 2015). [21] [22]

Puntos de interés en el espacio de escala basados en las medidas de resistencia de las características de Lindeberg Hessian

Inspirado en las propiedades estructuralmente similares de la matriz hessiana de una función y la matriz de segundo momento (tensor de estructura) , como se puede manifestar, por ejemplo, en términos de sus propiedades de transformación similares bajo deformaciones de imagen afines [13] [21]

- ,

- ,

Lindeberg (2013, 2015) [21] [22] propuso definir cuatro medidas de intensidad de características a partir de la matriz de Hesse de manera similar a como se definen los operadores de Harris y Shi-and-Tomasi a partir del tensor de estructura (matriz de segundo momento). Específicamente, definió las siguientes medidas de intensidad de características de Hesse con y sin signo:

- Medida de intensidad de característica hessiana sin signo I:

- La medida de resistencia característica hessiana firmada I:

- Medida de intensidad de característica hessiana sin signo II:

- Medida de resistencia de la característica hessiana firmada II:

donde y denotan la traza y el determinante de la matriz hessiana de la representación del espacio de escala en cualquier escala , mientras que

denotan los valores propios de la matriz hessiana. [23]

La medida de intensidad de característica hessiana sin signo responde a los extremos locales mediante valores positivos y no es sensible a los puntos de silla, mientras que la medida de intensidad de característica hessiana con signo responde adicionalmente a los puntos de silla mediante valores negativos. La medida de intensidad de característica hessiana sin signo es insensible a la polaridad local de la señal, mientras que la medida de intensidad de característica hessiana con signo responde a la polaridad local de la señal mediante el signo de su salida.

En Lindeberg (2015) [21], estas cuatro entidades diferenciales se combinaron con una selección de escala local basada en la detección de extremos del espacio de escala.

o vinculación de escalas. Además, las medidas de fuerza de características de Hessian con y sin signo se combinaron con un umbral complementario en .

Mediante experimentos de correspondencia de imágenes bajo transformaciones de escala en un conjunto de datos de pósteres con 12 pósteres con correspondencia de múltiples vistas sobre transformaciones de escala hasta un factor de escala de 6 y variaciones de dirección de visualización hasta un ángulo de inclinación de 45 grados con descriptores de imagen locales definidos a partir de reformulaciones de los descriptores de imagen puros en los operadores SIFT y SURF a mediciones de imagen en términos de operadores derivados gaussianos (Gauss-SIFT y Gauss-SURF) en lugar de SIFT original como se define a partir de una pirámide de imagen o SURF original como se define a partir de wavelets de Haar, se demostró que la detección de puntos de interés del espacio de escala basada en la medida de intensidad de característica hessiana sin signo permitió el mejor rendimiento y un mejor rendimiento que los puntos de interés del espacio de escala obtenidos a partir del determinante del hessiano . Tanto la medida de intensidad de característica hessiana sin signo , la medida de intensidad de característica hessiana con signo y el determinante del hessiano permitieron un mejor rendimiento que el laplaciano del gaussiano . Cuando se combina con la vinculación de escala y el umbral complementario en , la medida de fuerza de característica hessiana firmada permitió además un mejor desempeño que el laplaciano del gaussiano .

Además, se demostró que todos estos detectores de puntos de interés en el espacio de escala diferencial definidos a partir de la matriz Hessiana permiten la detección de un mayor número de puntos de interés y un mejor rendimiento de coincidencia en comparación con los operadores de Harris y Shi y Tomasi definidos a partir del tensor de estructura (matriz de segundo momento).

En Lindeberg (2013) [22] se presenta un análisis teórico de las propiedades de selección de escala de estas cuatro medidas de fuerza de características hessianas y otras entidades diferenciales para detectar puntos de interés en el espacio de escala, incluido el laplaciano del gaussiano y el determinante del hessiano, y en Lindeberg (2015) se presenta un análisis de sus propiedades de transformación afín, así como de sus propiedades experimentales. [21]

Operadores de puntos de interés adaptados afines

Los puntos de interés obtenidos a partir del operador Harris multiescala con selección automática de escala son invariantes a las traslaciones, rotaciones y reescalamientos uniformes en el dominio espacial. Sin embargo, las imágenes que constituyen la entrada a un sistema de visión por computadora también están sujetas a distorsiones de perspectiva. Para obtener un operador de punto de interés que sea más robusto a las transformaciones de perspectiva, un enfoque natural es idear un detector de características que sea invariante a las transformaciones afines . En la práctica, los puntos de interés invariantes afines se pueden obtener aplicando una adaptación de forma afín donde la forma del núcleo de suavizado se deforma iterativamente para que coincida con la estructura de la imagen local alrededor del punto de interés o, equivalentemente, un parche de imagen local se deforma iterativamente mientras que la forma del núcleo de suavizado permanece rotacionalmente simétrica (Lindeberg 1993, 2008; Lindeberg y Garding 1997; Mikolajzcyk y Schmid 2004). [12] [13] [14] [15] Por lo tanto, además del operador Harris multiescala de uso común, la adaptación de forma afín se puede aplicar a otros detectores de esquinas como los que se enumeran en este artículo, así como a detectores de manchas diferenciales como el operador laplaciano/diferencia de Gauss, el determinante del hessiano [14] y el operador hessiano-Laplace.

El algoritmo de detección de esquinas de Wang y Brady

El detector de Wang y Brady [24] considera que la imagen es una superficie y busca lugares donde haya una gran curvatura a lo largo de un borde de la imagen. En otras palabras, el algoritmo busca lugares donde el borde cambia de dirección rápidamente. La puntuación de la esquina, , viene dada por:

donde es el vector unitario perpendicular al gradiente y determina qué tan fóbico es el detector con respecto a los bordes. Los autores también señalan que se requiere suavizado (se sugiere gaussiano) para reducir el ruido.

El suavizado también provoca el desplazamiento de las esquinas, por lo que los autores derivan una expresión para el desplazamiento de una esquina de 90 grados y la aplican como factor de corrección a las esquinas detectadas.

El detector de esquinas SUSAN

SUSAN [25] es un acrónimo que significa " núcleo asimilador del segmento univalor más pequeño" . Este método es objeto de una patente del Reino Unido de 1994 que ya no está vigente. [26]

Para la detección de características, SUSAN coloca una máscara circular sobre el píxel que se va a probar (el núcleo). La región de la máscara es , y un píxel en esta máscara está representado por . El núcleo está en . Cada píxel se compara con el núcleo utilizando la función de comparación:

donde es el umbral de diferencia de brillo, [27] es el brillo del píxel y la potencia del exponente se ha determinado empíricamente. Esta función tiene la apariencia de una función rectangular o de sombrero de copa suavizada . El área de la SUSAN viene dada por:

Si es la función rectangular, entonces es el número de píxeles de la máscara que se encuentran dentro del núcleo. La respuesta del operador SUSAN viene dada por:

donde se denomina "umbral geométrico". En otras palabras, el operador SUSAN solo tiene una puntuación positiva si el área es lo suficientemente pequeña. El SUSAN más pequeño a nivel local se puede encontrar utilizando supresión no máxima, y este es el operador SUSAN completo.

El valor determina qué tan similares deben ser los puntos al núcleo antes de que se los considere parte del segmento univalente. El valor de determina el tamaño mínimo del segmento univalente. Si es lo suficientemente grande, se convierte en un detector de bordes .

Para la detección de esquinas, se utilizan dos pasos más. En primer lugar, se encuentra el centroide de la SUSAN. Una esquina adecuada tendrá el centroide alejado del núcleo. El segundo paso insiste en que todos los puntos de la línea desde el núcleo a través del centroide hasta el borde de la máscara estén en la SUSAN.

El detector de esquinas de Trajkovic y Hedley

De manera similar a SUSAN, este detector [28] prueba directamente si un parche debajo de un píxel es autosimilar al examinar los píxeles cercanos. es el píxel que se debe considerar y es un punto en un círculo centrado alrededor de . El punto es el punto opuesto a lo largo del diámetro.

La función de respuesta se define como:

Esto será grande cuando no haya una dirección en la que el píxel central sea similar a dos píxeles cercanos a lo largo de un diámetro. es un círculo discretizado (un círculo de Bresenham ), por lo que se utiliza la interpolación para diámetros intermedios para dar una respuesta más isotrópica. Dado que cualquier cálculo da un límite superior en , primero se verifican las direcciones horizontal y vertical para ver si vale la pena continuar con el cálculo completo de .

Detectores de características basados en AST

AST es un acrónimo que significa prueba de segmento acelerado . Esta prueba es una versión relajada del criterio de esquina SUSAN. En lugar de evaluar el disco circular, solo se consideran los píxeles en un círculo de Bresenham de radio alrededor del punto candidato. Si los píxeles contiguos son todos más brillantes que el núcleo por al menos o todos más oscuros que el núcleo por , entonces el píxel debajo del núcleo se considera una característica. Se informa que esta prueba produce características muy estables. [29] La elección del orden en el que se prueban los píxeles es un llamado problema de veinte preguntas . La construcción de árboles de decisión cortos para este problema da como resultado los detectores de características computacionalmente más eficientes disponibles.

El primer algoritmo de detección de esquinas basado en el AST es FAST ( features from accelerated segment test ). [29] Aunque en principio puede tomar cualquier valor, FAST utiliza solo un valor de 3 (que corresponde a un círculo de 16 píxeles de circunferencia), y las pruebas muestran que los mejores resultados se obtienen con 9. Este valor es el más bajo en el que no se detectan los bordes. El orden en el que se prueban los píxeles lo determina el algoritmo ID3 a partir de un conjunto de imágenes de entrenamiento. Resulta confuso que el nombre del detector sea algo similar al nombre del artículo que describe el detector de Trajkovic y Hedley.

Síntesis automática de detectores

Trujillo y Olague [30] introdujeron un método mediante el cual se utiliza la programación genética para sintetizar automáticamente operadores de imagen que pueden detectar puntos de interés. Los conjuntos de funciones y terminales contienen operaciones primitivas que son comunes en muchos diseños creados por el hombre propuestos anteriormente. La aptitud mide la estabilidad de cada operador a través de la tasa de repetibilidad y promueve una dispersión uniforme de los puntos detectados a lo largo del plano de la imagen. El rendimiento de los operadores evolucionados se ha confirmado experimentalmente utilizando secuencias de entrenamiento y prueba de imágenes transformadas progresivamente. Por lo tanto, el algoritmo GP propuesto se considera competitivo para el problema de la detección de puntos de interés.

Detectores de puntos de interés espacio-temporales

El operador de Harris ha sido extendido al espacio-tiempo por Laptev y Lindeberg. [31] Sea la matriz de segundo momento espacio-temporal definida por

Luego, para una elección adecuada de , se detectan puntos de interés espacio-temporales a partir de los extremos espacio-temporales de la siguiente medida de Harris espacio-temporal:

Willems et al [32] y Lindeberg [33] extendieron el determinante del operador hessiano al espacio-tiempo conjunto, dando lugar a la siguiente expresión diferencial normalizada en escala:

En el trabajo de Willems et al., [32] se utilizó una expresión más simple correspondiente a y . En Lindeberg, [33] se demostró que y implica mejores propiedades de selección de escala en el sentido de que los niveles de escala seleccionados obtenidos a partir de un blob gaussiano espacio-temporal con extensión espacial y extensión temporal coincidirán perfectamente con la extensión espacial y la duración temporal del blob, y la selección de escala se realizará detectando los extremos de escala-espacio espacio-temporales de la expresión diferencial.

Lindeberg ha extendido el operador laplaciano a datos de vídeo espaciotemporales, [33] dando lugar a los dos operadores espaciotemporales siguientes, que también constituyen modelos de campos receptivos de neuronas no rezagadas frente a rezagadas en el LGN :

Para el primer operador, las propiedades de selección de escala requieren el uso de y , si queremos que este operador asuma su valor máximo en escalas espacio-temporales a un nivel de escala espacio-temporal que refleje la extensión espacial y la duración temporal de un blob gaussiano de inicio. Para el segundo operador, las propiedades de selección de escala requieren el uso de y , si queremos que este operador asuma su valor máximo en escalas espacio-temporales a un nivel de escala espacio-temporal que refleje la extensión espacial y la duración temporal de un blob gaussiano parpadeante.

Everts et al. han investigado las extensiones de color de los detectores de puntos de interés espacio-temporales [34] .

Bibliografía

- ^ Andrew Willis y Yunfeng Sui (2009). "Un modelo algebraico para la detección rápida de esquinas". 2009 IEEE 12th International Conference on Computer Vision . IEEE. págs. 2296–2302. doi :10.1109/ICCV.2009.5459443. ISBN 978-1-4244-4420-5.

- ^ Shapiro, Linda y George C. Stockman (2001). Visión artificial , pág. 257. Prentice Books, Upper Saddle River. ISBN 0-13-030796-3 .

- ^ H. Moravec (1980). "Evitación de obstáculos y navegación en el mundo real mediante un robot explorador con visión". Informe técnico CMU-RI-TR-3 Carnegie-Mellon University, Robotics Institute .

- ^ Evasión de obstáculos y navegación en el mundo real mediante un robot explorador con visión, Hans Moravec, marzo de 1980, Departamento de Ciencias de la Computación, Universidad de Stanford (tesis doctoral)

- ^ C. Harris y M. Stephens (1988). "Un detector combinado de esquinas y bordes" (PDF) . Actas de la 4.ª Conferencia de Alvey Vision . pp. 147–151. Archivado desde el original (PDF) el 2022-04-01 . Consultado el 2010-12-30 .

- ^ Javier Sánchez, Nelson Monzón y Agustín Salgado (2018). «An Analysis and Implementation of the Harris Corner Detector». Procesamiento de imágenes en línea . 8 : 305–328. doi : 10.5201/ipol.2018.229 . hdl : 10553/43499 . Archivado desde el original el 2020-05-11 . Consultado el 2020-05-06 .

{{cite journal}}: CS1 maint: bot: original URL status unknown (link) - ^ J. Shi y C. Tomasi (junio de 1994). "Buenas características para rastrear". Novena Conferencia IEEE sobre Visión por Computadora y Reconocimiento de Patrones . Springer. págs. 593–600. CiteSeerX 10.1.1.36.2669 . doi :10.1109/CVPR.1994.323794.

C. Tomasi y T. Kanade (1991). Detección y seguimiento de características puntuales (informe técnico). Facultad de Ciencias de la Computación, Universidad Carnegie Mellon. CiteSeerX 10.1.1.45.5770 . CMU-CS-91-132. - ^ A. Noble (1989). Descripciones de superficies de imágenes (Ph.D.). Departamento de Ciencias de la Ingeniería, Universidad de Oxford. p. 45.

- ^ Förstner, W; Gülch (1987). "Un operador rápido para la detección y ubicación precisa de puntos, esquinas y centros distintos de características circulares" (PDF) . ISPRS .

- ^ abc T. Lindeberg (1994). "Detección de uniones con selección automática de escalas de detección y de localización". Proc. 1.ª Conferencia Internacional sobre Procesamiento de Imágenes . Vol. I. Austin, Texas. págs. 924–928.

- ^ abcdefghijk Tony Lindeberg (1998). "Detección de características con selección automática de escala". Revista internacional de visión artificial . Vol. 30, núm. 2. págs. 77–116.

- ^ abcdefgh T. Lindeberg (1994). Teoría del espacio de escala en la visión por computadora. Springer. ISBN 978-0-7923-9418-1.

- ^ abcd T. Lindeberg y J. Garding "Suavizado adaptado a la forma en la estimación de claves de profundidad 3-D a partir de distorsiones afines de la estructura 2-D local". Image and Vision Computing 15 (6): pp 415–434, 1997.

- ^ abcd T. Lindeberg (2008). "Escala-Espacio". En Benjamin Wah (ed.). Enciclopedia Wiley de Ciencias de la Computación e Ingeniería. Vol. IV. John Wiley and Sons. págs. 2495–2504. doi :10.1002/9780470050118.ecse609. ISBN 978-0-470-05011-8.

- ^ abc K. Mikolajczyk, K. y C. Schmid (2004). "Detectores de puntos de interés invariantes afines y de escala" (PDF) . Revista Internacional de Visión por Computador . 60 (1): 63–86. doi :10.1023/B:VISI.0000027790.02288.f2. S2CID 1704741.

- ^ L. Kitchen y A. Rosenfeld (1982). "Detección de esquinas en niveles de gris". Pattern Recognition Letters . Vol. 1, núm. 2. págs. 95–102.

- ^ JJ Koenderink y W. Richards (1988). "Operadores de curvatura bidimensionales". Journal of the Optical Society of America A . Vol. 5, núm. 7. págs. 1136–1141.

- ^ L. Bretzner y T. Lindeberg (1998). "Seguimiento de características con selección automática de escalas espaciales". Visión artificial y comprensión de imágenes . Vol. 71. págs. 385–392.

- ^ T. Lindeberg y M.-X. Li (1997). "Segmentación y clasificación de aristas utilizando aproximación de longitud de descripción mínima y claves de unión complementarias". Visión artificial y comprensión de imágenes . Vol. 67, núm. 1. págs. 88–98.

- ^ abc D. Lowe (2004). "Características distintivas de la imagen a partir de puntos clave invariantes en la escala". Revista internacional de visión artificial . 60 (2): 91. CiteSeerX 10.1.1.73.2924 . doi :10.1023/B:VISI.0000029664.99615.94. S2CID 221242327.

- ^ abcdefgh T. Lindeberg «Correspondencia de imágenes utilizando puntos de interés en el espacio de escala generalizado», Journal of Mathematical Imaging and Vision, volumen 52, número 1, páginas 3-36, 2015.

- ^ abcd T. Lindeberg "Propiedades de selección de escala de detectores de puntos de interés en el espacio de escala generalizado", Journal of Mathematical Imaging and Vision, Volumen 46, Número 2, páginas 177-210, 2013.

- ^ Lindeberg, T. (1998). "Detección de bordes y crestas con selección automática de escala". Revista internacional de visión artificial . 30 (2): 117–154. doi :10.1023/A:1008097225773. S2CID 35328443.

- ^ H. Wang y M. Brady (1995). "Algoritmo de detección de esquinas en tiempo real para estimación de movimiento". Image and Vision Computing . 13 (9): 695–703. doi :10.1016/0262-8856(95)98864-P.

- ^ SM Smith y JM Brady (mayo de 1997). "SUSAN: un nuevo enfoque para el procesamiento de imágenes de bajo nivel". Revista internacional de visión por computadora . 23 (1): 45–78. doi :10.1023/A:1007963824710. S2CID 15033310.

SM Smith y JM Brady (enero de 1997), "Método para procesar digitalmente imágenes con el fin de determinar la posición de los bordes y/o esquinas de las mismas para guiar un vehículo no tripulado". Patente del Reino Unido 2272285, titular: Secretario de Estado de Defensa, Reino Unido. - ^ Patente GB 2272285, Smith, Stephen Mark, "Determinación de la posición de los bordes y las esquinas en las imágenes", publicada el 11 de mayo de 1994, expedida el 11 de mayo de 1994, asignada al Departamento de Defensa.

- ^ "El detector de bordes SUSAN en detalle".

- ^ M. Trajkovic y M. Hedley (1998). "Detección rápida de esquinas". Image and Vision Computing . 16 (2): 75–87. doi :10.1016/S0262-8856(97)00056-5.

- ^ ab E. Rosten y T. Drummond (mayo de 2006). "Aprendizaje automático para detección de esquinas a alta velocidad". Conferencia Europea sobre Visión Artificial .

- ^ Leonardo Trujillo y Gustavo Olague (2008). "Diseño automatizado de operadores de imagen que detectan puntos de interés" (PDF) . Computación Evolutiva . 16 (4): 483–507. doi :10.1162/evco.2008.16.4.483. PMID 19053496. S2CID 17704640. Archivado desde el original (PDF) el 17 de julio de 2011.

- ^ Ivan Laptev y Tony Lindeberg (2003). "Puntos de interés espacio-temporales". Conferencia Internacional sobre Visión por Computador . IEEE. págs. 432–439.

- ^ por Geert Willems, Tinne Tuytelaars y Luc van Gool (2008). "Un detector de puntos de interés espaciotemporal-temporal eficiente, denso e invariante en escala". Conferencia Europea sobre Visión por Computador . Springer Lecture Notes in Computer Science. Vol. 5303. págs. 650–663. doi :10.1007/978-3-540-88688-4_48.

- ^ abc Tony Lindeberg (2018). "Selección de escala espacio-temporal en datos de vídeo". Revista de imágenes y visión matemática . 60 (4): 525–562. doi : 10.1007/s10851-017-0766-9 . S2CID 254649837.

- ^ I. Everts, J. van Gemert y T. Gevers (2014). "Evaluación de puntos de interés espacio-temporales de color para el reconocimiento de acciones humanas". IEEE Transactions on Image Processing . 23 (4): 1569–1589. doi :10.1109/TIP.2014.2302677. PMID 24577192. S2CID 1999196.

Implementaciones de referencia

Esta sección proporciona enlaces externos a implementaciones de referencia de algunos de los detectores descritos anteriormente. Estas implementaciones de referencia son proporcionadas por los autores del artículo en el que se describe por primera vez el detector. Es posible que contengan detalles que no están presentes o no son explícitos en los artículos que describen las características.

- Detección de DoG (como parte del sistema SIFT ), ejecutables de Windows y Linux x86

- Harris-Laplace, ejecutables estáticos para Linux . También incluye detectores DoG y LoG y adaptación afín para todos los detectores incluidos.

- Detector FAST, código fuente C, C++, MATLAB y ejecutables para varios sistemas operativos y arquitecturas.

- lip-vireo Archivado el 11 de mayo de 2017 en Wayback Machine , [LoG, DoG, Harris-Laplaciano, Hessiano y Hessiano-Laplaciano], [SIFT, SIFT invariante de inversión, PCA-SIFT, PSIFT, Filtros orientables, SPIN][Linux, Windows y SunOS] ejecutables.

- Procesamiento de imágenes de bajo nivel SUSAN, código fuente C.

- Implementación en línea del detector de esquinas Harris - IPOL

Véase también

- detección de manchas

- adaptación de forma afín

- espacio de escala

- detección de crestas

- detección de puntos de interés

- Detección de características (visión por computadora)

- Derivado de imagen

Enlaces externos

- Lindeberg, Tony (2001) [1994], "Detección de esquinas", Enciclopedia de matemáticas , EMS Press

- Brostow, "Detección de esquinas - Ciencias de la Computación de la UCL"

![{\estilo de visualización [1,2]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f2614991ef363710c34e03eb9110d7423e3f60c2)