El procesamiento del lenguaje en el cerebro

Este artículo tiene varios problemas. Ayúdenos a mejorarlo o a discutir estos problemas en la página de discusión . ( Aprenda cómo y cuándo eliminar estos mensajes )

|

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional.

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional. En psicolingüística , el procesamiento del lenguaje se refiere a la forma en que los seres humanos utilizan las palabras para comunicar ideas y sentimientos, y cómo se procesan y comprenden dichas comunicaciones. Se considera que el procesamiento del lenguaje es una capacidad exclusivamente humana que no se produce con la misma comprensión gramatical o sistematicidad ni siquiera en los parientes primates más cercanos de los humanos . [1]

A lo largo del siglo XX, el modelo dominante [2] para el procesamiento del lenguaje en el cerebro fue el modelo Geschwind-Lichteim-Wernicke , que se basa principalmente en el análisis de pacientes con daño cerebral . Sin embargo, debido a las mejoras en los registros electrofisiológicos intracorticales de cerebros de monos y humanos , así como técnicas no invasivas como fMRI , PET , MEG y EEG , se ha revelado una vía auditiva dual [3] [4] y se ha desarrollado un modelo de dos corrientes . De acuerdo con este modelo, hay dos vías que conectan la corteza auditiva con el lóbulo frontal , cada una de las cuales representa diferentes funciones lingüísticas. La vía de la corriente ventral auditiva es responsable del reconocimiento del sonido y, en consecuencia, se la conoce como la vía auditiva del "qué". La corriente dorsal auditiva , tanto en humanos como en primates no humanos, es responsable de la localización del sonido y, en consecuencia, se la conoce como la vía auditiva del "dónde". En los seres humanos, esta vía (especialmente en el hemisferio izquierdo ) también es responsable de la producción del habla , la repetición del habla, la lectura de labios y la memoria de trabajo fonológica y la memoria a largo plazo . De acuerdo con el modelo de evolución del lenguaje "de dónde a qué", [5] [6] la razón por la que el ADS se caracteriza por una gama tan amplia de funciones es que cada una indica una etapa diferente en la evolución del lenguaje.

La división de las dos corrientes ocurre primero en el nervio auditivo , donde la rama anterior ingresa al núcleo coclear anterior en el tronco encefálico, lo que da origen a la corriente auditiva ventral. La rama posterior ingresa al núcleo coclear dorsal y posteroventral para dar origen a la corriente auditiva dorsal. [7] : 8

El procesamiento del lenguaje también puede ocurrir en relación con los lenguajes de señas o el contenido escrito .

Los primeros modelos neurolingüísticos

A lo largo del siglo XX, nuestro conocimiento del procesamiento del lenguaje en el cerebro estuvo dominado por el modelo de Wernicke-Lichtheim-Geschwind. [8] [2] [9] El modelo de Wernicke-Lichtheim-Geschwind se basa principalmente en investigaciones realizadas en individuos con daño cerebral que se informó que tenían una variedad de trastornos relacionados con el lenguaje. De acuerdo con este modelo, las palabras se perciben a través de un centro especializado de recepción de palabras ( área de Wernicke ) que se encuentra en la unión temporoparietal izquierda . Esta región luego se proyecta a un centro de producción de palabras ( área de Broca ) que se encuentra en el giro frontal inferior izquierdo . Debido a que se pensaba que casi toda la entrada del lenguaje se canalizaba a través del área de Wernicke y toda la salida del lenguaje a través del área de Broca, se volvió extremadamente difícil identificar las propiedades básicas de cada región. Esta falta de definición clara de la contribución de las regiones de Wernicke y Broca al lenguaje humano hizo que fuera extremadamente difícil identificar sus homólogos en otros primates. [10] Sin embargo, con la llegada de la fMRI y su aplicación para el mapeo de lesiones, se demostró que este modelo se basa en correlaciones incorrectas entre síntomas y lesiones. [11] [12] [13] [14] [15] [16] [17] La refutación de un modelo tan influyente y dominante abrió la puerta a nuevos modelos de procesamiento del lenguaje en el cerebro.

Modelos neurolingüísticos actuales

Anatomía

En las últimas dos décadas, se produjeron avances significativos en nuestra comprensión del procesamiento neuronal de los sonidos en los primates. Inicialmente, mediante el registro de la actividad neuronal en las cortezas auditivas de los monos [18] [19] y más tarde elaborado mediante tinción histológica [20] [21] [22] y estudios de escaneo fMRI , [23] se identificaron 3 campos auditivos en la corteza auditiva primaria, y se mostró que 9 campos auditivos asociativos los rodeaban (Figura 1 arriba a la izquierda). El trazado anatómico y los estudios de lesiones indicaron además una separación entre los campos auditivos anterior y posterior, con los campos auditivos primarios anteriores (áreas R-RT) proyectándose a los campos auditivos asociativos anteriores (áreas AL-RTL), y el campo auditivo primario posterior (área A1) proyectándose a los campos auditivos asociativos posteriores (áreas CL-CM). [20] [24] [25] [26] Recientemente, se acumuló evidencia que indica homología entre los campos auditivos humanos y de los monos. En humanos, los estudios de tinción histológica revelaron dos campos auditivos separados en la región auditiva primaria del giro de Heschl , [27] [28] y al mapear la organización tonotópica de los campos auditivos primarios humanos con fMRI de alta resolución y compararla con la organización tonotópica de los campos auditivos primarios del mono, se estableció homología entre el campo auditivo primario anterior humano y el área R del mono (denotada en humanos como área hR) y el campo auditivo primario posterior humano y el área A1 del mono (denotada en humanos como área hA1). [29] [30] [31] [32] [33] Los registros intracorticales de la corteza auditiva humana demostraron además patrones similares de conectividad con la corteza auditiva del mono. Un registro de la superficie de la corteza auditiva (plano supratemporal) informó que el giro de Heschl anterior (área hR) se proyecta principalmente al giro temporal superior medio-anterior (mSTG-aSTG) y el giro de Heschl posterior (área hA1) se proyecta principalmente al giro temporal superior posterior (pSTG) y al plano temporal (área PT; Figura 1 arriba a la derecha). [34] [35] En consonancia con las conexiones del área hR al aSTG y de hA1 al pSTG se encuentra un estudio de fMRI de un paciente con deterioro del reconocimiento de sonidos ( agnosia auditiva ), que mostró una activación bilateral reducida en las áreas hR y aSTG pero con una activación preservada en el mSTG-pSTG. [36]Este patrón de conectividad también está corroborado por un estudio que registró la activación de la superficie lateral de la corteza auditiva e informó sobre grupos de activación simultáneos no superpuestos en pSTG y mSTG-aSTG mientras se escuchaban sonidos. [37]

Corriente abajo hacia la corteza auditiva, los estudios de rastreo anatómico en monos delinearon proyecciones desde los campos auditivos asociativos anteriores (áreas AL-RTL) a las cortezas prefrontal y premotora ventral en el giro frontal inferior (IFG) [38] [39] y la amígdala . [40] Los estudios de registro cortical e imágenes funcionales en monos macacos profundizaron en esta corriente de procesamiento al mostrar que la información acústica fluye desde la corteza auditiva anterior al polo temporal (TP) y luego al IFG. [41] [42] [43] [44] [45] [46] Esta vía se conoce comúnmente como la corriente auditiva ventral (AVS; Figura 1, flechas rojas inferiores a la izquierda). A diferencia de los campos auditivos anteriores, los estudios de rastreo informaron que los campos auditivos posteriores (áreas CL-CM) se proyectan principalmente a las cortezas prefrontal y premotora dorsolateral (aunque algunas proyecciones terminan en el IFG. [47] [39] Los registros corticales y los estudios de rastreo anatómico en monos proporcionaron evidencia adicional de que esta corriente de procesamiento fluye desde los campos auditivos posteriores al lóbulo frontal a través de una estación de retransmisión en el surco intraparietal (IPS). [48] [49] [ 50] [51] [52] [53] Esta vía se conoce comúnmente como la corriente auditiva dorsal (ADS; Figura 1, flechas azules inferiores izquierdas). La comparación de las vías de materia blanca involucradas en la comunicación en humanos y monos con técnicas de imágenes de tensor de difusión indica conexiones similares del AVS y ADS en las dos especies (Mono, [52] Humano [54] [55] [56] [57] [58] [59] ). En humanos, la Se demostró que el pSTG se proyecta al lóbulo parietal ( unión parietal-temporal de Silvio - lóbulo parietal inferior ; Spt- IPL ), y desde allí a las cortezas prefrontal y premotora dorsolateral (Figura 1, abajo a la derecha, flechas azules), y se demostró que el aSTG se proyecta al lóbulo temporal anterior (giro temporal medio-polo temporal; MTG-TP) y desde allí al IFG (Figura 1 abajo a la derecha, flechas rojas).

Corriente auditiva ventral

La vía auditiva ventral (AVS) conecta la corteza auditiva con el giro temporal medio y el polo temporal , que a su vez se conecta con el giro frontal inferior . Esta vía es responsable del reconocimiento de sonidos y, por lo tanto, se la conoce como la vía auditiva del "qué". Las funciones del AVS incluyen las siguientes:

Reconocimiento de sonido

La evidencia convergente acumulada indica que el AVS está involucrado en el reconocimiento de objetos auditivos. A nivel de la corteza auditiva primaria, las grabaciones de monos mostraron un mayor porcentaje de neuronas selectivas para secuencias melódicas aprendidas en el área R que en el área A1, [60] y un estudio en humanos demostró más selectividad para sílabas escuchadas en el giro de Heschl anterior (área hR) que en el giro de Heschl posterior (área hA1). [61] En los campos auditivos asociativos descendentes, los estudios tanto de monos como de humanos informaron que la frontera entre los campos auditivos anterior y posterior (Figura 1: área PC en el mono y mSTG en el humano) procesa atributos de tono que son necesarios para el reconocimiento de objetos auditivos. [18] Los campos auditivos anteriores de los monos también demostraron selectividad para vocalizaciones conespecíficas con grabaciones intracorticales. [41] [19] [62] e imágenes funcionales [63] [42] [43] Un estudio de fMRI en monos demostró además un papel del aSTG en el reconocimiento de voces individuales. [42] El papel del mSTG-aSTG humano en el reconocimiento de sonido se demostró mediante estudios de imágenes funcionales que correlacionaron la actividad en esta región con el aislamiento de objetos auditivos del ruido de fondo, [64] [65] y con el reconocimiento de palabras habladas, [66] [67] [68] [69] [70] [71] [72] voces, [73] melodías, [74] [75] sonidos ambientales, [76] [77] [78] y sonidos comunicativos no verbales. [79] Un metaanálisis de estudios de fMRI [80] demostró además una disociación funcional entre el mSTG izquierdo y el aSTG, con el primero procesando unidades de habla cortas (fonemas) y el segundo procesando unidades más largas (por ejemplo, palabras, sonidos ambientales). Un estudio que registró la actividad neuronal directamente del pSTG y aSTG izquierdos informó que el aSTG, pero no el pSTG, era más activo cuando la paciente escuchaba el habla en su lengua materna que en un idioma extranjero desconocido. [81] De manera consistente, la electroestimulación del aSTG de esta paciente resultó en una percepción del habla deteriorada [81] (ver también [82] [83] para resultados similares). Los registros intracorticales del aSTG derecho e izquierdo demostraron además que el habla se procesa lateralmente a la música. [81] Un estudio de fMRI de un paciente con reconocimiento de sonido deteriorado (La agnosia auditiva ) debida a daño del tronco encefálico también se mostró con una activación reducida en las áreas hR y aSTG de ambos hemisferios al escuchar palabras habladas y sonidos ambientales. [36] Las grabaciones de la corteza auditiva anterior de monos mientras se mantienen los sonidos aprendidos en la memoria de trabajo, [46] y el efecto debilitante de las lesiones inducidas a esta región en el recuerdo de la memoria de trabajo, [84] [85] [86] implican además al AVS en el mantenimiento de los objetos auditivos percibidos en la memoria de trabajo. En humanos, el área mSTG-aSTG también se informó activa durante el ensayo de sílabas escuchadas con MEG. [87] y fMRI [88] El último estudio demostró además que la memoria de trabajo en el AVS es para las propiedades acústicas de las palabras habladas y que es independiente de la memoria de trabajo en el ADS, que media el habla interna. Los estudios de memoria de trabajo en monos también sugieren que en los monos, a diferencia de los humanos, el AVS es el almacén de memoria de trabajo dominante. [89]

En los seres humanos, aguas abajo del aSTG, se cree que el MTG y el TP constituyen el léxico semántico , que es un repositorio de memoria a largo plazo de representaciones audiovisuales que están interconectadas sobre la base de relaciones semánticas. (Véase también las revisiones de [3] [4] que tratan este tema). La evidencia principal de este papel del MTG-TP es que se informa [90] [91] de pacientes con daño en esta región (p. ej., pacientes con demencia semántica o encefalitis por virus del herpes simple ) con una capacidad deteriorada para describir objetos visuales y auditivos y una tendencia a cometer errores semánticos al nombrar objetos (es decir, parafasia semántica ). Las parafasias semánticas también fueron expresadas por pacientes afásicos con daño en el MTG-TP izquierdo [14] [92] y se demostró que ocurrían en pacientes no afásicos después de la electroestimulación en esta región. [93] [83] o la vía de la sustancia blanca subyacente [94] Dos metanálisis de la literatura fMRI también informaron que el MTG anterior y el TP estaban constantemente activos durante el análisis semántico del habla y el texto; [66] [95] y un estudio de registro intracortical correlacionó la descarga neuronal en el MTG con la comprensión de oraciones inteligibles. [96]

Comprensión de oraciones

Además de extraer significado de los sonidos, la región MTG-TP del AVS parece tener un papel en la comprensión de oraciones, posiblemente fusionando conceptos (p. ej., fusionando el concepto "azul" y "camisa" para crear el concepto de "camisa azul"). El papel del MTG en la extracción de significado de oraciones se ha demostrado en estudios de imágenes funcionales que informan una activación más fuerte en el MTG anterior cuando las oraciones adecuadas se contrastan con listas de palabras, oraciones en un idioma extranjero o sin sentido, oraciones desordenadas, oraciones con violaciones semánticas o sintácticas y secuencias similares a oraciones de sonidos ambientales. [97] [ 98] [99] [100] [101] [102] [103] [104] Un estudio de fMRI [105] en el que se instruyó a los participantes para que leyeran una historia correlacionó aún más la actividad en el MTG anterior con la cantidad de contenido semántico y sintáctico que contenía cada oración. Un estudio de EEG [106] que contrastó la actividad cortical durante la lectura de oraciones con y sin violaciones sintácticas en participantes sanos y pacientes con daño en el MTG-TP, concluyó que el MTG-TP en ambos hemisferios participa en la etapa automática (basada en reglas) del análisis sintáctico (componente ELAN), y que el MTG-TP izquierdo también está involucrado en una etapa controlada posterior del análisis sintáctico (componente P600). También se ha informado que los pacientes con daño en la región MTG-TP tienen comprensión de oraciones deteriorada. [14] [107] [108] Consulte la revisión [109] para obtener más información sobre este tema.

Bilateralidad

En contradicción con el modelo de Wernicke-Lichtheim-Geschwind que implica que el reconocimiento de sonidos ocurre únicamente en el hemisferio izquierdo, los estudios que examinaron las propiedades del hemisferio derecho o izquierdo de forma aislada mediante anestesia hemisférica unilateral (es decir, el procedimiento WADA [110] ) o grabaciones intracorticales de cada hemisferio [96] proporcionaron evidencia de que el reconocimiento de sonidos se procesa de forma bilateral. Además, un estudio que instruyó a pacientes con hemisferios desconectados (es decir, pacientes con cerebro dividido ) para que hicieran coincidir las palabras habladas con las palabras escritas presentadas en los hemicampos derecho o izquierdo, informó un vocabulario en el hemisferio derecho que casi coincide en tamaño con el hemisferio izquierdo [111] (el vocabulario del hemisferio derecho era equivalente al vocabulario de un niño sano de 11 años). Este reconocimiento bilateral de sonidos también es consistente con el hallazgo de que una lesión unilateral en la corteza auditiva rara vez resulta en un déficit en la comprensión auditiva (es decir, agnosia auditiva ), mientras que una segunda lesión en el hemisferio restante (que podría ocurrir años después) sí lo hace. [112] [113] Finalmente, como se mencionó anteriormente, una exploración fMRI de un paciente con agnosia auditiva demostró una activación reducida bilateral en las cortezas auditivas anteriores, [36] y la electroestimulación bilateral en estas regiones en ambos hemisferios resultó en un deterioro en el reconocimiento del habla. [81]

Corriente auditiva dorsal

La vía auditiva dorsal conecta la corteza auditiva con el lóbulo parietal , que a su vez se conecta con el giro frontal inferior . Tanto en los humanos como en los primates no humanos, la vía auditiva dorsal es responsable de la localización del sonido, y por ello se la conoce como vía auditiva del "dónde". En los humanos, esta vía (especialmente en el hemisferio izquierdo) también es responsable de la producción del habla, la repetición del habla, la lectura de los labios, la memoria de trabajo fonológica y la memoria a largo plazo.

Producción del habla

Estudios realizados en humanos actuales han demostrado que el ADS desempeña un papel en la producción del habla, en particular en la expresión vocal de los nombres de los objetos. Por ejemplo, en una serie de estudios en los que se estimularon directamente las fibras subcorticales [94], la interferencia en el pSTG y el IPL izquierdos dio lugar a errores durante las tareas de denominación de objetos, y la interferencia en el IFG izquierdo dio lugar a un paro del habla. La interferencia magnética en el pSTG y el IFG de participantes sanos también produjo errores del habla y paro del habla, respectivamente [114] [115]. Un estudio también ha informado de que la estimulación eléctrica del IPL izquierdo hizo que los pacientes creyeran que habían hablado cuando no lo habían hecho y que la estimulación del IFG hizo que los pacientes movieran inconscientemente los labios. [116] La contribución del ADS al proceso de articulación de los nombres de los objetos podría depender de la recepción de aferentes del léxico semántico del AVS, como informó un estudio de registro intracortical de activación en el MTG posterior antes de la activación en la región Spt- IPL cuando los pacientes nombraron objetos en imágenes [117] Los estudios de estimulación eléctrica intracortical también informaron que la interferencia eléctrica en el MTG posterior se correlacionó con una denominación de objetos deteriorada [118] [82]

Mímica vocal

Aunque la percepción del sonido se atribuye principalmente al AVS, el ADS parece estar asociado con varios aspectos de la percepción del habla. Por ejemplo, en un metaanálisis de estudios fMRI [119] (Turkeltaub y Coslett, 2010), en el que se contrastó la percepción auditiva de fonemas con sonidos muy similares y se calificó a los estudios según el nivel de atención requerido, los autores concluyeron que la atención a los fonemas se correlaciona con una fuerte activación en la región pSTG-pSTS. Un estudio de grabación intracortical en el que se instruyó a los participantes para que identificaran sílabas también correlacionó la audición de cada sílaba con su propio patrón de activación en el pSTG. [120] La participación del ADS tanto en la percepción como en la producción del habla se ha esclarecido aún más en varios estudios pioneros de imágenes funcionales que contrastaron la percepción del habla con la producción del habla manifiesta o encubierta. [121] [122] [123] Estos estudios demostraron que el pSTS está activo solo durante la percepción del habla, mientras que el área Spt está activa durante la percepción y la producción del habla. Los autores concluyeron que el pSTS se proyecta al área Spt, que convierte la entrada auditiva en movimientos articulatorios. [124] [125] Se obtuvieron resultados similares en un estudio en el que se estimularon eléctricamente los lóbulos temporal y parietal de los participantes. Este estudio informó que la estimulación eléctrica de la región pSTG interfiere con la comprensión de oraciones y que la estimulación del IPL interfiere con la capacidad de vocalizar los nombres de los objetos. [83] Los autores también informaron que la estimulación en el área Spt y el IPL inferior indujo interferencia durante las tareas de denominación de objetos y comprensión del habla. El papel del ADS en la repetición del habla también es congruente con los resultados de otros estudios de imágenes funcionales que han localizado la activación durante las tareas de repetición del habla en las regiones ADS. [126] [127] [128] Un estudio de registro intracortical que registró la actividad en la mayoría de los lóbulos temporal, parietal y frontal también informó la activación en el pSTG, Spt, IPL e IFG cuando la repetición del habla se contrasta con la percepción del habla. [129] Los estudios neuropsicológicos también han encontrado que los individuos con déficits de repetición del habla pero con comprensión auditiva preservada (es decir, afasia de conducción ) sufren daño circunscrito al área Spt-IPL [130] [131] [ 132 ] [133] [134] [135] [136] o daño a las proyecciones que emanan de esta área y se dirigen al lóbulo frontal [137] [138] [139] [140]Los estudios también han informado de un déficit transitorio de repetición del habla en pacientes después de una estimulación eléctrica intracortical directa en esta misma región. [11] [141] [142] Los estudios longitudinales de niños que correlacionaron el aprendizaje de vocabulario extranjero con la capacidad de repetir palabras sin sentido brindan una idea del propósito de la repetición del habla en el ADS. [143] [144]

Monitoreo del habla

Además de repetir y producir el habla, el ADS parece tener un papel en el control de la calidad de la salida del habla. La evidencia neuroanatómica sugiere que el ADS está equipado con conexiones descendentes desde el IFG al pSTG que transmiten información sobre la actividad motora (es decir, descargas corolarias) en el aparato vocal (boca, lengua, cuerdas vocales). Esta retroalimentación marca el sonido percibido durante la producción del habla como autoproducido y puede usarse para ajustar el aparato vocal para aumentar la similitud entre las llamadas percibidas y emitidas. Un estudio que estimuló eléctricamente el IFG durante operaciones quirúrgicas y reportó la propagación de la activación a la región pSTG-pSTS-Spt ha ofrecido evidencia de conexiones descendentes desde el IFG al pSTG [145]. Un estudio [146] que comparó la capacidad de pacientes afásicos con daño en el lóbulo frontal, parietal o temporal para articular rápida y repetidamente una cadena de sílabas informó que el daño al lóbulo frontal interfería con la articulación tanto de cadenas silábicas idénticas ("Bababa") como de cadenas silábicas no idénticas ("Badaga"), mientras que los pacientes con daño en el lóbulo temporal o parietal solo mostraron deterioro al articular cadenas silábicas no idénticas. Debido a que los pacientes con daño en el lóbulo temporal y parietal fueron capaces de repetir la cadena silábica en la primera tarea, su percepción y producción del habla parecen estar relativamente preservadas, y su déficit en la segunda tarea se debe, por lo tanto, a un monitoreo deficiente. Para demostrar el papel de las conexiones ADS descendentes en el monitoreo de llamadas emitidas, un estudio fMRI instruyó a los participantes a hablar en condiciones normales o cuando escuchaban una versión modificada de su propia voz (primer formante retrasado) e informó que escuchar una versión distorsionada de la propia voz da como resultado una mayor activación en el pSTG. [147] Otro estudio de registro intracortical que contrastó la percepción y la repetición del habla demostró que el ADS facilita la retroalimentación motora durante la mímica. [129] Los autores informaron que, además de la activación en el IPL y el IFG, la repetición del habla se caracteriza por una activación más fuerte en el pSTG que durante la percepción del habla.

Integración de fonemas con movimientos labiales

Aunque la percepción del sonido se atribuye principalmente al AVS, el ADS parece estar asociado con varios aspectos de la percepción del habla. Por ejemplo, en un metaanálisis de estudios de fMRI [119] en el que se contrastó la percepción auditiva de fonemas con sonidos muy similares y se calificó a los estudios según el nivel de atención requerido, los autores concluyeron que la atención a los fonemas se correlaciona con una fuerte activación en la región pSTG-pSTS. Un estudio de grabación intracortical en el que se instruyó a los participantes para que identificaran sílabas también correlacionó la audición de cada sílaba con su propio patrón de activación en el pSTG. [148] En consonancia con el papel del ADS en la discriminación de fonemas, [119] los estudios han atribuido la integración de fonemas y sus correspondientes movimientos labiales (es decir, visemas) al pSTS del ADS. Por ejemplo, un estudio de fMRI [149] ha correlacionado la activación en el pSTS con la ilusión de McGurk (en la que escuchar la sílaba "ba" mientras se ve el visema "ga" da como resultado la percepción de la sílaba "da"). Otro estudio ha descubierto que el uso de estimulación magnética para interferir con el procesamiento en esta área altera aún más la ilusión de McGurk. [150] La asociación del pSTS con la integración audiovisual del habla también se ha demostrado en un estudio que presentó a los participantes imágenes de caras y palabras habladas de calidad variable. El estudio informó que el pSTS selecciona el aumento combinado de la claridad de las caras y las palabras habladas. [151] Evidencia corroborante ha sido proporcionada por un estudio de fMRI [152] que contrastó la percepción del habla audiovisual con el no habla audiovisual (imágenes y sonidos de herramientas). Este estudio informó la detección de compartimentos selectivos del habla en el pSTS. Además, un estudio fMRI [153] que contrastó el habla audiovisual congruente con el habla incongruente (imágenes de caras estáticas) informó la activación del pSTS. Para una revisión que presenta evidencia convergente adicional sobre el papel del pSTS y el ADS en la integración de fonemas y visemas, consulte [154] .

Memoria fonológica a largo plazo

Un creciente cuerpo de evidencia indica que los humanos, además de tener un almacén a largo plazo para los significados de las palabras ubicado en el MTG-TP del AVS (es decir, el léxico semántico), también tienen un almacén a largo plazo para los nombres de los objetos ubicado en la región Spt-IPL del ADS (es decir, el léxico fonológico). Por ejemplo, un estudio [155] [156] que examinó a pacientes con daño en el AVS (daño en el MTG) o daño en el ADS (daño en el IPL) informó que el daño en el MTG da como resultado que los individuos identifiquen incorrectamente los objetos (p. ej., llamar a una "cabra" una "oveja", un ejemplo de parafasia semántica ). Por el contrario, el daño en el IPL da como resultado que los individuos identifiquen correctamente el objeto pero pronuncien incorrectamente su nombre (p. ej., decir "gof" en lugar de "cabra", un ejemplo de parafasia fonémica ). También se han reportado errores de parafasia semántica en pacientes que recibieron estimulación eléctrica intracortical del AVS (MTG), y errores de parafasia fonémica en pacientes cuyos ADS (pSTG, Spt e IPL) recibieron estimulación eléctrica intracortical. [83] [157] [94] Otro apoyo al papel del ADS en la denominación de objetos es un estudio MEG que localizó la actividad en el IPL durante el aprendizaje y durante el recuerdo de los nombres de los objetos. [158] Un estudio que indujo interferencia magnética en el IPL de los participantes mientras respondían preguntas sobre un objeto informó que los participantes eran capaces de responder preguntas sobre las características del objeto o los atributos perceptivos, pero se vieron afectados cuando se les preguntó si la palabra contenía dos o tres sílabas. [159] Un estudio MEG también ha correlacionado la recuperación de la anomia (un trastorno caracterizado por una capacidad deteriorada para nombrar objetos) con cambios en la activación del IPL. [160] Otro apoyo al papel del IPL en la codificación de los sonidos de las palabras son los estudios que informan que, en comparación con los monolingües, los bilingües tienen una mayor densidad cortical en el IPL pero no en el MTG. [161] [162] Debido a que la evidencia muestra que, en los bilingües , diferentes representaciones fonológicas de la misma palabra comparten la misma representación semántica, [163] este aumento en la densidad en el IPL verifica la existencia del léxico fonológico: se espera que el léxico semántico de los bilingües sea similar en tamaño al léxico semántico de los monolingües, mientras que su léxico fonológico debería ser el doble de grande. En consonancia con este hallazgo, la densidad cortical en el IPL de los monolingües también se correlaciona con el tamaño del vocabulario. [164] [165]Cabe destacar que la disociación funcional del AVS y el ADS en las tareas de denominación de objetos está respaldada por evidencia acumulada de investigaciones sobre lectura que muestran que los errores semánticos están correlacionados con el deterioro de la MTG y los errores fonémicos con el deterioro de la IPL. Con base en estas asociaciones, el análisis semántico del texto se ha vinculado con el giro temporal inferior y la MTG, y el análisis fonológico del texto se ha vinculado con el pSTG-Spt-IPL [166] [167] [168]

Memoria de trabajo fonológica

La memoria de trabajo se considera a menudo como la activación temporal de las representaciones almacenadas en la memoria a largo plazo que se utilizan para el habla (representaciones fonológicas). Este intercambio de recursos entre la memoria de trabajo y el habla es evidente por el hallazgo [169] [170] de que hablar durante el ensayo da como resultado una reducción significativa en el número de elementos que se pueden recordar de la memoria de trabajo ( supresión articulatoria ). La participación del léxico fonológico en la memoria de trabajo también se evidencia por la tendencia de los individuos a cometer más errores al recordar palabras de una lista recientemente aprendida de palabras fonológicamente similares que de una lista de palabras fonológicamente diferentes (el efecto de similitud fonológica ). [169] Los estudios también han encontrado que los errores de habla cometidos durante la lectura son notablemente similares a los errores de habla cometidos durante el recuerdo de palabras recientemente aprendidas, fonológicamente similares de la memoria de trabajo. [171] También se ha observado que los pacientes con daño de la IPL presentan errores de producción del habla y deterioro de la memoria de trabajo [172] [173] [174] [175] Finalmente, la visión de que la memoria de trabajo verbal es el resultado de la activación temporal de representaciones fonológicas en el ADS es compatible con modelos recientes que describen la memoria de trabajo como la combinación de mantenimiento de representaciones en el mecanismo de atención en paralelo a la activación temporal de representaciones en la memoria a largo plazo. [170] [176] [177] [178] Se ha argumentado que el papel del ADS en el ensayo de listas de palabras es la razón por la que esta vía está activa durante la comprensión de oraciones [179] Para una revisión del papel del ADS en la memoria de trabajo, consulte. [180]

Teorías lingüísticas

La investigación sobre el procesamiento del lenguaje informa las teorías del lenguaje . La pregunta teórica principal es si las estructuras lingüísticas se derivan de las estructuras cerebrales o viceversa. Los modelos externalistas, como el estructuralismo de Ferdinand de Saussure , sostienen que el lenguaje como fenómeno social es externo al cerebro. El individuo recibe el sistema lingüístico desde el exterior, y el lenguaje dado da forma al cerebro del individuo. [181]

Esta idea se enfrenta a modelos internalistas como la gramática generativa transformacional de Noam Chomsky , la lingüística cognitiva de George Lakoff y la hipótesis de eficiencia de John A. Hawkins . Según Chomsky, el lenguaje se adquiere a partir de una estructura cerebral innata independientemente del significado. [182] Lakoff sostiene que el lenguaje emerge de los sistemas sensoriales . [183] Hawkins plantea la hipótesis de que los patrones prevalecientes en diferentes idiomas se basan en las preferencias de procesamiento naturales del cerebro. [184]

Además, los modelos inspirados en la memética de Richard Dawkins , incluyendo la gramática de la construcción y la lingüística basada en el uso , abogan por un modelo bidireccional que sostiene que el cerebro da forma al lenguaje y el lenguaje da forma al cerebro. [185] [186]

La evidencia de los estudios de neuroimagen apunta hacia la posición externalista. Los estudios de ERP sugieren que el procesamiento del lenguaje se basa en la interacción de la sintaxis y la semántica, y la investigación no respalda las estructuras gramaticales innatas. [187] [188] Los estudios de MRI sugieren que las características estructurales de la primera lengua del niño dan forma al conectoma de procesamiento del cerebro. [189] La investigación sobre el procesamiento no ha encontrado apoyo para la idea inversa de que las estructuras sintácticas reflejan las preferencias de procesamiento naturales del cerebro en diferentes idiomas. [190]

La evolución del lenguaje

La corriente auditiva dorsal también tiene funciones no relacionadas con el lenguaje, como la localización de sonidos [191] [192] [193] [194] [195] y la guía de los movimientos oculares. [196] [197] Estudios recientes también indican un papel del ADS en la localización de miembros de la familia/tribu, como un estudio [198] que registró desde la corteza de un paciente epiléptico informó que el pSTG, pero no el aSTG, es selectivo para la presencia de nuevos hablantes. Un estudio fMRI [199] de fetos en su tercer trimestre también demostró que el área Spt es más selectiva al habla femenina que a los tonos puros, y una subsección de Spt es selectiva al habla de su madre en contraste con voces femeninas desconocidas.

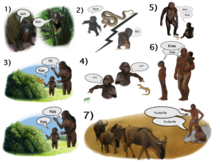

Actualmente se desconoce por qué se le atribuyen tantas funciones al ADS humano. Se realizó un intento de unificar estas funciones bajo un único marco en el modelo de evolución del lenguaje "De dónde a qué" [200] [201]. De acuerdo con este modelo, cada función del ADS indica una fase intermedia diferente en la evolución del lenguaje. Las funciones de localización del sonido e integración de la ubicación del sonido con voces y objetos auditivos se interpretan como evidencia de que el origen del habla es el intercambio de llamadas de contacto (llamadas utilizadas para informar la ubicación en casos de separación) entre madres y descendencia. El papel del ADS en la percepción y producción de entonaciones se interpreta como evidencia de que el habla comenzó modificando las llamadas de contacto con entonaciones, posiblemente para distinguir las llamadas de contacto de alarma de las llamadas de contacto seguras. El papel del ADS en la codificación de los nombres de los objetos (memoria fonológica a largo plazo) se interpreta como evidencia de la transición gradual desde la modificación de llamadas con entonaciones hasta el control vocal completo. El papel del ADS en la integración de los movimientos de los labios con los fonemas y en la repetición del habla se interpreta como evidencia de que las palabras habladas fueron aprendidas por los bebés imitando las vocalizaciones de sus padres, inicialmente imitando sus movimientos de los labios. El papel del ADS en la memoria de trabajo fonológica se interpreta como evidencia de que las palabras aprendidas a través de la mímica permanecieron activas en el ADS incluso cuando no se pronunciaban. Esto dio como resultado individuos capaces de ensayar una lista de vocalizaciones, lo que permitió la producción de palabras con varias sílabas. Los desarrollos posteriores en el ADS permitieron el ensayo de listas de palabras, lo que proporcionó la infraestructura para comunicarse con oraciones.

El lenguaje de signos en el cerebro

La investigación neurocientífica ha proporcionado una comprensión científica de cómo se procesa el lenguaje de señas en el cerebro . Existen más de 135 lenguajes de señas distintos en todo el mundo, que utilizan diferentes acentos formados por distintas áreas de un país. [202]

Al recurrir a análisis de lesiones y neuroimágenes, los neurocientíficos han descubierto que, ya sea lenguaje hablado o de señas, el cerebro humano procesa el lenguaje en general de manera similar en función del área del cerebro que se esté utilizando. [202] Los análisis de lesiones se utilizan para examinar las consecuencias del daño a regiones cerebrales específicas involucradas en el lenguaje, mientras que las neuroimágenes exploran regiones que participan en el procesamiento del lenguaje. [202]

Se han planteado hipótesis previas de que el daño en el área de Broca o en el área de Wernicke no afecta a la percepción del lenguaje de signos; sin embargo, no es así. Los estudios han demostrado que el daño en estas áreas tiene resultados similares en el lenguaje hablado, donde hay errores en los signos y/o se repiten. [202] En ambos tipos de lenguajes, se ven afectados por el daño en el hemisferio izquierdo del cerebro en lugar del derecho (que generalmente se relaciona con las artes).

Existen patrones evidentes de utilización y procesamiento del lenguaje. En el lenguaje de señas, se activa el área de Broca, mientras que en el procesamiento del lenguaje de señas se utiliza el área de Wernicke, de forma similar a lo que ocurre en el lenguaje hablado. [202]

Existen otras hipótesis sobre la lateralización de los dos hemisferios. En concreto, se pensaba que el hemisferio derecho contribuía a la comunicación global de un lenguaje, mientras que el hemisferio izquierdo sería el dominante en la generación del lenguaje a nivel local. [203] A través de la investigación sobre afasias, se descubrió que los signantes RHD tenían un problema para mantener la parte espacial de sus signos, confundiendo signos similares en diferentes lugares necesarios para comunicarse con otra persona de forma adecuada. [203] Los signantes LHD, por otro lado, obtuvieron resultados similares a los de los pacientes oyentes. Además, otros estudios han enfatizado que el lenguaje de signos está presente de forma bilateral, pero será necesario seguir investigando para llegar a una conclusión. [203]

Escribir en el cerebro

Hay un cuerpo comparativamente pequeño de investigación sobre la neurología de la lectura y la escritura. [204] La mayoría de los estudios realizados tratan sobre la lectura más que sobre la escritura o la ortografía, y la mayoría de ambos tipos se centran únicamente en el idioma inglés. [205] La ortografía inglesa es menos transparente que la de otros idiomas que utilizan un alfabeto latino . [204] Otra dificultad es que algunos estudios se centran en la ortografía de palabras en inglés y omiten los pocos caracteres logográficos que se encuentran en el alfabeto. [204]

En términos de ortografía, las palabras inglesas se pueden dividir en tres categorías: regulares, irregulares y “palabras nuevas” o “no palabras”. Las palabras regulares son aquellas en las que existe una correspondencia regular, uno a uno, entre el grafema y el fonema en la ortografía. Las palabras irregulares son aquellas en las que no existe tal correspondencia. Las no palabras son aquellas que exhiben la ortografía esperada de las palabras regulares pero no tienen significado, como las palabras no originales y las onomatopeyas . [204]

Una cuestión en el estudio cognitivo y neurológico de la lectura y la ortografía en inglés es si un modelo de ruta única o de ruta dual describe mejor cómo los hablantes alfabetizados pueden leer y escribir las tres categorías de palabras en inglés según los estándares aceptados de corrección ortográfica. Los modelos de ruta única postulan que la memoria léxica se utiliza para almacenar todas las ortografías de las palabras para su recuperación en un solo proceso. Los modelos de ruta dual postulan que la memoria léxica se emplea para procesar palabras irregulares y regulares de alta frecuencia, mientras que las palabras regulares de baja frecuencia y las no palabras se procesan utilizando un conjunto subléxico de reglas fonológicas. [204]

El modelo de ruta única para la lectura ha encontrado apoyo en estudios de modelado por computadora, que sugieren que los lectores identifican las palabras por sus similitudes ortográficas con palabras fonológicamente similares. [204] Sin embargo, los estudios cognitivos y de lesiones se inclinan hacia el modelo de ruta dual. Los estudios de ortografía cognitiva en niños y adultos sugieren que los deletreadores emplean reglas fonológicas para deletrear palabras regulares y no palabras, mientras que se accede a la memoria léxica para deletrear palabras irregulares y palabras de alta frecuencia de todo tipo. [204] De manera similar, los estudios de lesiones indican que la memoria léxica se utiliza para almacenar palabras irregulares y ciertas palabras regulares, mientras que las reglas fonológicas se utilizan para deletrear no palabras. [204]

Más recientemente, estudios de neuroimagen utilizando tomografía por emisión de positrones y fMRI han sugerido un modelo equilibrado en el que la lectura de todos los tipos de palabras comienza en el área de forma visual de la palabra , pero posteriormente se ramifica en diferentes rutas dependiendo de si se necesita o no acceso a la memoria léxica o a la información semántica (lo que se esperaría con palabras irregulares bajo un modelo de ruta dual). [204] Un estudio fMRI de 2007 encontró que los sujetos a los que se les pidió que produjeran palabras regulares en una tarea de ortografía exhibieron una mayor activación en el STG posterior izquierdo , un área utilizada para el procesamiento fonológico, mientras que la ortografía de palabras irregulares produjo una mayor activación de las áreas utilizadas para la memoria léxica y el procesamiento semántico, como el IFG izquierdo y el SMG izquierdo y ambos hemisferios del MTG . [204] Se encontró que la ortografía de no palabras accedía a miembros de ambas vías, como el STG izquierdo y los MTG e ITG bilaterales . [204] Significativamente, se encontró que la ortografía induce activación en áreas como el giro fusiforme izquierdo y la SMG izquierda que también son importantes en la lectura, lo que sugiere que se utiliza una vía similar tanto para la lectura como para la escritura. [204]

Existe mucha menos información sobre la cognición y la neurología de las escrituras no alfabéticas y no inglesas. Cada lengua tiene un componente morfológico y uno fonológico , cualquiera de los cuales puede ser registrado por un sistema de escritura . Las escrituras que registran palabras y morfemas se consideran logográficas , mientras que las que registran segmentos fonológicos, como los silabarios y los alfabetos , son fonográficas. [205] La mayoría de los sistemas combinan los dos y tienen caracteres tanto logográficos como fonográficos. [205]

En términos de complejidad, los sistemas de escritura pueden caracterizarse como "transparentes" u "opacos" y como "superficiales" o "profundos". Un sistema "transparente" exhibe una correspondencia obvia entre grafema y sonido, mientras que en un sistema "opaco" esta relación es menos obvia. Los términos "superficial" y "profundo" se refieren al grado en que la ortografía de un sistema representa morfemas en oposición a segmentos fonológicos. [205] Los sistemas que registran segmentos morfosintácticos o fonológicos más grandes, como los sistemas logográficos y los silabarios, exigen más a la memoria de los usuarios. [205] Por lo tanto, sería de esperar que un sistema de escritura opaco o profundo exigiera más a las áreas del cerebro utilizadas para la memoria léxica que un sistema con ortografía transparente o superficial.

Véase también

Referencias

- ^ Seidenberg MS, Petitto LA (1987). "Comunicación, comunicación simbólica y lenguaje: comentario sobre Savage-Rumbaugh, McDonald, Sevcik, Hopkins y Rupert (1986)". Revista de Psicología Experimental: General . 116 (3): 279–287. doi :10.1037/0096-3445.116.3.279. S2CID 18329599.

- ^ ab Geschwind N (junio de 1965). "Síndromes de desconexión en animales y en el hombre". revisión. Cerebro . 88 (2): 237–94. doi : 10.1093/brain/88.2.237 . PMID 5318481.

- ^ ab Hickok G, Poeppel D (mayo de 2007). "La organización cortical del procesamiento del habla". revisión. Nature Reviews. Neuroscience . 8 (5): 393–402. doi :10.1038/nrn2113. PMID 17431404. S2CID 6199399.

- ^ ab Gow DW (junio de 2012). "La organización cortical del conocimiento léxico: un modelo dual de léxico del procesamiento del lenguaje hablado". revisión. Cerebro y lenguaje . 121 (3): 273–88. doi :10.1016/j.bandl.2012.03.005. PMC 3348354 . PMID 22498237.

- ^ Poliva O (2017-09-20). "De dónde a qué: un modelo evolutivo basado en la neuroanatomía sobre la aparición del habla en humanos". revisión. F1000Research . 4 : 67. doi : 10.12688/f1000research.6175.3 . PMC 5600004 . PMID 28928931.

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional.

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional. - ^ Poliva O (2016). "Del mimetismo al lenguaje: un modelo evolutivo basado en la neuroanatomía sobre el surgimiento del lenguaje vocal". revisión. Frontiers in Neuroscience . 10 : 307. doi : 10.3389/fnins.2016.00307 . PMC 4928493 . PMID 27445676.

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional.

El material fue copiado de esta fuente, que está disponible bajo una Licencia Creative Commons Atribución 4.0 Internacional. - ^ Pickles JO (2015). "Capítulo 1: Vías auditivas: anatomía y fisiología". En Aminoff MJ, Boller F, Swaab DF (eds.). Manual de neurología clínica . Revisión. Vol. 129. Págs. 3–25. doi :10.1016/B978-0-444-62630-1.00001-9. ISBN . 978-0-444-62630-1. Número de identificación personal 25726260.

- ^ Lichteim L (1 de enero de 1885). "Sobre la afasia". Cerebro . 7 (4): 433–484. doi :10.1093/brain/7.4.433. hdl : 11858/00-001M-0000-002C-5780-B .

- ^ Wernicke C (1974). El complejo de síntomas afásicos . Springer Berlín Heidelberg. págs. 1–70. ISBN 978-3-540-06905-8.

- ^ Aboitiz F, García VR (diciembre de 1997). "El origen evolutivo de las áreas del lenguaje en el cerebro humano. Una perspectiva neuroanatómica". Brain Research. Brain Research Reviews . 25 (3): 381–96. doi :10.1016/s0165-0173(97)00053-2. PMID 9495565. S2CID 20704891.

- ^ ab Anderson JM, Gilmore R, Roper S, Crosson B, Bauer RM, Nadeau S, Beversdorf DQ, Cibula J, Rogish M, Kortencamp S, Hughes JD, Gonzalez Rothi LJ, Heilman KM (octubre de 1999). "Afasia de conducción y el fascículo arqueado: una reexaminación del modelo de Wernicke-Geschwind". Cerebro y lenguaje . 70 (1): 1–12. doi :10.1006/brln.1999.2135. PMID 10534369. S2CID 12171982.

- ^ DeWitt I, Rauschecker JP (noviembre de 2013). "Revisitando el área de Wernicke: flujos paralelos y procesamiento de textos". Cerebro y lenguaje . 127 (2): 181–91. doi :10.1016/j.bandl.2013.09.014. PMC 4098851 . PMID 24404576.

- ^ Dronkers NF (enero de 2000). "La búsqueda de relaciones entre el cerebro y el lenguaje". Cerebro y lenguaje . 71 (1): 59–61. doi :10.1006/brln.1999.2212. PMID 10716807. S2CID 7224731.

- ^ abc Dronkers NF, Wilkins DP, Van Valin RD, Redfern BB, Jaeger JJ (mayo de 2004). "Análisis de lesiones en las áreas cerebrales implicadas en la comprensión del lenguaje". Cognición . 92 (1–2): 145–77. doi :10.1016/j.cognition.2003.11.002. hdl : 11858/00-001M-0000-0012-6912-A . PMID 15037129. S2CID 10919645.

- ^ Mesulam MM, Thompson CK, Weintraub S, Rogalski EJ (agosto de 2015). "El enigma de Wernicke y la anatomía de la comprensión del lenguaje en la afasia progresiva primaria". Brain . 138 (Pt 8): 2423–37. doi :10.1093/brain/awv154. PMC 4805066 . PMID 26112340.

- ^ Poeppel D , Emmorey K , Hickok G, Pylkkänen L (octubre de 2012). "Hacia una nueva neurobiología del lenguaje". The Journal of Neuroscience . 32 (41): 14125–31. doi :10.1523/jneurosci.3244-12.2012. PMC 3495005. PMID 23055482 .

- ^ Vignolo LA, Boccardi E, Caverni L (marzo de 1986). "Hallazgos inesperados en la tomografía computarizada en la afasia global". Cortex; una revista dedicada al estudio del sistema nervioso y la conducta . 22 (1): 55–69. doi : 10.1016/s0010-9452(86)80032-6 . PMID: 2423296. S2CID : 4479679.

- ^ ab Bendor D, Wang X (agosto de 2006). "Representaciones corticales del tono en monos y humanos". Current Opinion in Neurobiology . 16 (4): 391–9. doi :10.1016/j.conb.2006.07.001. PMC 4325365 . PMID 16842992.

- ^ ab Rauschecker JP, Tian B, Hauser M (abril de 1995). "Procesamiento de sonidos complejos en la corteza auditiva no primaria del macaco". Science . 268 (5207): 111–4. Bibcode :1995Sci...268..111R. doi :10.1126/science.7701330. PMID 7701330. S2CID 19590708.

- ^ ab de la Mothe LA, Blumell S, Kajikawa Y, Hackett TA (mayo de 2006). "Conexiones corticales de la corteza auditiva en monos tití: regiones del cinturón central y medial". The Journal of Comparative Neurology . 496 (1): 27–71. doi :10.1002/cne.20923. PMID 16528722. S2CID 38393074.

- ^ de la Mothe LA, Blumell S, Kajikawa Y, Hackett TA (mayo de 2012). "Conexiones corticales de la corteza auditiva en monos tití: regiones del cinturón lateral y parabelt". Registro Anatómico . 295 (5): 800–21. doi :10.1002/ar.22451. PMC 3379817 . PMID 22461313.

- ^ Kaas JH, Hackett TA (octubre de 2000). "Subdivisiones de la corteza auditiva y flujos de procesamiento en primates". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 97 (22): 11793–9. Bibcode :2000PNAS...9711793K. doi : 10.1073/pnas.97.22.11793 . PMC 34351 . PMID 11050211.

- ^ Petkov CI, Kayser C, Augath M, Logothetis NK (julio de 2006). "Las imágenes funcionales revelan numerosos campos en la corteza auditiva del mono". PLOS Biology . 4 (7): e215. doi : 10.1371/journal.pbio.0040215 . PMC 1479693 . PMID 16774452.

- ^ Morel A, Garraghty PE, Kaas JH (septiembre de 1993). "Organización tonotópica, campos arquitectónicos y conexiones de la corteza auditiva en monos macacos". The Journal of Comparative Neurology . 335 (3): 437–59. doi :10.1002/cne.903350312. PMID 7693772. S2CID 22872232.

- ^ Rauschecker JP, Tian B (octubre de 2000). "Mecanismos y flujos para el procesamiento de "qué" y "dónde" en la corteza auditiva". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 97 (22): 11800–6. Bibcode :2000PNAS...9711800R. doi : 10.1073/pnas.97.22.11800 . PMC 34352 . PMID 11050212.

- ^ Rauschecker JP, Tian B, Pons T, Mishkin M (mayo de 1997). "Procesamiento serial y paralelo en la corteza auditiva del mono rhesus". The Journal of Comparative Neurology . 382 (1): 89–103. doi :10.1002/(sici)1096-9861(19970526)382:1<89::aid-cne6>3.3.co;2-y. PMID 9136813.

- ^ Sweet RA, Dorph-Petersen KA, Lewis DA (octubre de 2005). "Mapeo de las cortezas auditivas central, lateral y de paracinto en el giro temporal superior humano". The Journal of Comparative Neurology . 491 (3): 270–89. doi :10.1002/cne.20702. PMID 16134138. S2CID 40822276.

- ^ Wallace MN, Johnston PW, Palmer AR (abril de 2002). "Identificación histoquímica de áreas corticales en la región auditiva del cerebro humano". Experimental Brain Research . 143 (4): 499–508. doi :10.1007/s00221-002-1014-z. PMID 11914796. S2CID 24211906.

- ^ Da Costa S, van der Zwaag W, Marques JP, Frackowiak RS, Clarke S, Saenz M (octubre de 2011). "La corteza auditiva primaria humana sigue la forma del giro de Heschl". The Journal of Neuroscience . 31 (40): 14067–75. doi : 10.1523/jneurosci.2000-11.2011 . PMC 6623669 . PMID 21976491.

- ^ Humphries C, Liebenthal E, Binder JR (abril de 2010). "Organización tonotópica de la corteza auditiva humana". NeuroImage . 50 (3): 1202–11. doi :10.1016/j.neuroimage.2010.01.046. PMC 2830355 . PMID 20096790.

- ^ Langers DR, van Dijk P (septiembre de 2012). "Mapeo de la organización tonotópica en la corteza auditiva humana con estimulación acústica mínimamente saliente". Corteza cerebral . 22 (9): 2024–38. doi :10.1093/cercor/bhr282. PMC 3412441 . PMID 21980020.

- ^ Striem-Amit E, Hertz U, Amedi A (marzo de 2011). "Mapeo cocleotópico extenso de los campos corticales auditivos humanos obtenidos con fMRI con codificación de fase". PLOS ONE . 6 (3): e17832. Bibcode :2011PLoSO...617832S. doi : 10.1371/journal.pone.0017832 . PMC 3063163 . PMID 21448274.

- ^ Woods DL, Herron TJ, Cate AD, Yund EW, Stecker GC, Rinne T, Kang X (2010). "Propiedades funcionales de los campos corticales auditivos humanos". Frontiers in Systems Neuroscience . 4 : 155. doi : 10.3389/fnsys.2010.00155 . PMC 3001989 . PMID 21160558.

- ^ Gourévitch B, Le Bouquin Jeannès R, Faucon G, Liégeois-Chauvel C (marzo de 2008). "Procesamiento de la envoltura temporal en la corteza auditiva humana: respuesta e interconexiones de las áreas corticales auditivas" (PDF) . Hearing Research . 237 (1–2): 1–18. doi :10.1016/j.heares.2007.12.003. PMID 18255243. S2CID 15271578.

- ^ Guéguin M, Le Bouquin-Jeannès R, Faucon G, Chauvel P, Liégeois-Chauvel C (febrero de 2007). "Evidencia de conectividad funcional entre áreas corticales auditivas revelada por el procesamiento del sonido con modulación de amplitud". Corteza cerebral . 17 (2): 304–13. doi :10.1093/cercor/bhj148. PMC 2111045 . PMID 16514106.

- ^ abc Poliva O, Bestelmeyer PE, Hall M, Bultitude JH, Koller K, Rafal RD (septiembre de 2015). "Mapeo funcional de la corteza auditiva humana: investigación mediante fMRI de un paciente con agnosia auditiva por traumatismo en el colículo inferior" (PDF) . Neurología cognitiva y conductual . 28 (3): 160–80. doi :10.1097/wnn.0000000000000072. PMID 26413744. S2CID 913296.

- ^ Chang EF, Edwards E, Nagarajan SS, Fogelson N, Dalal SS, Canolty RT, Kirsch HE, Barbaro NM, Knight RT (junio de 2011). "Dinámica espacio-temporal cortical subyacente a la detección de objetivos fonológicos en humanos". Journal of Cognitive Neuroscience . 23 (6): 1437–46. doi :10.1162/jocn.2010.21466. PMC 3895406 . PMID 20465359.

- ^ Muñoz M, Mishkin M, Saunders RC (septiembre de 2009). "La resección del lóbulo temporal medial desconecta el giro temporal superior rostral de algunos de sus objetivos de proyección en el lóbulo frontal y el tálamo". Corteza cerebral . 19 (9): 2114–30. doi :10.1093/cercor/bhn236. PMC 2722427 . PMID 19150921.

- ^ ab Romanski LM, Bates JF, Goldman-Rakic PS (enero de 1999). "Proyecciones auditivas de cinturón y paracinto a la corteza prefrontal en el mono rhesus". The Journal of Comparative Neurology . 403 (2): 141–57. doi :10.1002/(sici)1096-9861(19990111)403:2<141::aid-cne1>3.0.co;2-v. PMID 9886040. S2CID 42482082.

- ^ Tanaka D (junio de 1976). "Proyecciones talámicas de la corteza prefrontal dorsomedial en el mono rhesus (Macaca mulatta)". Brain Research . 110 (1): 21–38. doi :10.1016/0006-8993(76)90206-7. PMID 819108. S2CID 21529048.

- ^ ab Perrodin C, Kayser C, Logothetis NK, Petkov CI (agosto de 2011). "Células de la voz en el lóbulo temporal de los primates". Current Biology . 21 (16): 1408–15. doi :10.1016/j.cub.2011.07.028. PMC 3398143 . PMID 21835625.

- ^ abc Petkov CI, Kayser C, Steudel T, Whittingstall K, Augath M, Logothetis NK (marzo de 2008). "Una región de la voz en el cerebro del mono". Nature Neuroscience . 11 (3): 367–74. doi :10.1038/nn2043. PMID 18264095. S2CID 5505773.

- ^ ab Poremba A, Malloy M, Saunders RC, Carson RE, Herscovitch P, Mishkin M (enero de 2004). "Los llamados específicos de la especie evocan actividad asimétrica en los polos temporales del mono". Nature . 427 (6973): 448–51. Bibcode :2004Natur.427..448P. doi :10.1038/nature02268. PMID 14749833. S2CID 4402126.

- ^ Romanski LM, Averbeck BB, Diltz M (febrero de 2005). "Representación neuronal de vocalizaciones en la corteza prefrontal ventrolateral de los primates". Journal of Neurophysiology . 93 (2): 734–47. doi :10.1152/jn.00675.2004. PMID 15371495.

- ^ Russ BE, Ackelson AL, Baker AE, Cohen YE (enero de 2008). "Codificación de la identidad del estímulo auditivo en el flujo de procesamiento no espacial auditivo". Journal of Neurophysiology . 99 (1): 87–95. doi :10.1152/jn.01069.2007. PMC 4091985 . PMID 18003874.

- ^ ab Tsunada J, Lee JH, Cohen YE (junio de 2011). "Representación de categorías del habla en la corteza auditiva de los primates". Journal of Neurophysiology . 105 (6): 2634–46. doi :10.1152/jn.00037.2011. PMC 3118748 . PMID 21346209.

- ^ Cusick CG, Seltzer B, Cola M, Griggs E (septiembre de 1995). "Quimioarquitectónica y terminaciones corticocorticales dentro del surco temporal superior del mono rhesus: evidencia de subdivisiones de la corteza polisensorial temporal superior". The Journal of Comparative Neurology . 360 (3): 513–35. doi :10.1002/cne.903600312. PMID 8543656. S2CID 42281619.

- ^ Cohen YE, Russ BE, Gifford GW, Kiringoda R, MacLean KA (diciembre de 2004). "Selectividad para los atributos espaciales y no espaciales de los estímulos auditivos en la corteza prefrontal ventrolateral". The Journal of Neuroscience . 24 (50): 11307–16. doi : 10.1523/jneurosci.3935-04.2004 . PMC 6730358 . PMID 15601937.

- ^ Deacon TW (febrero de 1992). "Conexiones corticales de la corteza del surco arqueado inferior en el cerebro del macaco". Brain Research . 573 (1): 8–26. doi :10.1016/0006-8993(92)90109-m. ISSN 0006-8993. PMID 1374284. S2CID 20670766.

- ^ Lewis JW, Van Essen DC (diciembre de 2000). "Conexiones corticocorticales de las áreas de procesamiento visual, sensoriomotor y multimodal en el lóbulo parietal del mono macaco". The Journal of Comparative Neurology . 428 (1): 112–37. doi :10.1002/1096-9861(20001204)428:1<112::aid-cne8>3.0.co;2-9. PMID 11058227. S2CID 16153360.

- ^ Roberts AC, Tomic DL, Parkinson CH, Roeling TA, Cutter DJ, Robbins TW, Everitt BJ (mayo de 2007). "Conectividad del prosencéfalo de la corteza prefrontal en el mono tití (Callithrix jacchus): un estudio de trazado de vías anterógradas y retrógradas". The Journal of Comparative Neurology . 502 (1): 86–112. doi :10.1002/cne.21300. PMID 17335041. S2CID 18262007.

- ^ ab Schmahmann JD, Pandya DN, Wang R, Dai G, D'Arceuil HE, de Crespigny AJ, Wedeen VJ (marzo de 2007). "Vías de asociación de fibras del cerebro: observaciones paralelas a partir de imágenes de espectro de difusión y autorradiografía". Cerebro . 130 (Pt 3): 630–53. doi : 10.1093/brain/awl359 . PMID 17293361.

- ^ Seltzer B, Pandya DN (julio de 1984). "Observaciones adicionales sobre las conexiones parietotemporales en el mono rhesus". Experimental Brain Research . 55 (2): 301–12. doi :10.1007/bf00237280. PMID 6745368. S2CID 20167953.

- ^ Catani M, Jones DK, ffytche DH (enero de 2005). "Redes lingüísticas perisilvianas del cerebro humano". Anales de neurología . 57 (1): 8–16. doi : 10.1002/ana.20319 . PMID 15597383. S2CID 17743067.

- ^ Frey S, Campbell JS, Pike GB, Petrides M (noviembre de 2008). "Disociación de las vías del lenguaje humano con tractografía de fibras de difusión de alta resolución angular". The Journal of Neuroscience . 28 (45): 11435–44. doi : 10.1523/jneurosci.2388-08.2008 . PMC 6671318 . PMID 18987180.

- ^ Makris N, Papadimitriou GM, Kaiser JR, Sorg S, Kennedy DN, Pandya DN (abril de 2009). "Delineación del fascículo longitudinal medio en humanos: un estudio cuantitativo in vivo mediante resonancia magnética de diana". Corteza cerebral . 19 (4): 777–85. doi :10.1093/cercor/bhn124. PMC 2651473 . PMID 18669591.

- ^ Menjot de Champfleur N, Lima Maldonado I, Moritz-Gasser S, Machi P, Le Bars E, Bonafé A, Duffau H (enero de 2013). "Delineación del fascículo longitudinal medio en las vías del lenguaje: un estudio de imágenes del tensor de difusión en humanos". Revista Europea de Radiología . 82 (1): 151–7. doi :10.1016/j.ejrad.2012.05.034. PMID 23084876.

- ^ Turken AU, Dronkers NF (2011). "La arquitectura neuronal de la red de comprensión del lenguaje: evidencia convergente de los análisis de lesiones y conectividad". Frontiers in Systems Neuroscience . 5 : 1. doi : 10.3389/fnsys.2011.00001 . PMC 3039157 . PMID 21347218.

- ^ Saur D, Kreher BW, Schnell S, Kümmerer D, Kellmeyer P, Vry MS, Umarova R, Musso M, Glauche V, Abel S, Huber W, Rijntjes M, Hennig J, Weiller C (noviembre de 2008). "Vías ventrales y dorsales del lenguaje". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 105 (46): 18035–40. Bibcode :2008PNAS..10518035S. doi : 10.1073/pnas.0805234105 . PMC 2584675 . PMID 19004769.

- ^ Yin P, Mishkin M, Sutter M, Fritz JB (diciembre de 2008). "Etapas tempranas del procesamiento de melodías: actividad neuronal dependiente de la secuencia de estímulos y de la tarea en los campos corticales auditivos A1 y R de los monos". Journal of Neurophysiology . 100 (6): 3009–29. doi :10.1152/jn.00828.2007. PMC 2604844 . PMID 18842950.

- ^ Steinschneider M, Volkov IO, Fishman YI, Oya H, Arezzo JC, Howard MA (febrero de 2005). "Las respuestas intracorticales en la corteza auditiva primaria de humanos y monos respaldan un mecanismo de procesamiento temporal para la codificación del parámetro fonético del tiempo de inicio de la voz". Corteza cerebral . 15 (2): 170–86. doi : 10.1093/cercor/bhh120 . PMID 15238437.

- ^ Russ BE, Ackelson AL, Baker AE, Cohen YE (enero de 2008). "Codificación de la identidad del estímulo auditivo en el flujo de procesamiento no espacial auditivo". Journal of Neurophysiology . 99 (1): 87–95. doi :10.1152/jn.01069.2007. PMC 4091985 . PMID 18003874.

- ^ Joly O, Pallier C, Ramus F, Pressnitzer D, Vanduffel W, Orban GA (septiembre de 2012). "Procesamiento de vocalizaciones en humanos y monos: un estudio comparativo de fMRI" (PDF) . NeuroImage . 62 (3): 1376–89. doi :10.1016/j.neuroimage.2012.05.070. PMID 22659478. S2CID 9441377.

- ^ Scheich H, Baumgart F, Gaschler-Markefski B, Tegeler C, Tempelmann C, Heinze HJ, Schindler F, Stiller D (febrero de 1998). "Imágenes por resonancia magnética funcional de un área de la corteza auditiva humana implicada en la descomposición primer plano-fondo". Revista Europea de Neurociencia . 10 (2): 803–9. doi :10.1046/j.1460-9568.1998.00086.x. PMID 9749748. S2CID 42898063.

- ^ Zatorre RJ, Bouffard M, Belin P (abril de 2004). "Sensibilidad a las características auditivas de los objetos en el neocórtex temporal humano". The Journal of Neuroscience . 24 (14): 3637–42. doi : 10.1523/jneurosci.5458-03.2004 . PMC 6729744 . PMID 15071112.

- ^ ab Binder JR, Desai RH, Graves WW, Conant LL (diciembre de 2009). "¿Dónde está el sistema semántico? Una revisión crítica y un metaanálisis de 120 estudios de neuroimagen funcional". Corteza cerebral . 19 (12): 2767–96. doi :10.1093/cercor/bhp055. PMC 2774390 . PMID 19329570.

- ^ Davis MH, Johnsrude IS (abril de 2003). "Procesamiento jerárquico en la comprensión del lenguaje hablado". The Journal of Neuroscience . 23 (8): 3423–31. doi : 10.1523/jneurosci.23-08-03423.2003 . PMC 6742313 . PMID 12716950.

- ^ Liebenthal E, Binder JR, Spitzer SM, Possing ET, Medler DA (octubre de 2005). "Sustratos neuronales de la percepción fonémica". Corteza cerebral . 15 (10): 1621–31. doi : 10.1093/cercor/bhi040 . PMID 15703256.

- ^ Narain C, Scott SK, Wise RJ, Rosen S, Leff A, Iversen SD, Matthews PM (diciembre de 2003). "Definición de una respuesta lateralizada izquierda específica para el habla inteligible mediante fMRI". Corteza cerebral . 13 (12): 1362–8. doi : 10.1093/cercor/bhg083 . PMID 14615301.

- ^ Obleser J, Boecker H, Drzezga A, Haslinger B, Hennenlotter A, Roettinger M, Eulitz C, Rauschecker JP (julio de 2006). "Extracción de sonidos vocálicos en la corteza temporal superior anterior". Mapeo cerebral humano . 27 (7): 562–71. doi :10.1002/hbm.20201. PMC 6871493 . PMID 16281283.

- ^ Obleser J, Zimmermann J, Van Meter J, Rauschecker JP (octubre de 2007). "Múltiples etapas de la percepción auditiva del habla reflejadas en la resonancia magnética funcional relacionada con eventos". Corteza cerebral . 17 (10): 2251–7. doi : 10.1093/cercor/bhl133 . PMID 17150986.

- ^ Scott SK, Blank CC, Rosen S, Wise RJ (diciembre de 2000). "Identificación de una vía para el habla inteligible en el lóbulo temporal izquierdo". Cerebro . 123 (12): 2400–6. doi :10.1093/brain/123.12.2400. PMC 5630088 . PMID 11099443.

- ^ Belin P, Zatorre RJ (noviembre de 2003). "Adaptación a la voz del hablante en el lóbulo temporal anterior derecho". NeuroReport . 14 (16): 2105–2109. doi :10.1097/00001756-200311140-00019. PMID 14600506. S2CID 34183900.

- ^ Benson RR, Whalen DH, Richardson M, Swainson B, Clark VP, Lai S, Liberman AM (septiembre de 2001). "Disociación paramétrica de la percepción del habla y de la no habla en el cerebro mediante fMRI". Cerebro y lenguaje . 78 (3): 364–96. doi :10.1006/brln.2001.2484. PMID 11703063. S2CID 15328590.

- ^ Leaver AM, Rauschecker JP (junio de 2010). "Representación cortical de sonidos complejos naturales: efectos de las características acústicas y la categoría de objeto auditivo". The Journal of Neuroscience . 30 (22): 7604–12. doi :10.1523/jneurosci.0296-10.2010. PMC 2930617 . PMID 20519535.

- ^ Lewis JW, Phinney RE, Brefczynski-Lewis JA, DeYoe EA (agosto de 2006). "Los zurdos lo entienden "bien" cuando escuchan sonidos de herramientas". Journal of Cognitive Neuroscience . 18 (8): 1314–30. doi :10.1162/jocn.2006.18.8.1314. PMID 16859417. S2CID 14049095.

- ^ Maeder PP, Meuli RA, Adriani M, Bellmann A, Fornari E, Thiran JP, Pittet A, Clarke S (octubre de 2001). "Distintas vías implicadas en el reconocimiento y la localización del sonido: un estudio de resonancia magnética funcional en humanos" (PDF) . NeuroImagen . 14 (4): 802–16. doi :10.1006/nimg.2001.0888. PMID 11554799. S2CID 1388647.

- ^ Viceic D, Fornari E, Thiran JP, Maeder PP, Meuli R, Adriani M, Clarke S (noviembre de 2006). "Áreas del cinturón auditivo humano especializadas en el reconocimiento de sonido: un estudio de imágenes por resonancia magnética funcional" (PDF) . NeuroReport . 17 (16): 1659–62. doi :10.1097/01.wnr.0000239962.75943.dd. PMID 17047449. S2CID 14482187.

- ^ Shultz S, Vouloumanos A, Pelphrey K (mayo de 2012). "El surco temporal superior diferencia las señales auditivas comunicativas y no comunicativas". Journal of Cognitive Neuroscience . 24 (5): 1224–32. doi :10.1162/jocn_a_00208. PMID 22360624. S2CID 10784270.

- ^ DeWitt I, Rauschecker JP (febrero de 2012). "Reconocimiento de fonemas y palabras en la corriente auditiva ventral". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 109 (8): E505-14. Bibcode :2012PNAS..109E.505D. doi : 10.1073/pnas.1113427109 . PMC 3286918 . PMID 22308358.

- ^ abcd Lachaux JP, Jerbi K, Bertrand O, Minotti L, Hoffmann D, Schoendorff B, Kahane P (octubre de 2007). "Un modelo para el mapeo funcional en tiempo real a través de grabaciones intracraneales humanas". PLOS ONE . 2 (10): e1094. Bibcode :2007PLoSO...2.1094L. doi : 10.1371/journal.pone.0001094 . PMC 2040217 . PMID 17971857.

- ^ ab Matsumoto R, Imamura H, Inouchi M, Nakagawa T, Yokoyama Y, Matsuhashi M, Mikuni N, Miyamoto S, Fukuyama H, Takahashi R, Ikeda A (abril de 2011). "La corteza temporal anterior izquierda participa activamente en la percepción del habla: un estudio de estimulación cortical directa". Neuropsychologia . 49 (5): 1350–1354. doi :10.1016/j.neuropsychologia.2011.01.023. hdl : 2433/141342 . PMID 21251921. S2CID 1831334.

- ^ abcd Roux FE, Miskin K, Durand JB, Sacko O, Réhault E, Tanova R, Démonet JF (octubre de 2015). "Mapeo de la comprensión de palabras auditivas y visuales mediante electroestimulación". Cortex; una revista dedicada al estudio del sistema nervioso y el comportamiento . 71 : 398–408. doi :10.1016/j.cortex.2015.07.001. PMID 26332785. S2CID 39964328.

- ^ Fritz J, Mishkin M, Saunders RC (junio de 2005). "En busca de un engrama auditivo". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 102 (26): 9359–64. Bibcode :2005PNAS..102.9359F. doi : 10.1073/pnas.0503998102 . PMC 1166637 . PMID 15967995.

- ^ Stepien LS, Cordeau JP, Rasmussen T (1960). "El efecto de las lesiones del lóbulo temporal y del hipocampo en la memoria reciente auditiva y visual en monos". Cerebro . 83 (3): 470–489. doi : 10.1093/brain/83.3.470 . ISSN 0006-8950.

- ^ Strominger NL, Oesterreich RE, Neff WD (junio de 1980). "Discriminación auditiva y visual secuencial después de la ablación del lóbulo temporal en monos". Fisiología y comportamiento . 24 (6): 1149–56. doi :10.1016/0031-9384(80)90062-1. PMID 6774349. S2CID 7494152.

- ^ Kaiser J, Ripper B, Birbaumer N, Lutzenberger W (octubre de 2003). "Dinámica de la actividad de la banda gamma en el magnetoencefalograma humano durante la memoria de trabajo de patrones auditivos". NeuroImage . 20 (2): 816–27. doi :10.1016/s1053-8119(03)00350-1. PMID 14568454. S2CID 19373941.

- ^ Buchsbaum BR, Olsen RK, Koch P, Berman KF (noviembre de 2005). "Las corrientes auditivas dorsales y ventrales humanas favorecen los procesos ecoicos y basados en el ensayo durante la memoria de trabajo verbal". Neuron . 48 (4): 687–97. doi : 10.1016/j.neuron.2005.09.029 . PMID 16301183. S2CID 13202604.

- ^ Scott BH, Mishkin M, Yin P (julio de 2012). "Los monos tienen una forma limitada de memoria a corto plazo en la audición". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 109 (30): 12237–41. Bibcode :2012PNAS..10912237S. doi : 10.1073/pnas.1209685109 . PMC 3409773 . PMID 22778411.

- ^ Noppeney U, Patterson K, Tyler LK, Moss H, Stamatakis EA, Bright P, Mummery C, Price CJ (abril de 2007). "Lesiones del lóbulo temporal y deterioro semántico: una comparación de la encefalitis por el virus del herpes simple y la demencia semántica". Brain . 130 (Pt 4): 1138–47. doi : 10.1093/brain/awl344 . PMID 17251241.

- ^ Patterson K, Nestor PJ, Rogers TT (diciembre de 2007). "¿Dónde sabes lo que sabes? La representación del conocimiento semántico en el cerebro humano". Nature Reviews. Neuroscience . 8 (12): 976–87. doi :10.1038/nrn2277. PMID 18026167. S2CID 7310189.

- ^ Schwartz MF, Kimberg DY, Walker GM, Faseyitan O, Brecher A, Dell GS, Coslett HB (diciembre de 2009). "Participación temporal anterior en la recuperación semántica de palabras: evidencia de mapeo de síntomas y lesiones basado en vóxeles en casos de afasia". Brain . 132 (Pt 12): 3411–27. doi :10.1093/brain/awp284. PMC 2792374 . PMID 19942676.

- ^ Hamberger MJ, McClelland S, McKhann GM, Williams AC, Goodman RR (marzo de 2007). "Distribución de los sitios de denominación auditivos y visuales en pacientes con epilepsia del lóbulo temporal no lesional y pacientes con lesiones ocupantes de espacio en el lóbulo temporal". Epilepsia . 48 (3): 531–8. doi : 10.1111/j.1528-1167.2006.00955.x . PMID 17326797. S2CID 12642281.

- ^ abc Duffau H (marzo de 2008). "Revisitando la conectividad anatomofuncional del lenguaje. Nuevos conocimientos proporcionados por la electroestimulación y la tractografía". Neuropsychologia . 46 (4): 927–34. doi :10.1016/j.neuropsychologia.2007.10.025. PMID 18093622. S2CID 40514753.

- ^ Vigneau M, Beaucousin V, Hervé PY, Duffau H, Crivello F, Houdé O, Mazoyer B, Tzourio-Mazoyer N (mayo de 2006). "Metaanálisis de áreas del lenguaje del hemisferio izquierdo: fonología, semántica y procesamiento de oraciones". NeuroImagen . 30 (4): 1414–32. doi : 10.1016/j.neuroimage.2005.11.002. PMID 16413796. S2CID 8870165.

- ^ ab Creutzfeldt O, Ojemann G, Lettich E (octubre de 1989). "Actividad neuronal en el lóbulo temporal lateral humano. I. Respuestas al habla". Experimental Brain Research . 77 (3): 451–75. doi :10.1007/bf00249600. hdl : 11858/00-001M-0000-002C-89EA-3 . PMID 2806441. S2CID 19952034.

- ^ Mazoyer BM, Tzourio N, Frak V, Syrota A, Murayama N, Levrier O, Salamon G, Dehaene S, Cohen L, Mehler J (octubre de 1993). "La representación cortical del habla" (PDF) . Revista de neurociencia cognitiva . 5 (4): 467–79. doi :10.1162/jocn.1993.5.4.467. PMID 23964919. S2CID 22265355.

- ^ Humphries C, Love T, Swinney D, Hickok G (octubre de 2005). "Respuesta de la corteza temporal anterior a las manipulaciones sintácticas y prosódicas durante el procesamiento de oraciones". Mapeo cerebral humano . 26 (2): 128–38. doi :10.1002/hbm.20148. PMC 6871757 . PMID 15895428.

- ^ Humphries C, Willard K, Buchsbaum B, Hickok G (junio de 2001). "El papel de la corteza temporal anterior en la comprensión auditiva de oraciones: un estudio fMRI". NeuroReport . 12 (8): 1749–52. doi :10.1097/00001756-200106130-00046. PMID 11409752. S2CID 13039857.

- ^ Vandenberghe R, Nobre AC, Price CJ (mayo de 2002). "La respuesta de la corteza temporal izquierda a las oraciones". Revista de neurociencia cognitiva . 14 (4): 550–60. doi :10.1162/08989290260045800. PMID 12126497. S2CID 21607482.

- ^ Friederici AD, Rüschemeyer SA, Hahne A, Fiebach CJ (febrero de 2003). "El papel de la corteza frontal inferior izquierda y la corteza temporal superior en la comprensión de oraciones: localización de los procesos sintácticos y semánticos". Corteza cerebral . 13 (2): 170–7. doi : 10.1093/cercor/13.2.170 . hdl : 11858/00-001M-0000-0010-E3AB-B . PMID 12507948.

- ^ Xu J, Kemeny S, Park G, Frattali C, Braun A (2005). "El lenguaje en contexto: características emergentes de la comprensión de palabras, oraciones y narrativas". NeuroImage . 25 (3): 1002–15. doi :10.1016/j.neuroimage.2004.12.013. PMID 15809000. S2CID 25570583.

- ^ Rogalsky C, Hickok G (abril de 2009). "La atención selectiva a las características semánticas y sintácticas modula las redes de procesamiento de oraciones en la corteza temporal anterior". Corteza cerebral . 19 (4): 786–96. doi :10.1093/cercor/bhn126. PMC 2651476 . PMID 18669589.

- ^ Pallier C, Devauchelle AD, Dehaene S (febrero de 2011). "Representación cortical de la estructura constituyente de las oraciones". Actas de la Academia Nacional de Ciencias de los Estados Unidos de América . 108 (6): 2522–7. doi : 10.1073/pnas.1018711108 . PMC 3038732 . PMID 21224415.

- ^ Brennan J, Nir Y, Hasson U, Malach R, Heeger DJ, Pylkkänen L (febrero de 2012). "Construcción de la estructura sintáctica en el lóbulo temporal anterior durante la escucha natural de historias". Cerebro y lenguaje . 120 (2): 163–73. doi :10.1016/j.bandl.2010.04.002. PMC 2947556 . PMID 20472279.

- ^ Kotz SA, von Cramon DY, Friederici AD (octubre de 2003). "Diferenciación de los procesos sintácticos en el lóbulo temporal anterior izquierdo y derecho: evidencia de potencial cerebral relacionado con eventos en pacientes con lesiones". Cerebro y lenguaje . 87 (1): 135–136. doi :10.1016/s0093-934x(03)00236-0. S2CID 54320415.

- ^ Martin RC, Shelton JR, Yaffee LS (febrero de 1994). "Procesamiento del lenguaje y memoria de trabajo: evidencia neuropsicológica de capacidades fonológicas y semánticas separadas". Journal of Memory and Language . 33 (1): 83–111. doi :10.1006/jmla.1994.1005.

- ^ Magnusdottir S, Fillmore P, den Ouden DB, Hjaltason H, Rorden C, Kjartansson O, Bonilha L, Fridriksson J (octubre de 2013). "El daño en la corteza temporal anterior izquierda predice el deterioro del procesamiento sintáctico complejo: un estudio de mapeo de síntomas y lesiones". Mapeo cerebral humano . 34 (10): 2715–23. doi :10.1002/hbm.22096. PMC 6869931 . PMID 22522937.

- ^ Bornkessel-Schlesewsky I, Schlesewsky M, Small SL, Rauschecker JP (marzo de 2015). "Raíces neurobiológicas del lenguaje en la audición de primates: propiedades computacionales comunes". Tendencias en Ciencias Cognitivas . 19 (3): 142–50. doi :10.1016/j.tics.2014.12.008. PMC 4348204 . PMID 25600585.

- ^ Hickok G, Okada K, Barr W, Pa J, Rogalsky C, Donnelly K, Barde L, Grant A (diciembre de 2008). "Capacidad bilateral para el procesamiento del sonido del habla en la comprensión auditiva: evidencia de los procedimientos de Wada". Cerebro y lenguaje . 107 (3): 179–84. doi :10.1016/j.bandl.2008.09.006. PMC 2644214 . PMID 18976806.

- ^ Zaidel E (septiembre de 1976). "Vocabulario auditivo del hemisferio derecho después de la bisección cerebral o hemidecorticación". Cortex . 12 (3): 191–211. doi : 10.1016/s0010-9452(76)80001-9 . ISSN 0010-9452. PMID 1000988. S2CID 4479925.

- ^ Poeppel D (octubre de 2001). "Sordera verbal pura y procesamiento bilateral del código del habla". Cognitive Science . 25 (5): 679–693. doi : 10.1016/s0364-0213(01)00050-7 .

- ^ Ulrich G (mayo de 1978). "Relaciones funcionales interhemisféricas en la agnosia auditiva. Un análisis de las condiciones previas y un modelo conceptual". Cerebro y lenguaje . 5 (3): 286–300. doi :10.1016/0093-934x(78)90027-5. PMID 656899. S2CID 33841186.

- ^ Stewart L, Walsh V, Frith U, Rothwell JC (marzo de 2001). "TMS produce dos tipos disociables de alteración del habla" (PDF) . NeuroImage . 13 (3): 472–8. doi :10.1006/nimg.2000.0701. PMID 11170812. S2CID 10392466.

- ^ Acheson DJ, Hamidi M, Binder JR, Postle BR (junio de 2011). "Un sustrato neuronal común para la producción del lenguaje y la memoria de trabajo verbal". Journal of Cognitive Neuroscience . 23 (6): 1358–67. doi :10.1162/jocn.2010.21519. PMC 3053417 . PMID 20617889.

- ^ Desmurget M, Reilly KT, Richard N, Szathmari A, Mottolese C, Sirigu A (mayo de 2009). "Intención de movimiento después de la estimulación de la corteza parietal en humanos". Science . 324 (5928): 811–3. Bibcode :2009Sci...324..811D. doi :10.1126/science.1169896. PMID 19423830. S2CID 6555881.

- ^ Edwards E, Nagarajan SS, Dalal SS, Canolty RT, Kirsch HE, Barbaro NM, Knight RT (marzo de 2010). "Imágenes espaciotemporales de la activación cortical durante la generación de verbos y la denominación de imágenes". NeuroImage . 50 (1): 291–301. doi :10.1016/j.neuroimage.2009.12.035. PMC 2957470 . PMID 20026224.